Post | RAG

- Related Project: Private

- Category: Paper Review

- Date: 2025-02-17

RAG

- url: https://arxiv.org/abs/2406.09827

- pdf: https://arxiv.org/pdf/2406.09827

- html: https://arxiv.org/html/2406.09827v1

- ralated: https://www.linkedin.com/feed/update/urn:li:groupPost:961087-7295846111309676545?utm_source=social_share_send&utm_medium=member_desktop_web&rcm=ACoAADACrAAB7zXxxkMv0ZdrxZDIvP430BSLjjw

- abstract: In modern large language models (LLMs), increasing the context length is crucial for improving comprehension and coherence in long-context, multi-modal, and retrieval-augmented language generation. While many recent transformer models attempt to extend their context length over a million tokens, they remain impractical due to the quadratic time and space complexities. Although recent works on linear and sparse attention mechanisms can achieve this goal, their real-world applicability is often limited by the need to re-train from scratch and significantly worse performance. In response, we propose a novel approach, Hierarchically Pruned Attention (HiP), which reduces the time complexity of the attention mechanism to O(TlogT) and the space complexity to O(T), where T is the sequence length. We notice a pattern in the attention scores of pretrained LLMs where tokens close together tend to have similar scores, which we call ``attention locality’’. Based on this observation, we utilize a novel tree-search-like algorithm that estimates the top-k key tokens for a given query on the fly, which is mathematically guaranteed to have better performance than random attention pruning. In addition to improving the time complexity of the attention mechanism, we further optimize GPU memory usage by implementing KV cache offloading, which stores only O(logT) tokens on the GPU while maintaining similar decoding throughput. Experiments on benchmarks show that HiP, with its training-free nature, significantly reduces both prefill and decoding latencies, as well as memory usage, while maintaining high-quality generation with minimal degradation. HiP enables pretrained LLMs to scale up to millions of tokens on commodity GPUs, potentially unlocking long-context LLM applications previously deemed infeasible.

해당 포스트는 다음 내용을 포함하고 있습니다.

- 기초 모델의 dense 벡터 임베딩을 사용한 의미 검색

- 검색 증강 생성(RAG)

- 검색과 대규모 언어모델(LLM)을 결합한 질의 응답 및 요약

- Transformer 기반 LLM 파인튜닝

- 사용자 신호 및 벡터 임베딩을 기반으로 한 개인화된 검색

- 사용자 행동 신호 수집 및 신호 강화 모델 구축

- 도메인별 학습을 위한 의미 지식 그래프

- 멀티모달 검색(텍스트, 이미지 및 기타 유형에 대한 하이브리드 쿼리)

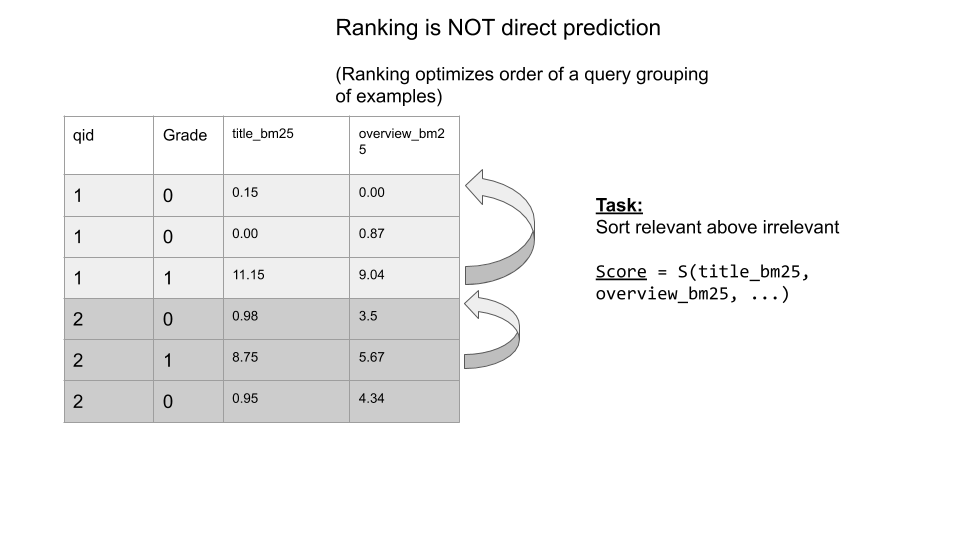

- 일반화 가능한 머신러닝 순위 모델 구현(순위 매기기 학습)

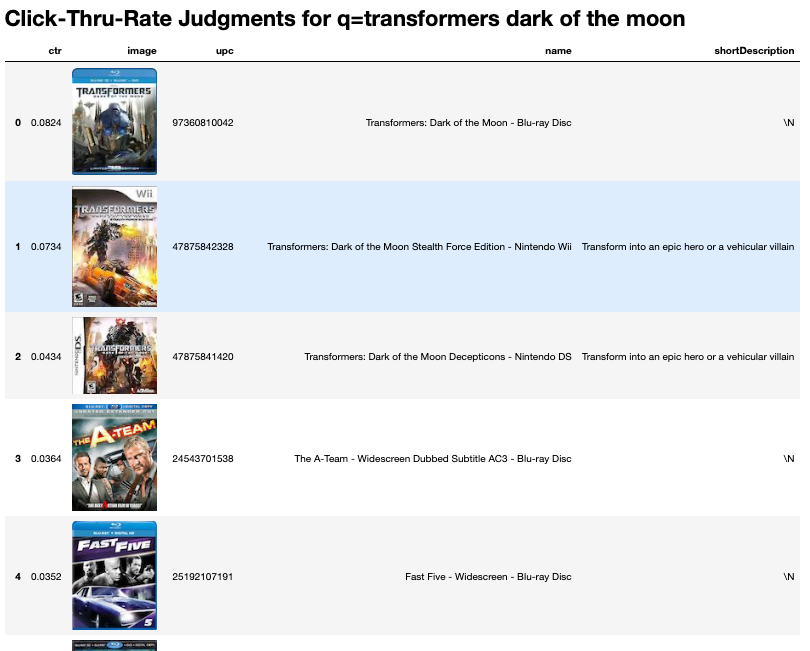

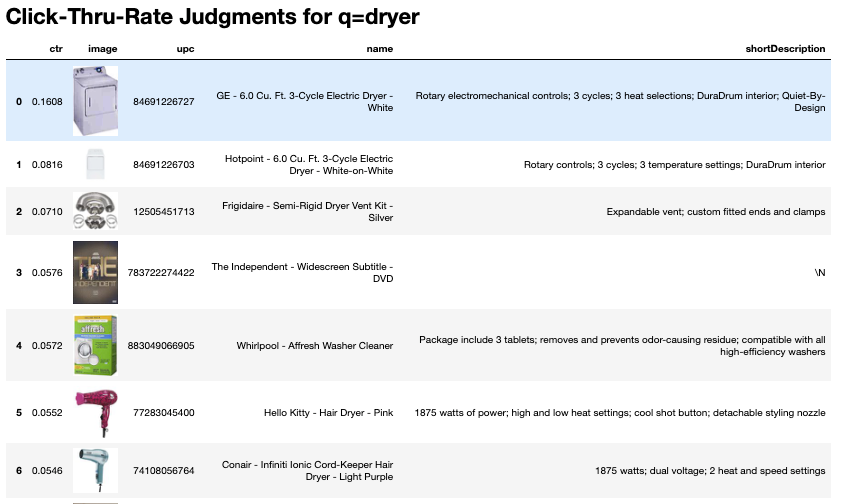

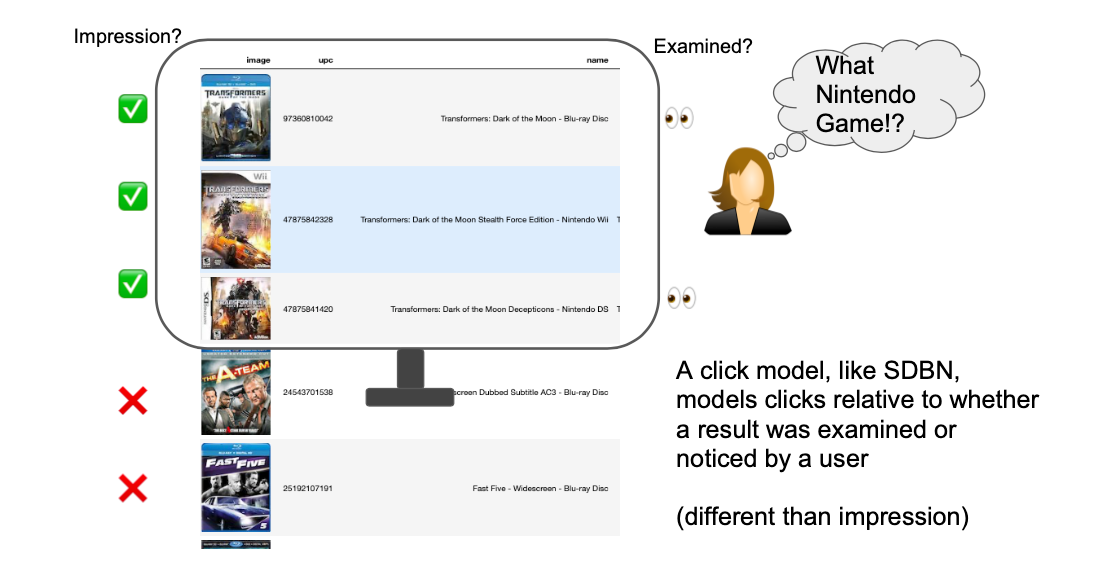

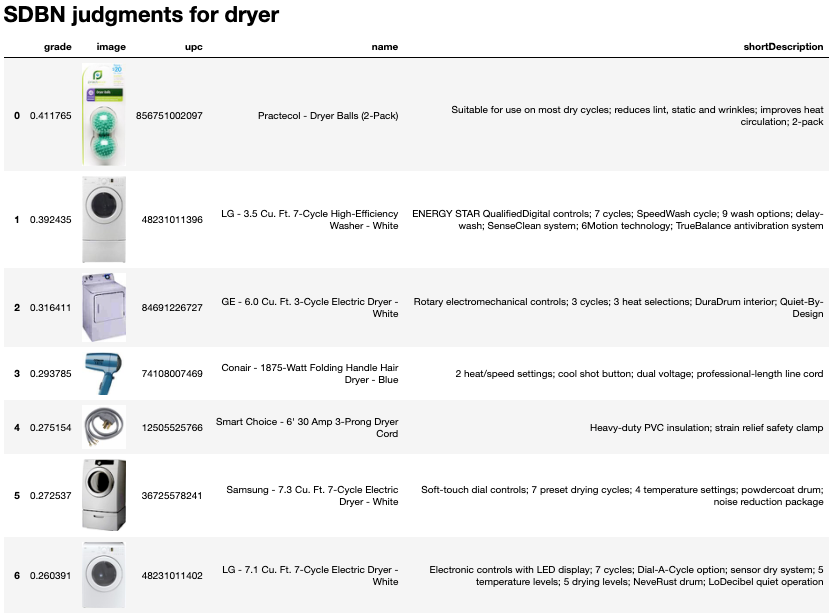

- 머신러닝 순위를 자동화하기 위한 클릭 모델 구축

- ANN 검색, 양자화, 표현 학습, 바이 인코더 대 크로스 인코더와 같은 vector search 최적화 기술

- 생성 검색, 하이브리드 검색 및 검색 프런티어

Part 1: Modern Search Relevance

1. AI 기반 검색 소개

1.1 AI 기반 검색의 필요성

- 현대의 검색 인터페이스 대부분의 현대 애플리케이션에서 데이터와 상호작용하는 기본 사용자 인터페이스로 자리잡았으며, 검색은 모든 디지털 상호작용에서 언제나 사용 가능한 도구로 자리잡고 있음.

- 예시: 구글, 바이두, 빙과 같은 웹사이트를 생각할 때 가장 먼저 떠오르는 것이 검색 엔진으로

- 높아진 기대치 과거에는 “10개의 파란색 티셔츠의 링크”를 제공하는 것이 전부였으나, 현재는 검색 기술의 지능 수준에 대한 기대가 급격하게 상승하였음.

1.2 AI 기반 검색의 작동 방식

- 도메인 인식 특정 사용 사례와 문서의 코퍼스에 대한 엔티티, 용어, 카테고리, 속성을 이해해야

- 맥락적 & 개인화 사용자, 쿼리, 도메인 맥락을 고려하여 사용자 의도를 더 잘 이해

- 대화형 자연어로 상호작용하며 다단계 검색 과정을 안내하고, 새로운 정보를 학습하고 기억

- 멀티모달 텍스트, 음성, 이미지 및 비디오 검색 등을 모두 처리할 수 있음.

- 지능형 예측 입력, 철자 교정, 의도 분류 등을 통해 적시에 적절한 답변을 제공

- 보조적 링크 제공을 넘어 직접적인 답변과 실행 가능한 액션 제공

1.3 AI 기반 검색을 위한 핵심 기술

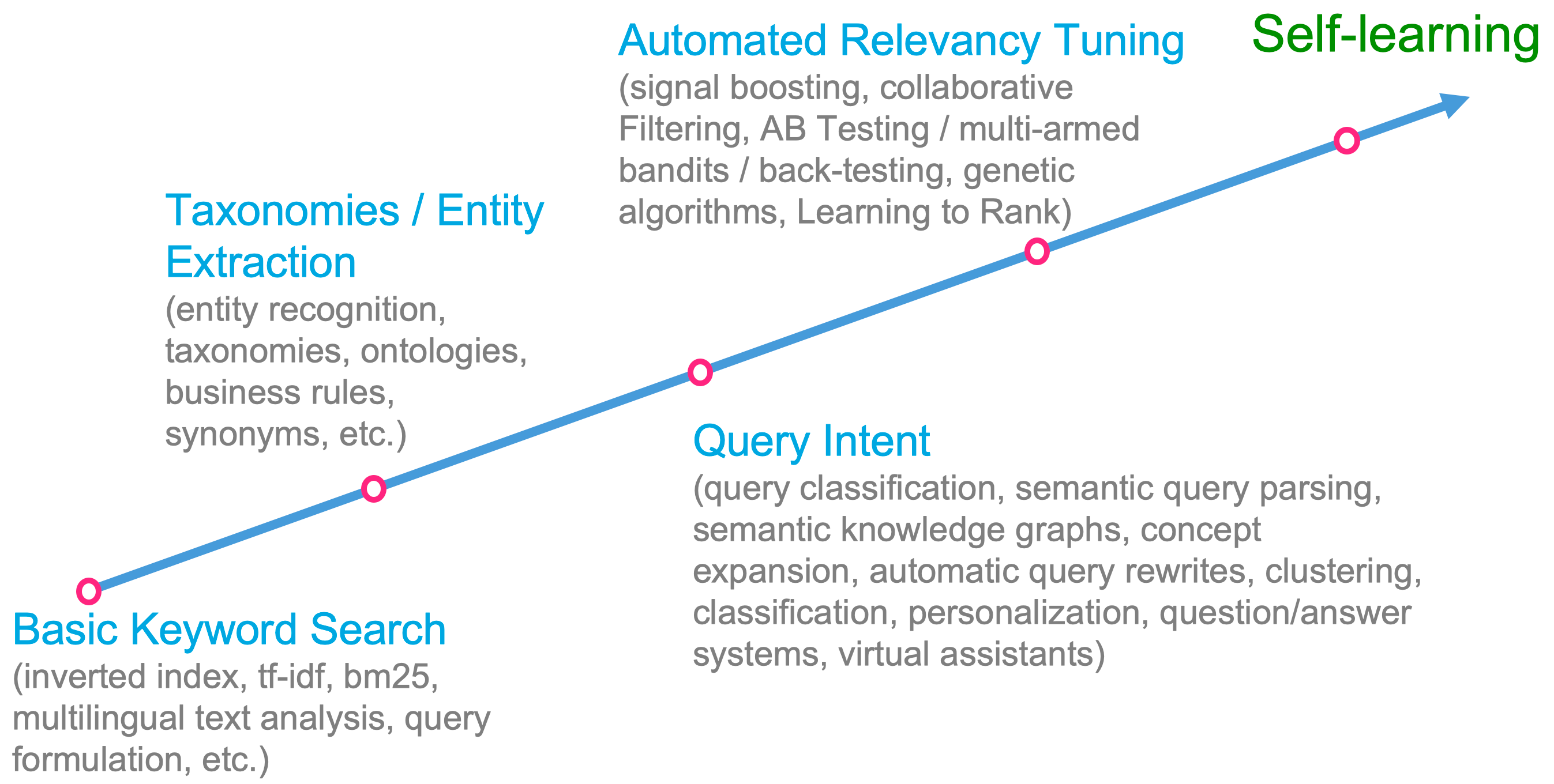

- 자동화 학습 기술 활용 기본 텍스트 검색에서 출발하여 자동화된 학습 기술을 통해 검색 최적화를 수행

TL;DR AI 기반 검색은 현대 애플리케이션에서 사용자 경험을 개선하기 위한 필수 요소로 자리잡고 있으며, 도메인 인식, 개인화, 멀티모달 처리, 지능형 검색 등을 통해 사용자 의도를 보다 정확하게 파악 자동화된 학습 기술을 활용하여 검색 최적화를 구현하고자 하는 모든 조직에 필수적인 가이드로 작용

이미지 및 예시

AI 기반 검색 시스템의 작동 방식 및 흐름을 시각적으로 표현한 다이어그램

- 예시: 패션 상품 검색에서 이미지와 상품 메타 정보를 활용하여 사용자에게 개인화된 추천 제공.

- 인풋 사용자가 업로드한 패션 상품 이미지 및 관련 메타 정보

- 아웃풋 유사한 패션 상품의 목록과 사용자에게 추천되는 관련 상품

- AI 기반 검색을 제공하기 위해서는 사용자 의도를 해석하고 그에 맞는 콘텐츠를 반환하는 과정에서 관련된 다양한 차원을 일관되게 이해하는 것이 중요하며, 정보 검색 분야에서는 검색 엔진과 추천 엔진이 가장 많이 사용되는 기술로, 사용자의 정보 필요를 충족시키기 위해 콘텐츠를 제공

- 많은 조직이 검색 엔진과 추천 엔진을 별도의 기술로 보고, 서로 다른 사용 사례를 해결한다고 생각하지만, 실제로 종종 동일한 조직 내에서 서로 다른 기술 세트를 가진 팀들이 독립적으로 검색 엔진과 추천 엔진을 개발

-

이 섹션에서는 검색과 추천을 별도의 기능 및 팀으로 분리할 때 발생할 수 있는 비효율적인 결과에 대해 설명

- 검색 엔진

- 명시적으로 쿼리를 입력하고, 응답을 받기 위한 기술로 인식됨

- 일반적으로 텍스트 박스를 통해 사용자가 키워드나 자연어 질문을 입력할 수 있도록 제공

- 결과는 보통 리스트 형태로 반환되며, 초기 쿼리를 더 세분화할 수 있는 필터링 옵션이 제공됨

- 사용자가 검색 세션을 마치면, 새로운 쿼리를 입력하고 이전 검색의 맥락을 지우고 새롭게 시작할 수 있음

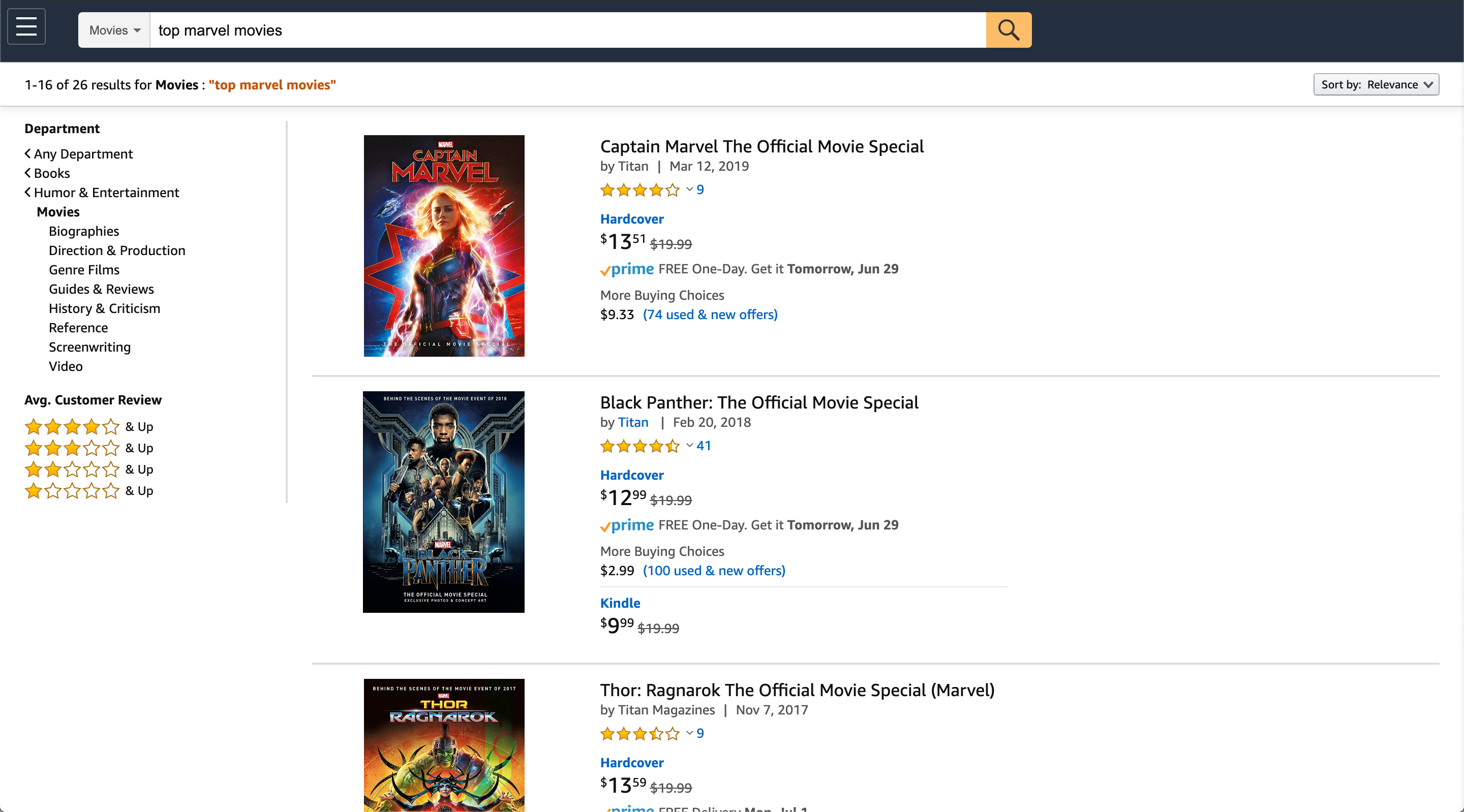

Figure 1.1 일반적인 검색 경험을 보여주는 이미지로, 사용자가 쿼리를 입력하고 필터링 옵션을 통해 검색 결과를 세분화할 수 있는 모습

1.1 사용자 의도 검색

1.1.1 검색 엔진

- 크로스 기능적 시스템으로, 수백만, 수십억, 경우에 따라 수조 개의 문서를 다루며, 동시 쿼리를 처리하고, 수백 밀리초 내에 검색 결과를 제공함

- 실시간 처리 및 신규 데이터에 대한 거의 실시간 검색도 필요하며, 이를 위해 다수의 서버에 걸쳐 병렬 처리 가능해야 함

- 분산 시스템, 동시성, 데이터 구조, 운영 체제, 고성능 컴퓨팅에 대한 깊은 이해가 필요

기술적인 요구 사항이 높기 때문에, 검색 엔진 개발은 여러 전문가와 협업이 필요 검색 엔진은 사용자 의도를 완전히 해석하기 위해 콘텐츠, 사용자, 도메인에 대한 철저한 이해가 필요 이는 추천 엔진 관련 주제를 논의한 후 다시 다룰 것임.

p9

검색 엔진은 대규모 확장성을 염두에 두고 설계되며, 분산 시스템과 동시성, 데이터 구조, 운영 체제, 고성능 컴퓨팅에 대한 깊은 이해를 요구 검색 엔진은 인버티드 인덱스와 같은 검색 전용 데이터 구조를 구축하고, 선형 대수학과 벡터 유사도 점수, 텍스트 분석 및 자연어 처리에 대한 경험이 필요

- 검색 엔진의 주요 요소

- 인버티드 인덱스: 문서의 각 단어를 인덱스하여 빠른 검색을 가능하게 하는 데이터 구조

- 벡터 유사도 점수: 검색 쿼리와 문서 간의 유사도를 측정하여 검색 결과의 정확성을 높이는 방법

- 텍스트 분석 및 자연어 처리: 사용자 쿼리를 보다 정확하게 해석하고 이해하는 데 도움을 줌

검색 엔진의 성능과 관련성 향상을 위해, 검색 팀은 랭킹 모델, A/B 테스트, 클릭 모델, 피처 엔지니어링, 쿼리 해석 및 의도 발견과 같은 도구를 사용 검색 품질을 평가하고 개선하기 위해 데이터 분석가, DevOps 엔지니어, 제품 관리자 등 다양한 전문가의 협력이 필요

p10

추천 엔진은 일반적으로 사용자가 직접 입력하지 않고, 사용자에 대해 알고 있는 정보를 바탕으로 콘텐츠를 제공하는 시스템으로 인식됨. 하지만 이는 과도한 단순화이며, 실제로는 사용자의 브라우징 및 구매 이력을 기반으로 개인화된 콘텐츠를 제공

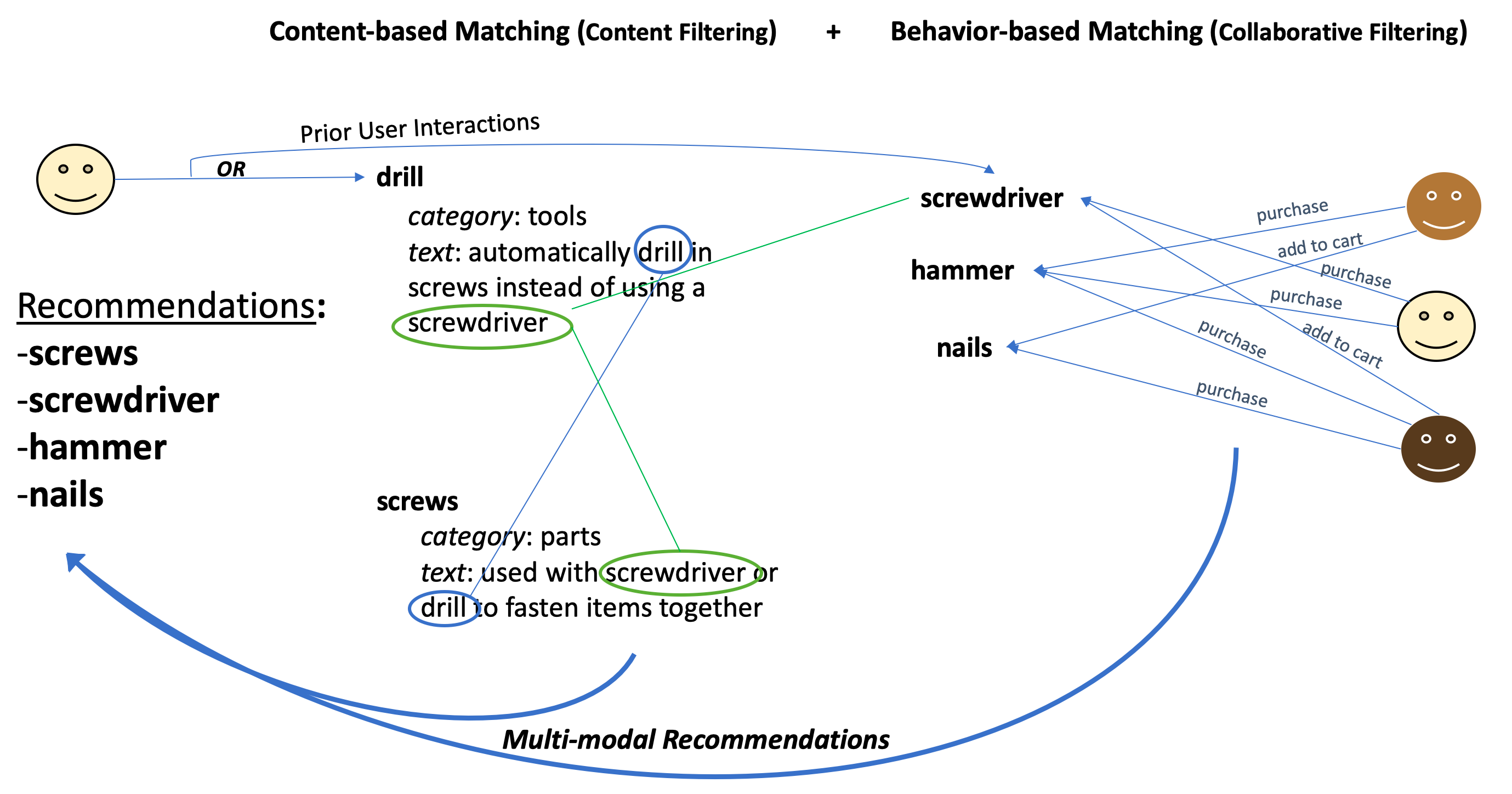

- 추천 엔진의 주요 유형

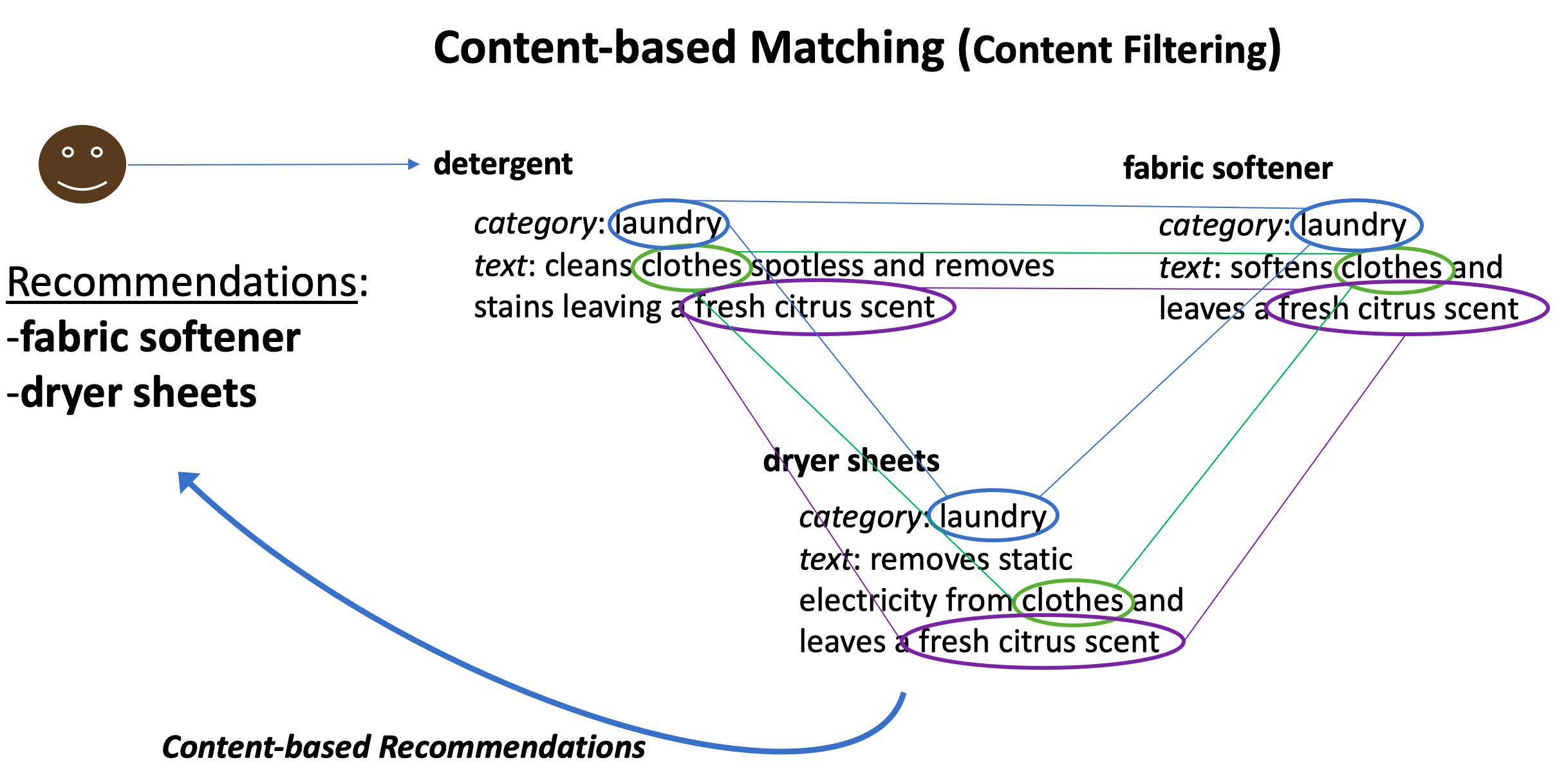

- 콘텐츠 기반 추천: 사용자와 항목 간의 속성을 기반으로 유사한 콘텐츠를 추천

- 행동 기반 추천: 사용자의 행동 패턴을 분석하여 관련 콘텐츠를 추천

- 멀티모달 추천: 여러 종류의 데이터를 결합하여 보다 정교한 추천을 제공

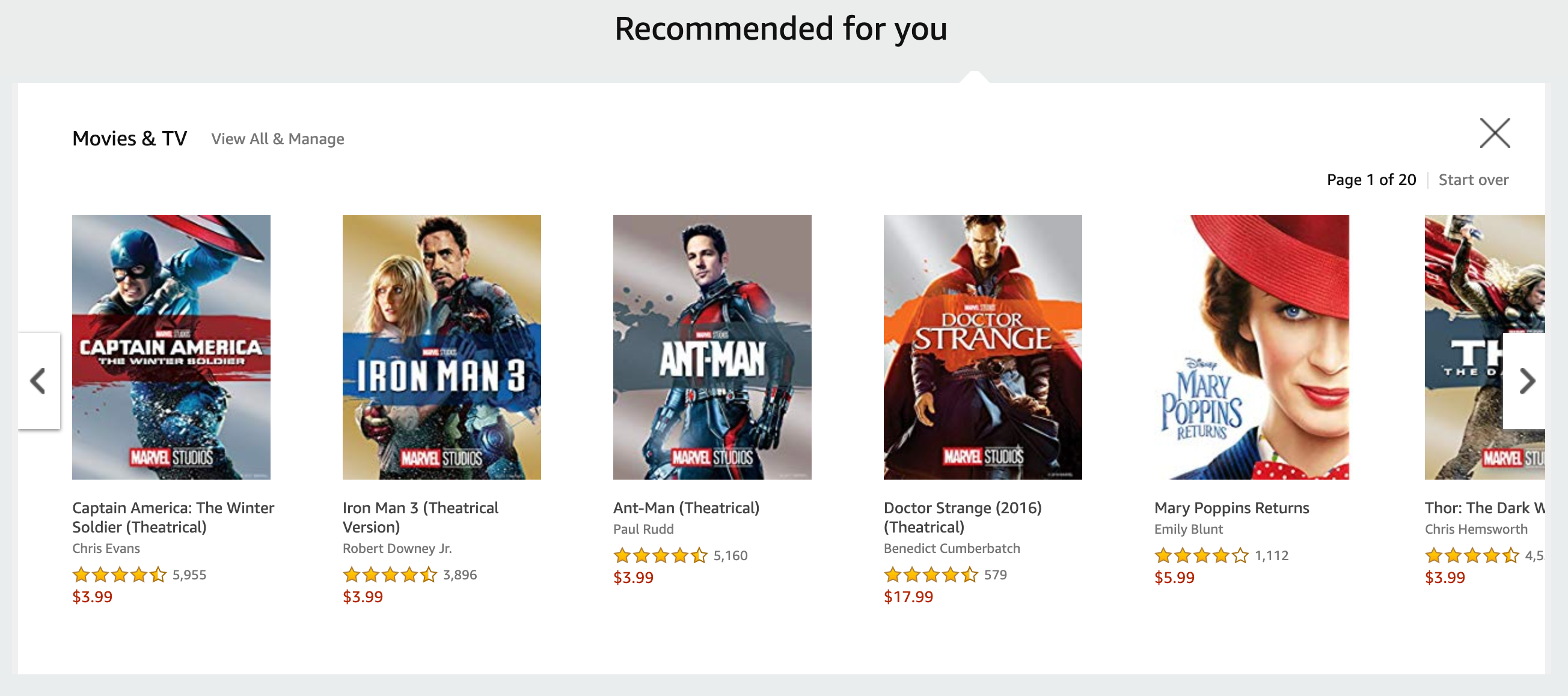

Figure 1.2 사용자의 구매 패턴에 기반하여 유사한 항목을 추천하는 모습

p11

추천 알고리즘은 보통 사용자와 항목 간의 속성을 공유함으로써 새로운 콘텐츠를 추천 예를 들어, 구직 웹사이트에서 사용자는 “직업명”, “산업”, “연봉 범위”, “경력”, “기술”과 같은 속성을 가질 수 있음. 콘텐츠 기반 추천 알고리즘은 이런 속성을 분석하여 사용자가 원하는 속성과 가장 잘 맞는 작업을 추천 이를 사용자-항목 추천이라고

- 콘텐츠 기반 추천 시스템의 예시

- 특정 직무를 좋아하는 사용자가 있으면, 그 직무와 유사한 속성을 가진 다른 직무를 추천함

- 제품 상세 페이지에서 사용자가 이미 관심을 갖고 있는 항목과 관련된 추가 항목을 탐색하도록 도움

Figure 1.3 사용자가 관심을 가진 항목의 속성을 기반으로 유사한 항목을 추천하는 콘텐츠 기반 추천 시스템의 예

TL;DR

- 검색 엔진과 추천 엔진은 사용자 정보를 기반으로 콘텐츠를 제공하는 두 가지 주요 기술임.

- 검색 엔진은 명시적인 쿼리를 기반으로 하고, 추천 엔진은 사용자의 행동 데이터와 속성을 기반으로

- 효과적인 검색 및 추천 시스템은 다양한 전문가의 협력이 필요하며, 사용자 의도를 정확히 파악하는 것이 중요

#

ai-powered-search/

- 추천 시스템 알고리즘에 대한 추가 정보: Recommendation Systems

패션 상품 검색 예시

패션 상품 검색에 AI 기반의 검색 및 추천 시스템을 적용하면, 사용자의 구매 및 브라우징 이력, 선호 스타일 등의 데이터를 기반으로 개인화된 상품을 추천할 수 있음. 예를 들어, 사용자가 특정 스타일의 옷을 검색하면, 유사한 스타일이나 색상, 브랜드의 다른 상품을 추천하여 구매 경험을 향상시킬 수 있음. 이런 시스템은 이미지 메타정보를 활용하여 비슷한 패턴이나 색상의 상품을 자동으로 탐색하고 추천함으로써 사용자 만족도를 높일 수 있음.

콘텐츠 기반 추천 시스템의 맥락에서의 아이템-아이템 추천

아이템-아이템 추천의 개념은 콘텐츠 기반 추천 시스템에서 모든 추천을 설명할 수 있는 중요한 개념임. 각 아이템은 추천받는 다른 엔티티들과 속성을 공유하는 임의의 엔티티로 간주됨.

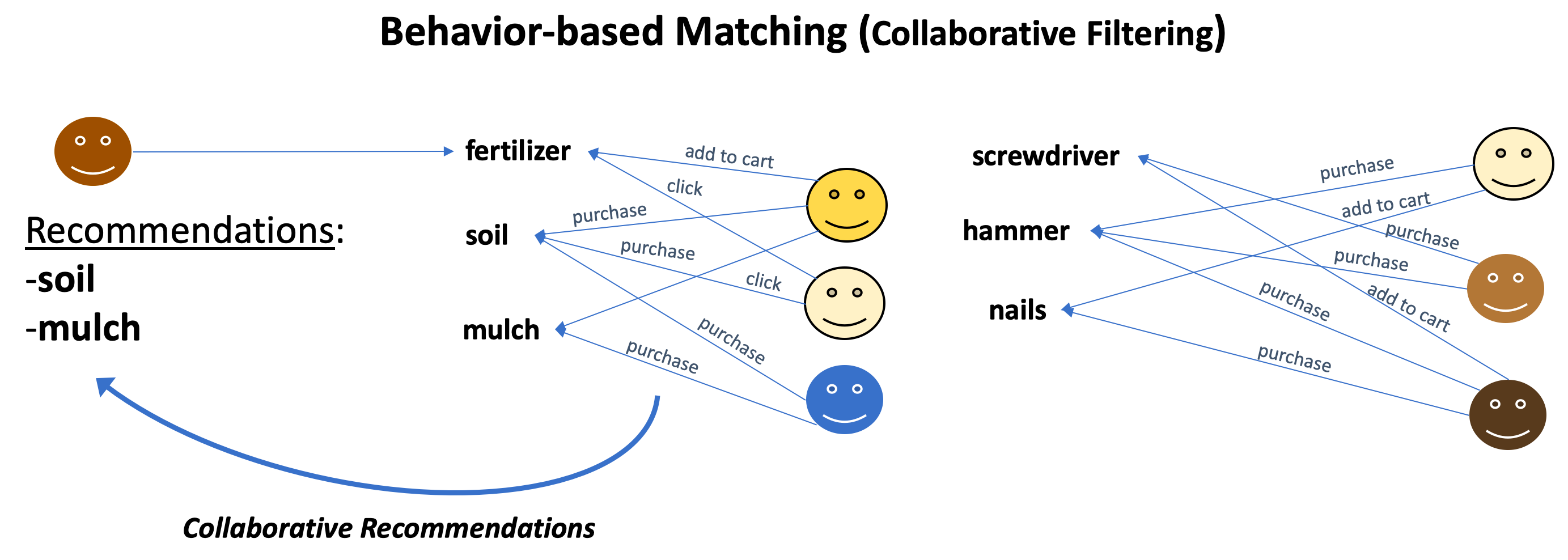

- 알고리즘 사용자와 아이템(e.g., 문서) 간의 상호작용을 활용하여 아이템 그룹 간의 유사한 관심 패턴을 발견하는 방식

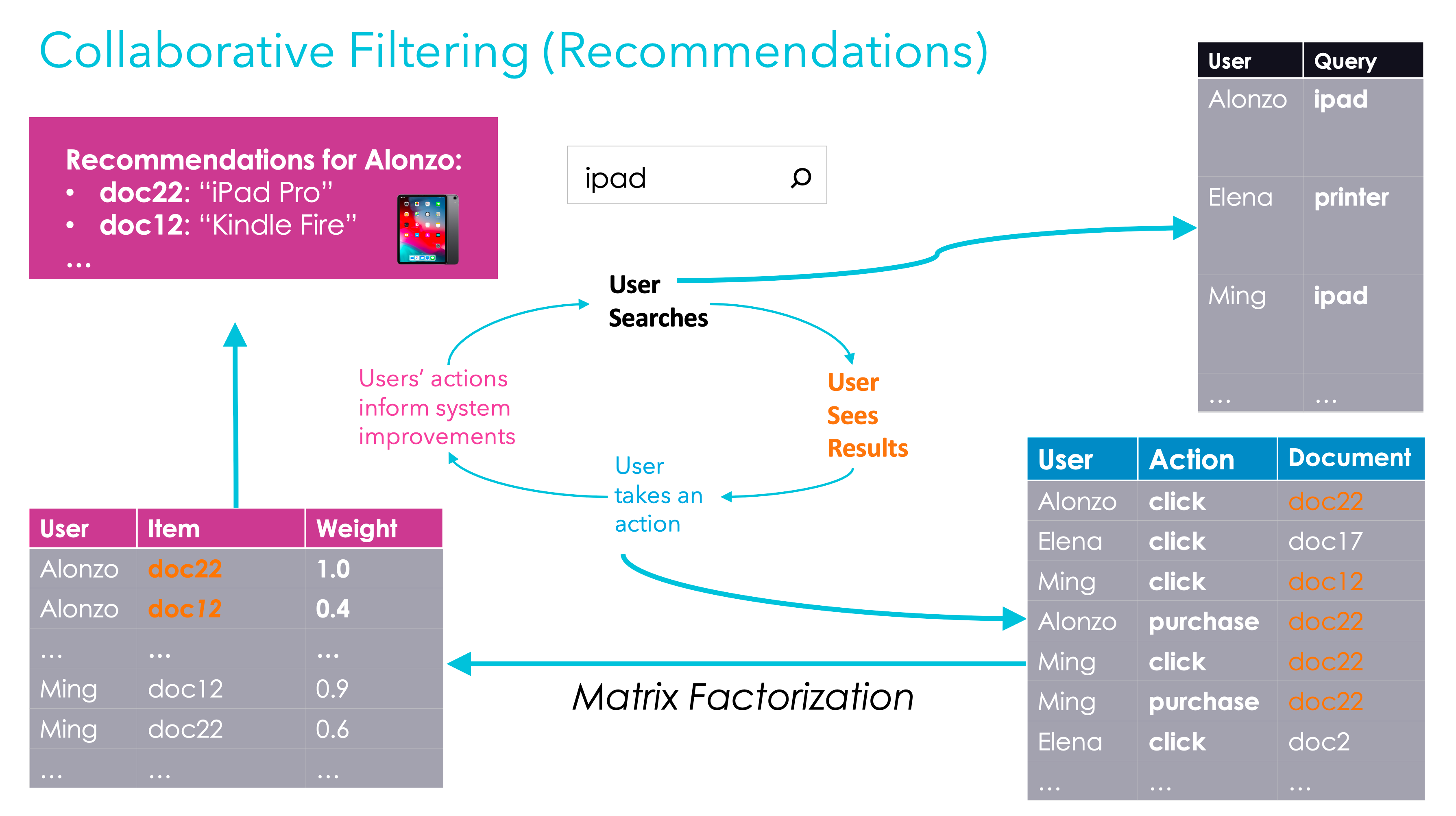

- 협업 필터링 여러 사용자가 참여하는 투표 과정을 통해 가장 높은 유사성을 나타내는 매치를 필터링

- 유사한 사용자(즉, 유사한 선호도를 가진 사용자)는 같은 아이템에 상호작용할 가능성이 높음

- 사용자가 여러 아이템과 상호작용할 때, 비관련 아이템보다 유사한 아이템을 찾고 상호작용할 가능성이 높음

- 협업 필터링 여러 사용자가 참여하는 투표 과정을 통해 가장 높은 유사성을 나타내는 매치를 필터링

협업 필터링의 피쳐

- 크라우드 소싱 방식: 아이템 자체의 피쳐(이름, 브랜드, 색상, 텍스트 등)이 아닌 사용자와 아이템의 상호작용 정보만 필요

- 사용자와 상호작용 수가 많을수록 알고리즘이 똑똑해짐 → 사용자 행동 신호가 많아질수록 더 나은 성과를 보임

Figure 1.4 여러 사용자 간의 행동 신호의 겹침을 활용한 협업 필터링 기반 추천 예시

콜드 스타트 문제와 다중 모드 추천 시스템

- 콜드 스타트 문제 사용자 행동 신호에 의존하다 보니 새로운 아이템에 대한 추천이 어려움

- 다중 모드 추천 시스템 콘텐츠 기반과 행동 기반 추천의 Pros(+)을 결합하여 콜드 스타트 문제를 해결

- 행동 신호가 많을 경우: 협업 필터링 우선

- 행동 신호가 적을 경우: 콘텐츠 기반 매처 활용

Figure 1.5 콘텐츠 기반 매칭과 협업 필터링을 결합한 다중 모드 추천 알고리즘의 작동 방식

핵심 콘텐츠 기반 추천에서 아이템 간 유사성을 활용하여 추천하는 방법을 설명하고, 협업 필터링을 통해 사용자 행동 데이터를 기반으로 더 나은 추천을 제공할 수 있음을 보임. 다만, 콜드 스타트 문제를 해결하기 위해 다중 모드 추천 시스템을 도입하여 콘텐츠 기반과 행동 기반 추천의 Pros(+)을 결합

검색 엔진과 추천 엔진의 비교

- 검색 엔진 사용자의 명시적 쿼리에 의해 작동

- 추천 엔진 명시적 사용자 입력 없이 기존에 알고 있거나 인퍼런스된 지식에 기반하여 사용자가 원하는 내용을 추천

사례

- 사용자가 뉴욕에서 “steamed bagels”를 검색했을 때 다른 지역의 결과가 나오는 문제

- 공항에서 “driver”를 검색했을 때 골프 클럽이나 드라이버 관련 결과가 나오는 문제

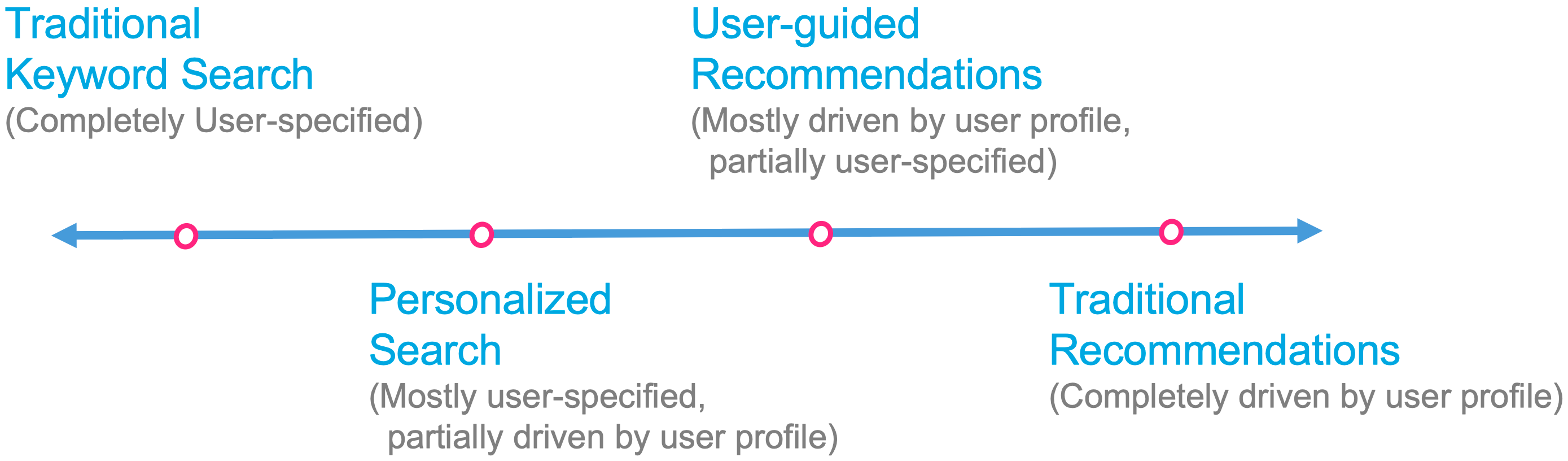

정보 검색 연속체와 개인화된 검색

- 개인화된 검색 사용자 입력과 사용자의 특정 의도 및 선호도를 결합하여 사용자 맞춤 결과 제공

- 사용자 프로필을 활용하여 검색 및 추천 개선 가능

- 사용자의 선호도를 기반으로 추천 엔진의 정확도를 높일 수 있음

Figure 1.6 개인화 스펙트럼, 전통적 키워드 검색과 전통적 추천의 연속체

핵심 검색 엔진과 추천 엔진은 사용자 요청을 처리하는 방식에서 차이가 있으며, 개인화된 접근을 통해 사용자 프로필을 활용하여 더 나은 결과를 제공할 수 있음. 개인화 스펙트럼을 통해 다양한 정보 검색 방법을 설명

통합 접근 방식을 통한 검색 및 추천 최적화

1.1 검색과 추천의 통합 문제

검색과 추천 시스템은 종종 별개의 문제로 인식되며 이는 DataScience Team과 Engineering Team 간의 분리된 개발로 이어지고, 각 팀은 서로 다른 목표를 가지고 시스템을 구축하게 되는 문제가 발생

- DataScience Team: 개인화 및 세분화 모델 구축

- Pros(+): 특정 콘텐츠 추천에 강점

- Cons(-): 검색 기능 부족

- Engineering Team: 대규모 키워드 매칭 엔진 구축

- Pros(+): 대량의 데이터를 빠르게 처리

- Cons(-): 개인화 모델 활용 어려움

Conway’s Law: 조직은 자신의 커뮤니케이션 구조를 반영한 시스템을 설계 이는 검색과 추천 간의 분리를 심화시킴 → 결과적으로 통합된 개인화 스펙트럼을 최적화하기 어려움.

TL;DR

- 검색과 추천을 별개로 인식하면 통합적 성능 저하 발생.

- Conway’s Law에 따라 조직 구조가 시스템 설계에 영향을 미침.

- 통합적 접근 필요.

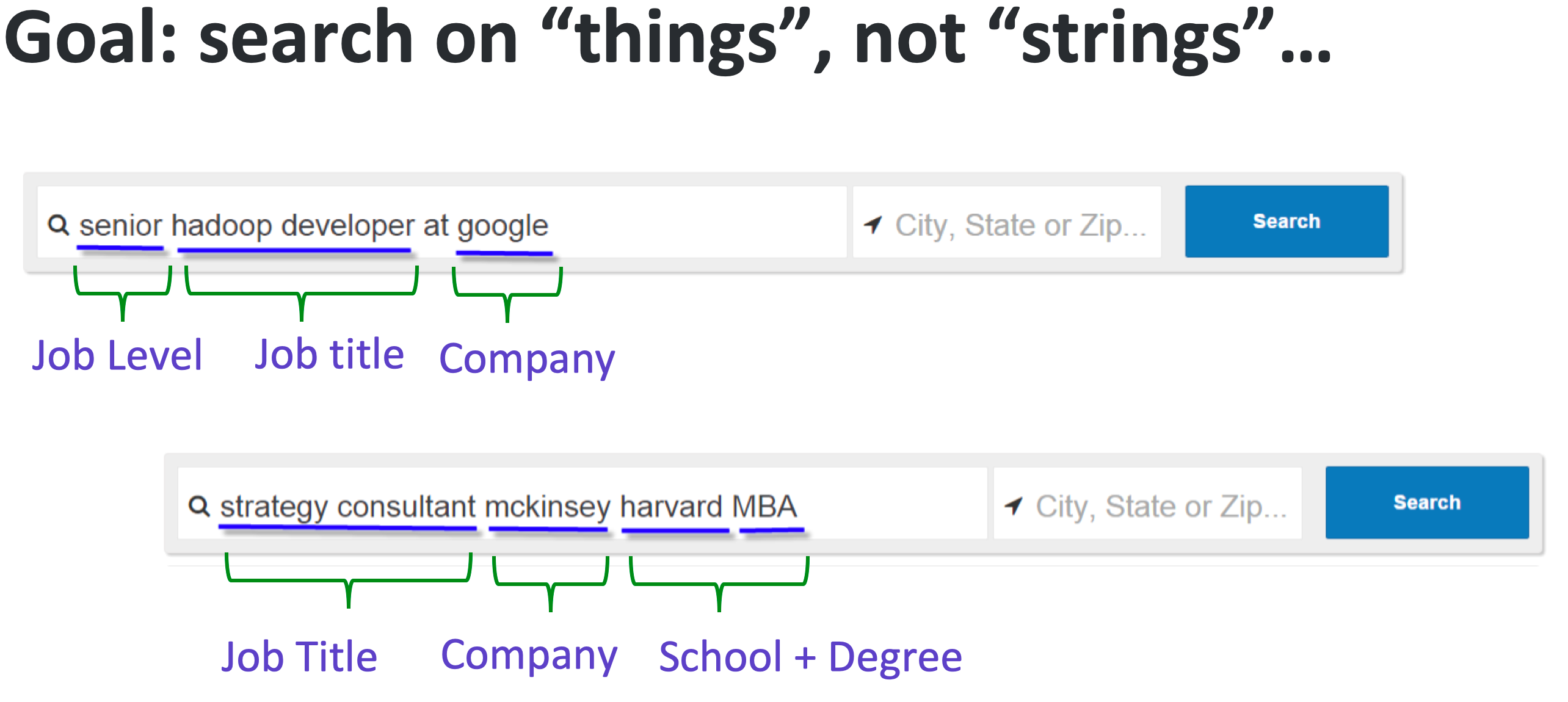

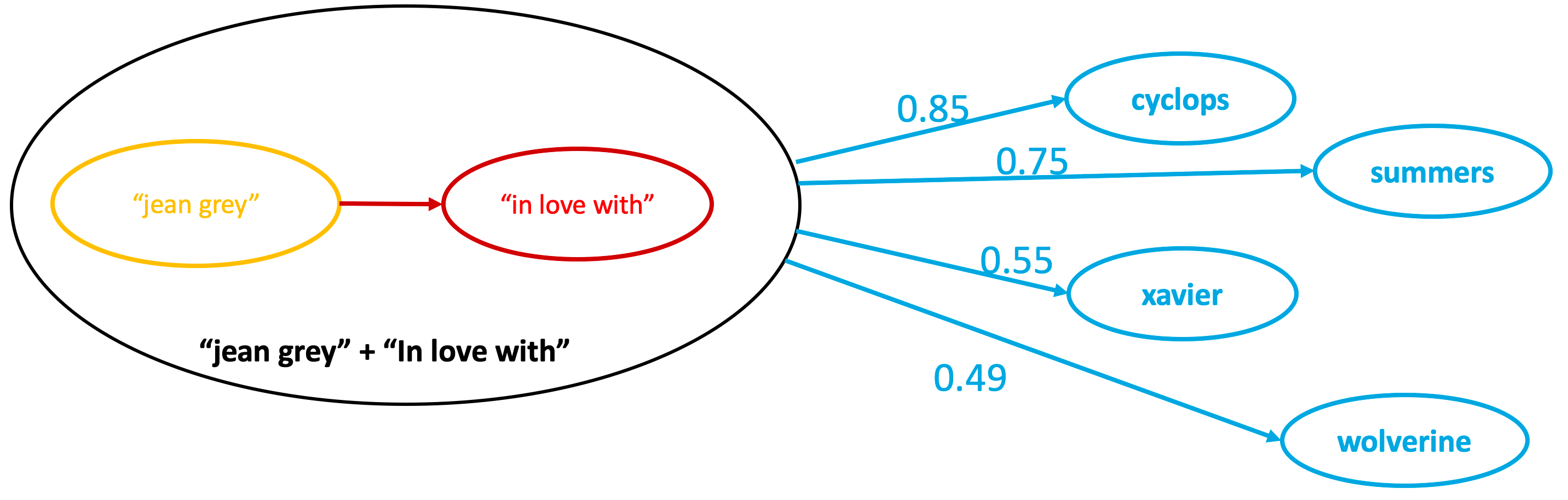

1.1.4 의미론적 검색과 지식 그래프

의미론적 검색은 도메인에 대한 깊은 이해를 요구하며, 지식 그래프를 활용하여 쿼리의 의미를 파악

쿼리 내의 엔티티를 이해하여 ‘문자열’이 아닌 ‘사물’을 검색하는 과정을 시각화한 이미지

쿼리 내의 엔티티를 이해하여 ‘문자열’이 아닌 ‘사물’을 검색하는 과정을 시각화한 이미지

대기업들은 엔티티 관계를 이해하기 위해 사전과 지식 그래프를 수작업으로 구축해 왔으나, AI 기반 검색 엔진은 이런 정보를 자동으로 학습하게 되고, 이는 확장 가능한 솔루션을 제공할 수 있음을 의미

- AI 기반 검색 엔진: 지속적인 학습을 통해 도메인 지식 획득

- Pros(+): 자동화된 의미론적 이해, 확장성

TL;DR

- 의미론적 검색은 도메인 지식 필요.

- AI 기반 검색 엔진은 자동화된 학습으로 도메인 지식 획득.

- 지식 그래프는 쿼리의 의미를 효과적으로 파악하는 데 기여.

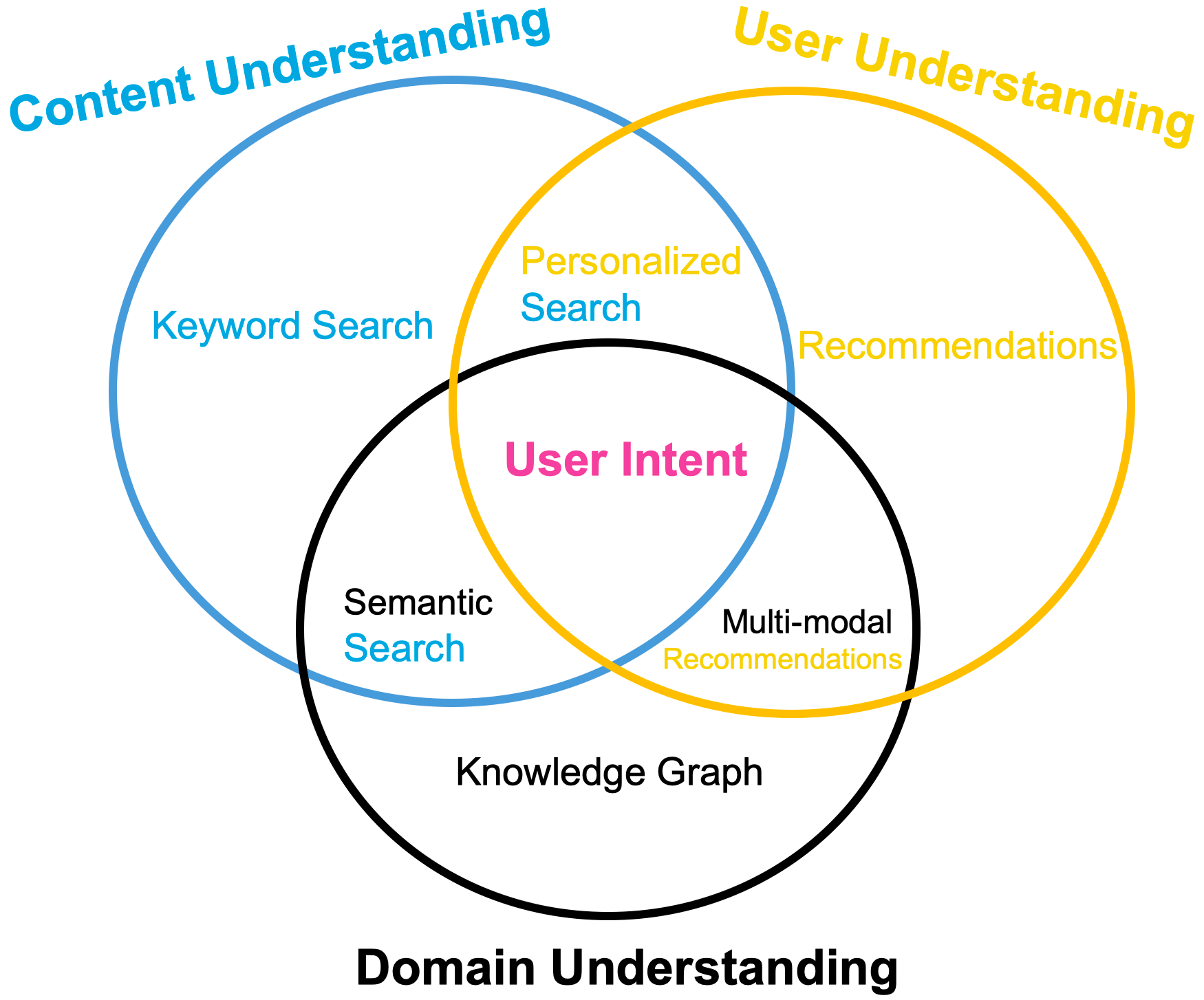

1.1.5 사용자 의도 이해의 차원

사용자 의도를 이해하기 위해서는 세 가지 요소가 필요함: 콘텐츠 이해, 사용자 이해, 도메인 이해.

사용자 의도를 이해하기 위한 세 가지 요소 간의 상호작용

- 콘텐츠 이해: 키워드 매칭

- 사용자 이해: 개인화된 결과 제공

- 도메인 이해: 도메인 내에서의 의미 파악

이 요소들이 통합되면, AI 기반 검색은 모든 사용자 쿼리에 대해 전문가 수준의 이해와 매칭을 수행 가능

TL;DR

- 사용자 의도 이해에 필요한 세 가지 요소: 콘텐츠, 사용자, 도메인 이해.

- 이들 요소의 통합은 AI 기반 검색의 성능을 극대화

- 전문가 수준의 이해와 매칭 가능.

1.2 AI 기반 검색을 위한 핵심 기술

AI 기반 검색 시스템을 구축하기 위한 주요 기술

- 프로그래밍 언어: Python

- 데이터 처리 프레임워크: Spark (PySpark)

- 배포 메커니즘: Docker Containers

- 코드 설정 및 워크스루: Jupyter Notebooks

- 검색 엔진: Apache Solr

추가적으로 고려할 수 있는 검색 엔진

- Lucene, Elasticsearch, Open Search, Lucidworks Fusion, Milvus, Vespa

TL;DR

- AI 기반 검색을 위한 주요 기술: Python, Spark, Docker 등

- 다양한 검색 엔진 옵션 제공

- 책의 예제는 이런 기술을 기반으로 설명

기술적 선택과 구현

1.2.1 프로그래밍 언어: Python

- Python 선택 이유

- 데이터 과학자와 소프트웨어 엔지니어 모두에게 유명한 언어

- 데이터 과학 분야에서 가장 많이 사용됨

- 소프트웨어 엔지니어링 분야에서 C와 Java 다음으로 많이 사용됨

- 데이터 과학 프레임워크 대부분이 Python으로 작성되었거나 Python 바인딩을 제공

- 초심자에게도 읽기 쉽고 접근성이 높음

- 데이터 과학자와 소프트웨어 엔지니어 모두에게 유명한 언어

1.2.2 데이터 처리 프레임워크: Spark (PySpark)

- Apache Spark의 Pros(+)

- 대규모 데이터 처리에 적합

- 단일 서버에서도 실행 가능하지만, 대규모 클러스터로 확장 가능

- 데이터 프레임을 사용하여 다양한 데이터 소스에서 데이터를 처리하고 저장 가능

- Apache Solr와 Elasticsearch와 같은 검색 플랫폼과 통합하여 데이터 처리 및 검색 데이터 강화 가능

1.2.3 전달 메커니즘: Docker 컨테이너

- Docker 활용 이유

- 수백 개의 라이브러리와 종속성을 포함한 환경 설정을 간소화

- 운영 체제 간의 버전 충돌 없이 코드 실행 가능

- Jupyter 노트북과 결합하여 코드 예제를 쉽게 실행하고 실험 가능

1.2.4 코드 설정 및 워크스루: Jupyter 노트북

- Jupyter 노트북의 Pros(+)

- 코드 예제를 튜토리얼 형태로 제공

- 코드 변경 및 실행이 웹 브라우저에서 간편히 가능

- 시스템 명령어 없이도 코드 실행 가능하게 설계

1.2.5 검색 엔진 기술 선택

- Apache Solr 선택 이유

- 오픈 소스이면서 Lucene 기반의 검색 엔진

- Solr의 고유 기능 (e.g., 텍스트 태거, 시맨틱 지식 그래프 등) 활용 가능

- Elasticsearch와 달리 2021년 이후 오픈 소스 유지

- Lucene 기반의 다른 엔진 사용자에게도 개념 전이 용이

TL;DR

- Python은 데이터 과학과 소프트웨어 엔지니어링 모두에서 널리 사용되며, Spark는 대규모 데이터 처리에 적합.

- Docker와 Jupyter 노트북을 활용하여 코드 배포와 실행을 간소화하고, Solr를 기반으로 한 예제를 통해 검색 엔진 기술을 설명.

- Lucene 기반의 Solr는 오픈 소스로, AI 기반 검색에 필요한 다양한 기능을 제공하며, 다른 Lucene 기반 엔진 사용자에게도 유용.

추가 자료

패션 상품 검색 적용 예시

- 적용 시나리오

- 이미지와 상품 메타 정보를 기반으로 유사한 패션 상품을 검색

- 모델 예시 Convolutional Neural Network (CNN)

- Input 패션 이미지 데이터셋

- Output 이미지 피쳐 벡터

- Spark를 활용하여 대량의 이미지 데이터를 병렬 처리

- Solr를 사용하여 인덱싱된 데이터에서 빠른 검색 수행

해당 기법을 통해 대규모 패션 상품 데이터베이스에서 사용자에게 적합한 상품을 빠르게 추천할 수 있음.

기술적 분석과 구현 전략

1. OpenSearch 프로젝트의 배경

- OpenSearch: Elasticsearch의 오픈 소스 포크 → Amazon이 2021년 4월에 출시

- 배경: Elastic이 2021년 1월에 오픈 소스 라이선스를 포기함

- 목표: Elasticsearch와 Solr의 오픈 소스 대안 제공

- 전망: Amazon의 관리 하에 프로젝트의 발전 방향이 결정될 것임

TL;DR

- OpenSearch는 Amazon에 의해 개발된 Elasticsearch의 오픈 소스 포크

- Lucidworks Fusion은 AI 기반 검색 기능을 즉시 제공하는 상업 솔루션

- Milvus와 Vespa는 벡터 및 텍스트 검색 기능을 결합한 차세대 검색 엔진

2. AI-Powered 검색의 진화

2.1 자연어 모델의 발전

- 자연어 모델의 발전: 쿼리와 문서를 dense 벡터 공간에 맵핑하는 새로운 검색 및 랭킹 메커니즘 생성

- 신경망 검색: dense vector search 방법에 기반

- Milvus: 오픈 소스 벡터 데이터베이스, 효율적인 벡터 인덱싱 및 근사 최근접 이웃 검색 제공

- Vespa: 전통적인 키워드 검색 엔진 + 벡터 및 텐서 지원 → 다차원 데이터 검색 가능

2.2 Jina 프레임워크

- Jina: 신경망 검색 시스템을 구축하기 위한 오픈 소스 프레임워크

- 기능: 문서 및 쿼리 처리 파이프라인 개발 지원

- 초점: 차세대 검색 기능 통합, 예를 들어 시맨틱 검색, 질문 답변, 멀티모달 검색 등

3. AI-Powered 검색의 대상 독자와 요구 사항

3.1 대상 기술 세트와 직업

- 대상 독자: 검색 엔지니어, 소프트웨어 엔지니어, 데이터 과학자

- 요구 기술: Solr 또는 Elasticsearch와 같은 검색 기술에 대한 기본 이해

3.2 시스템 요구 사항

- 하드웨어: 최소 8GB RAM, 25GB 디스크 공간

- 소프트웨어: Java 8+, Docker, Mac/Linux/Windows 환경

4. AI-Powered 검색의 구현 단계

4.1 설치와 기본 설정

- Elasticsearch/OpenSearch, Solr, Vespa 설치 → 문서 인덱싱

- 기본 키워드 매칭 필요 시: 복잡한 AI 기능 도입 전 신중한 접근 필요

4.2 검색 지능의 발전

- 검색 지능의 발전: 기본 키워드 검색에서 시작해, 검색 관련성 개선을 위한 수작업 튜닝 → AI 기반 검색 기능 도입

검색 지능의 전형적인 발전 과정, 기본 키워드 검색에서 시작해 자가 학습 검색 플랫폼으로 발전

검색 지능의 전형적인 발전 과정, 기본 키워드 검색에서 시작해 자가 학습 검색 플랫폼으로 발전

소결

- AI 기반 검색: 검색 관련성을 크게 향상시키는 복잡한 기능을 제공함

- 각 기술의 강점을 이해하고 적절히 활용할 필요성 강조

- AI-powered 검색의 구현은 복잡성과 리소스를 고려하여 신중히 접근해야 함

이 책은 AI 기반 검색의 다양한 기술을 다루며, 독자가 이런 기술을 효과적으로 활용할 수 있도록 돕는 것을 목표로

AI 기반 검색 엔진의 도입과 발전

1. 검색 기능의 도메인 이해 및 개선

- 시작: 검색 기능에 도메인 이해를 주입하는 필요성 인식

- 조직: 동의어 목록, 분류 체계, 알려진 엔티티 목록, 도메인 전용 비즈니스 규칙 등에 투자

- 목표: 사용자 쿼리를 성공적으로 해석하고 사용자 의도를 이해하는 것

- 해결책: 쿼리 분류, 의미론적 쿼리 파싱, 지식 그래프, 개인화 등의 기술에 투자

- 성공: 사용자 신호 및 테스트를 통해 자동화된 프로세스로 발전

- 방법: A/B 테스트, 멀티암드 밴딧, 오프라인 관련성 시뮬레이션 등

- 목표: 검색 인텔리전스의 모든 단계를 자동화하고 엔진의 자가 학습 가능하게 함

2. 전통적 키워드 검색과 관련성 엔지니어링

- 시작: 전통적 키워드 검색 구축이 첫 단계

- 관련성 엔지니어링: 검색 관련성 최대화를 위한 콘텐츠 이해, 부스트 조정, 쿼리 파라미터 조정

- 발전: 사용자 이해 및 추천 영역으로 확장하며 도메인 이해 및 의미론적 검색으로 진화

- AI 기반 검색 엔진과 전통적 검색 엔진의 차이

- 전통적 엔진: 최적화된 검색 경험 제공

- AI 기반 엔진: Reflected Intelligence를 통해 지속적으로 학습하고 개선

TL;DR 검색 기능의 개선은 도메인 이해 주입에서 시작하며, 사용자 쿼리 해석 및 의도 이해가 중요 전통적 키워드 검색이 기초를 제공하며, AI 기반 검색 엔진은 Reflected Intelligence를 통해 지속적인 학습과 개선을 가능하게

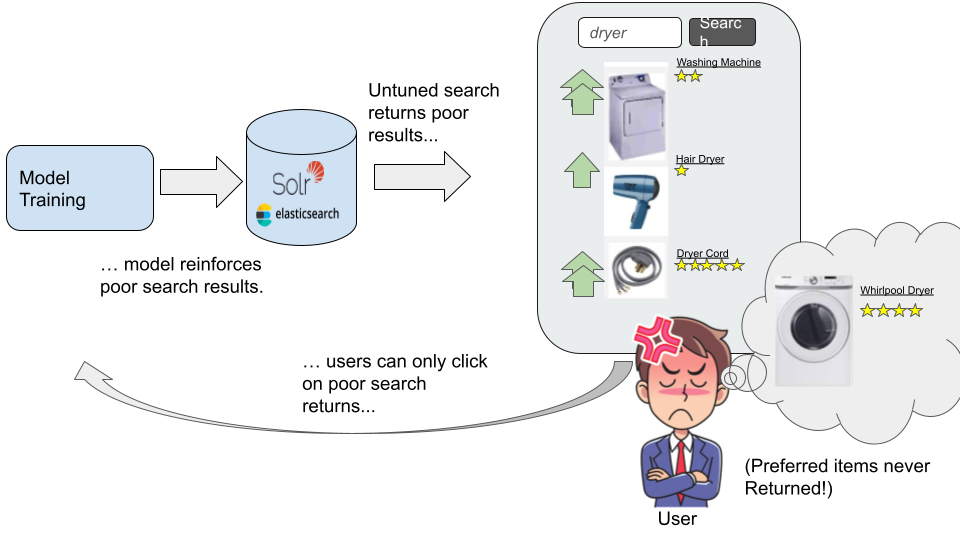

3. Reflected Intelligence와 피드백 루프

- 개념: 사용자 입력, 콘텐츠 업데이트, 사용자 상호작용을 활용하여 검색 품질 지속 개선

- 피드백 루프: 교육에 비유하여, 상호작용 없이는 학습이 어려움

- 검색 엔진: 피드백 루프를 통해 상호작용 학습 시스템에 적합

- 피드백 루프의 흐름

- 사용자 쿼리 발행 → 검색 수행 → 결과 반환

- 사용자의 행동: 클릭, 장바구니 추가, 구매 등

- 행동 분석: 검색 결과의 관련성에 대한 단서 제공

- 피드백 루프의 적용

- 예시: 특정 쿼리에서 결과 3번에 대한 클릭이 많으면 결과 정렬 자동 조정

- 목표: 지속적인 검색 경험 개선

4. 사용자 신호와 콘텐츠의 역할

- 신호: 사용자 상호작용의 데이터 포인트

- 예시: 검색, 클릭, 구매 등의 모든 상호작용 기록

- 머신러닝 알고리즘 활용: 사용자, 콘텐츠, 도메인 이해 모델 생성

- 콘텐츠의 역할

- 도메인 모델: 문서의 키워드, 카테고리, 엔티티를 통해 도메인 이해

- 의미론적 그래프: 도메인 데이터의 강력한 의미론적 검색 지원

TL;DR 피드백 루프는 검색 품질을 지속적으로 개선하며, 사용자 신호와 콘텐츠는 AI 기반 검색 엔진의 지능 엔진을 구동하는 두 가지 주요 요소임. 신호는 사용자의 상호작용을 기록하고, 콘텐츠는 도메인을 이해하는 데 중요한 역할을

5. 패션 상품 검색에 대한 적용 예시

- 이미지와 상품 메타 데이터 기반 검색

- 사용 모델: CNN(Convolutional Neural Network), RNN(Recurrent Neural Network)

- 인풋: 상품 이미지, 텍스트 설명

- 아웃풋: 관련 상품 리스트, 추천 상품

- 적용 방법

- 이미지 인식: CNN을 통해 상품 이미지의 피쳐 추출

- 메타 데이터 분석: RNN을 통해 텍스트 설명의 의미론적 이해

- 사용자 피드백: 클릭, 구매 등의 행동을 신호로 활용하여 검색 결과 최적화

이런 방식으로, 패션 상품 검색에 AI 기반 검색 엔진을 적용하면 사용자의 실제 클릭 및 구매 데이터를 활용해 추천 결과를 지속적으로 개선할 수 있음

AI 기반 검색 엔진의 설계와 구현 방법

p32

- Deep Learning의 복잡성

- 현대의 많은 AI 기법들이 인공 신경망 기반의 딥러닝에 의존

- 딥러닝 모델의 내부 복잡성으로 인해 특정 예측이나 출력에 기여하는 요소를 휴먼이 이해하기 어려움 → “Black Box AI” 문제 발생

- 잘못된 판단을 내릴 때 디버깅 및 수정이 어려움.

- 따라서, Explainable AI 또는 Interpretable AI와 같은 분야가 등장하여 이런 모델을 이해, 관리 및 신뢰할 수 있도록

- AI-보조 휴먼 큐레이션

- 이 책에서는 AI를 사용하여 검색 지능을 자동화하되, 휴먼이 개입하여 자신의 전문 지식을 투입할 수 있도록

- 휴먼이 표현할 수 있는 형태로 지능을 만들고, 이를 휴먼 지능으로 수정 및 보강하는 것을 목표로

- AI-보조 검색 엔진의 아키텍처는 여러 빌딩 블록을 조합해 스마트한 엔드 투 엔드 시스템을 구축해야

- 구성 요소

- 코어 검색 엔진: Solr, Elasticsearch/OpenSearch, Vespa 등

- 검색 가능 콘텐츠를 엔진에 피드하여 유용하게 변환 → 문서 분류, 필드 값 정규화, 텍스트에서 엔티티 추출, 감정 분석, 콘텐츠 클러스터링, 구문 탐지 및 주석, 추가 데이터 통합 등

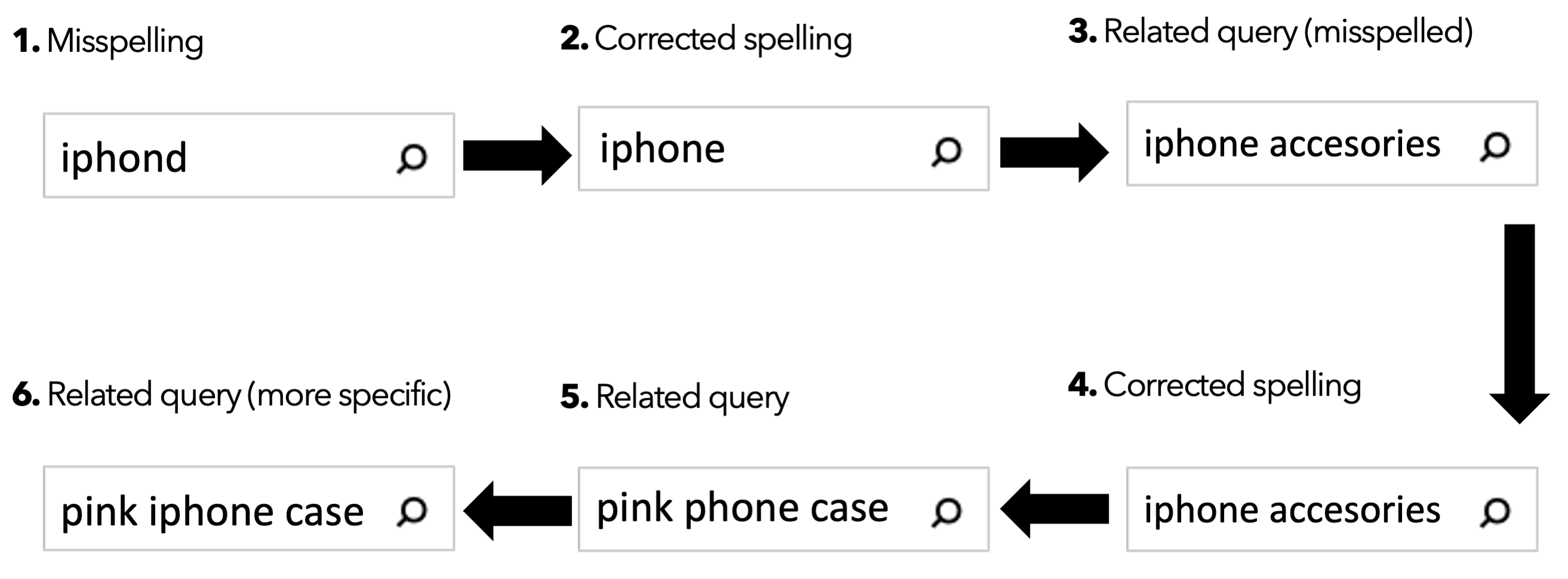

- 이후, 쿼리 파이프라인을 통해 들어오는 쿼리를 구문 분석하고, 구문 및 엔티티 식별, 관련 용어/동의어 및 개념 확장, 철자 오류 수정 등을 수행하여 코어 엔진이 가장 관련성 높은 결과를 찾을 수 있도록 쿼리를 재구성

p33

- 도메인 지식의 중요성

- 쿼리 지능에는 도메인에 대한 강력한 이해가 필요

- 사용자 신호와 콘텐츠에 대한 배치 작업 실행 → 패턴 학습 및 도메인 특화 지능 도출

- 예: 사용자 오타 및 교정 선택(6장), 인기 문서 부스팅(8장), 미지의 쿼리에서 최적의 랭킹(10장)

- 실시간 쿼리 처리

- 쿼리는 실시간으로 처리되어야 하며, 밀리초 단위로 반환이 기대됨.

- Spark 등 작업 처리 프레임워크 및 워크플로우 스케줄링 메커니즘 필요.

- 사용자 신호의 지속적인 수집 및 저장 메커니즘도 필요

- 신호 모델 생성: 인기 쿼리 항목 부스팅, 전체 쿼리 적용 학습 랭킹 모델, 사용자별 추천 및 개인화 선호도 생성

- 지속적인 학습 및 개선

- 시스템은 지속적인 문서 변경 및 사용자 신호 스트림을 수신하고, 이를 통해 모델을 학습 및 개선하며, 지속적으로 검색 결과를 조정하고 변화의 영향을 측정하여 보다 지능적인 결과 제공.

p34

- 고도화된 검색 기대

- 도메인 인식, 컨텍스트 인식, 개인화, 대화형, 다중 모드(텍스트, 음성, 이미지 등) 검색 기대

- 정보 검색 내에서 검색과 추천은 개인화 스펙트럼의 양 극단

- 사용자 의도 해석: 콘텐츠, 사용자 및 플랫폼의 도메인 지식 동시 이해 필요

- 최적 검색 관련성: 개인화 검색, 시맨틱 검색, 다중 모드 추천의 교차점

- 이 책의 기술은 대부분의 검색 플랫폼에 적용 가능하며, 주로 Apache Solr와 Apache Spark 활용

- AI-기반 검색은 콘텐츠와 사용자 신호라는 두 가지 연료로 작동

- Reflected Intelligence를 통해 지속적으로 신호 수집, 결과 조정 및 개선 측정을 수행하여 학습 및 향상

p35

- 자연어 처리의 복잡성

- 지능형 검색 구현을 위해 자연어의 복잡성과 뉘앙스를 다루어야

- 키워드, 엔티티, 개념, 오타, 동의어, 약어, 모호한 용어, 개념 간 명시적 및 암묵적 관계, 분류 체계 내 계층적 관계, 온톨로지 내 상위 관계, 지식 그래프 내 엔티티 관계의 구체적 인스턴스를 처리해야

- 핵심

- AI 기반 검색 엔진은 심층 학습 모델의 복잡성을 해결하기 위해 Explainable AI와 같은 기술이 필요

- 도메인 지식과 실시간 쿼리 처리가 필요하며, Spark와 같은 도구를 통해 지속적으로 학습하고 개선해야

- 자연어의 복잡성을 이해하고 다루면서 검색 관련성을 최적화하는 것이 필요

-

추가 자료 및 예시

- 패션 상품 검색 예시: 이미지와 상품 메타 정보를 활용한 검색 방식으로, 사용자는 특정 스타일이나 브랜드의 이미지를 업로드하고, 검색 엔진은 해당 이미지를 바탕으로 유사한 패션 아이템을 추천 이미지 인풋은 딥러닝 기반의 이미지 분석 모델을 사용하여 주요 피쳐을 추출하고, 메타 정보와 결합하여 유사 아이템을 검색 검색 결과는 유사도 점수에 따라 랭크되어 사용자에게 제공됨.

p36

- 자연어 이해 및 검색 문제 해결을 위한 철학적 기초 구축

- 철학적 기초는 AI 기반 검색 시스템에서 모든 구성 요소가 통합되고 일관되게 작동하도록

- 자연어 이해 문제를 해결하고 검색 애플리케이션을 더 지능적으로 만들기 위한 솔루션 적용.

- 자유 텍스트 및 비정형 데이터 소스의 본질에 대한 일반적인 오해 논의.

- 비정형 데이터의 정의 및 오해

- 비정형 데이터는 사전 정의된 스키마에 맞지 않는 텍스트 데이터로 설명됨.

- “비정형”이라는 용어는 텍스트의 의미를 충분히 설명하지 못 텍스트는 문법적 규칙 등을 통해 구조화됨.

- 예시: 라디오에서 재생되는 노래도 고유한 특성을 가지지만 일반적인 속성을 따르며 의미 전달 가능.

- 예시 이미지 및 설명

- Figure 2.1: 일반적인 검색 엔진에서 발견할 수 있는 비정형 데이터 텍스트 예시.

p37

- 비정형 데이터의 다른 유형

- 텍스트 외에도 이미지, 오디오, 비디오 등이 비정형 데이터의 특성을 공유

- Figure 2.2: 텍스트 외 다양한 비정형 데이터 유형 예시(오디오, 이미지, 비디오 포함).

- 오디오 및 이미지의 특성

- 오디오는 감정, 목소리 톤 등의 뉴앙스를 효과적으로 인코딩할 수 있음.

- 이미지는 색상의 그리드를 통해 아이디어를 표현하며, 비디오 역시 여러 이미지와 오디오의 조합임.

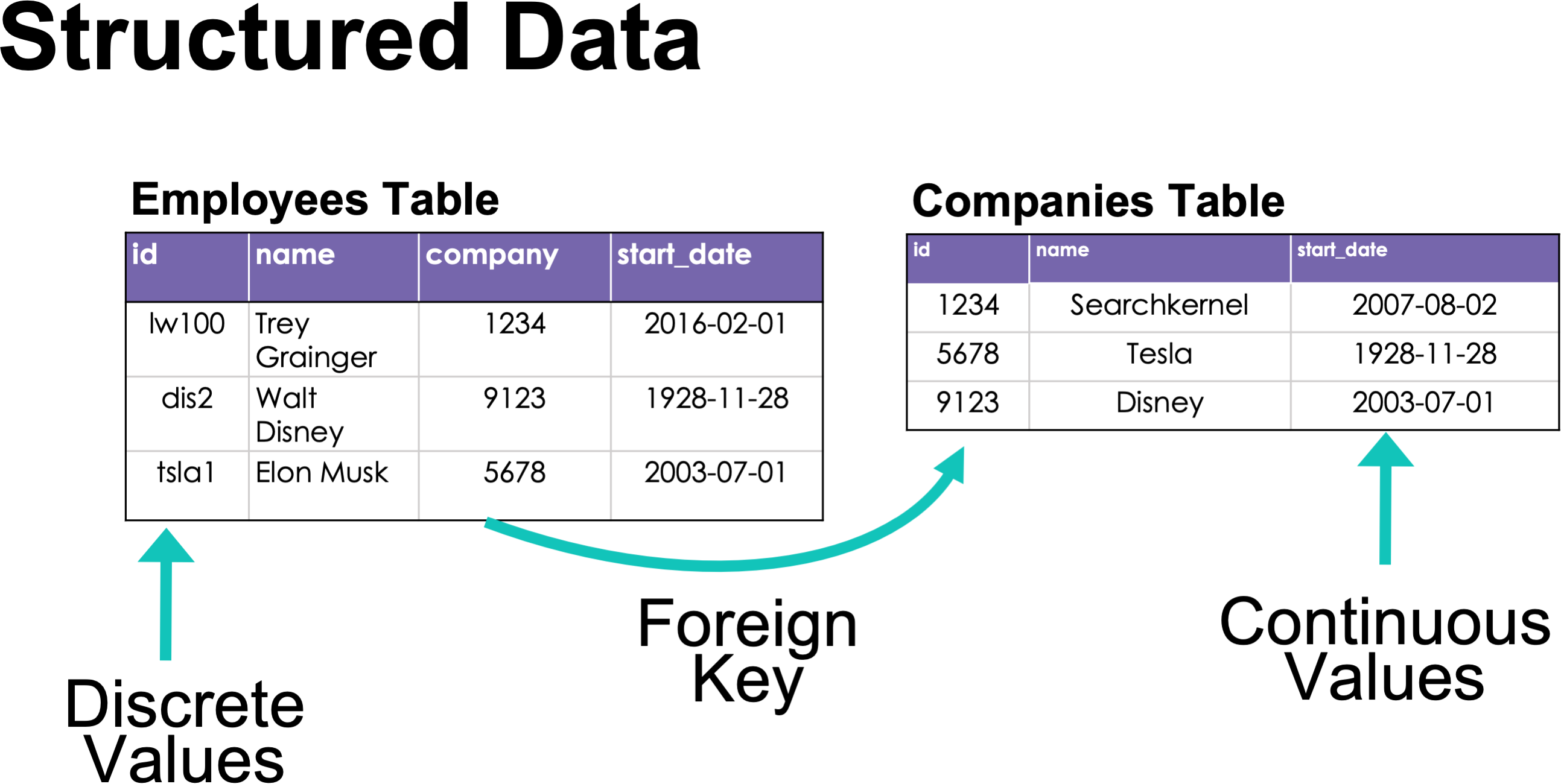

p38

- 반정형 데이터: 비정형 데이터가 구조화된 데이터와 혼합된 형태

- 로그 데이터는 이벤트 날짜, 유형, 설명이 포함된 반정형 데이터의 예시.

- 비정형 데이터와 구조화된 데이터 비교

- SQL 데이터베이스의 레코드는 컬럼으로 분할되며, 이 중 일부는 이산적(discrete) 값과 연속적(continuous) 값을 가짐.

- 이산적 값은 열거형 목록에서 유래된 값이며, 연속적 값은 범위 내의 값을 나타냄.

p39

- 구조화된 데이터에서의 관계 및 조인(join)

- 외부 키(foreign key)를 사용하여 서로 다른 테이블의 레코드를 연결

- Figure 2.3: 데이터베이스에서 이산적, 연속적 값 및 외부 키를 사용하는 예

- 비정형 데이터에서도 유사한 조인 기법 적용 가능

- 비정형 데이터에는 명시적으로 모델링된 테이블만큼 명확한 구조가 없지만, 유연한 구조 내에 많은 정보가 포함됨

- 비정형 데이터에서 외부 키와 유사한 개념을 사용하여 문서 간 관계를 찾고 조인 가능

TL;DR

- 비정형 데이터는 텍스트의 의미를 충분히 설명하지 못하며, 구조화된 데이터와 유사한 규칙과 구조를 따름

- 다양한 비정형 데이터 유형은 텍스트뿐 아니라 이미지, 오디오, 비디오를 포함하여 검색 엔진에서 처리됨

- 구조화된 데이터와 비정형 데이터 간의 유사한 조인 기법을 통해 관계 발견 가능

- 패션 상품 검색 예시

- 이미지와 상품 메타 정보를 기반으로 패션 상품 검색 시, 이미지의 색상 및 패턴을 텍스트와 연결하여 유사한 제품 추천 가능

- 머신러닝 모델을 활용하여 이미지의 주요 피쳐을 추출하고, 텍스트 메타데이터와 함께 검색 엔진에 통합하여 검색 정확도 향상

이와 같이, 비정형 데이터는 본래 구조가 없다고 여겨지지만 실제로는 다양한 규칙과 구조를 포함하고 있으며, 이를 통해 검색 및 데이터 처리에 적용할 수 있는 다양한 방법이 존재

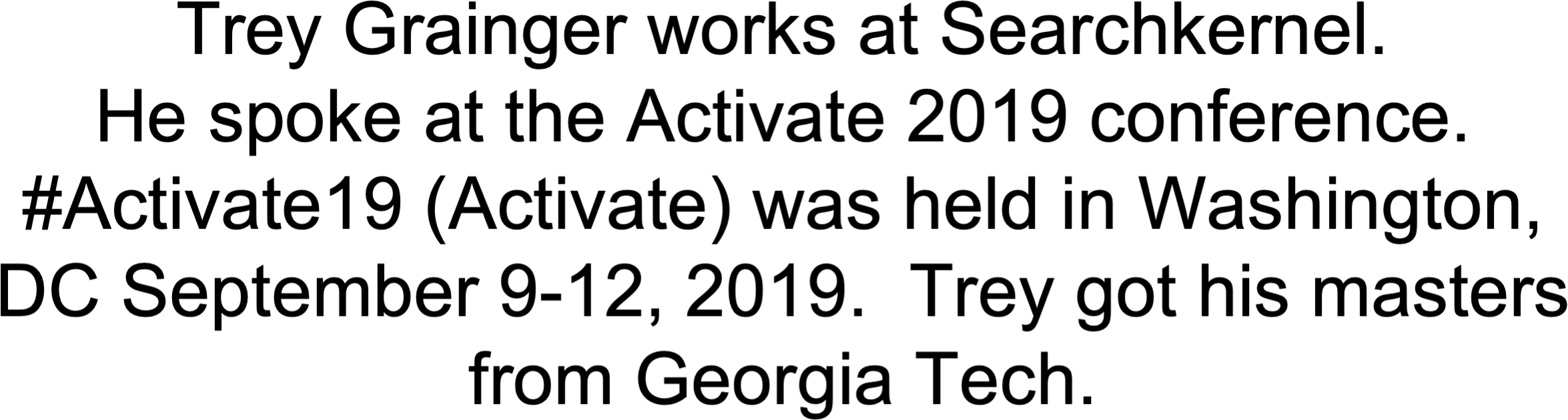

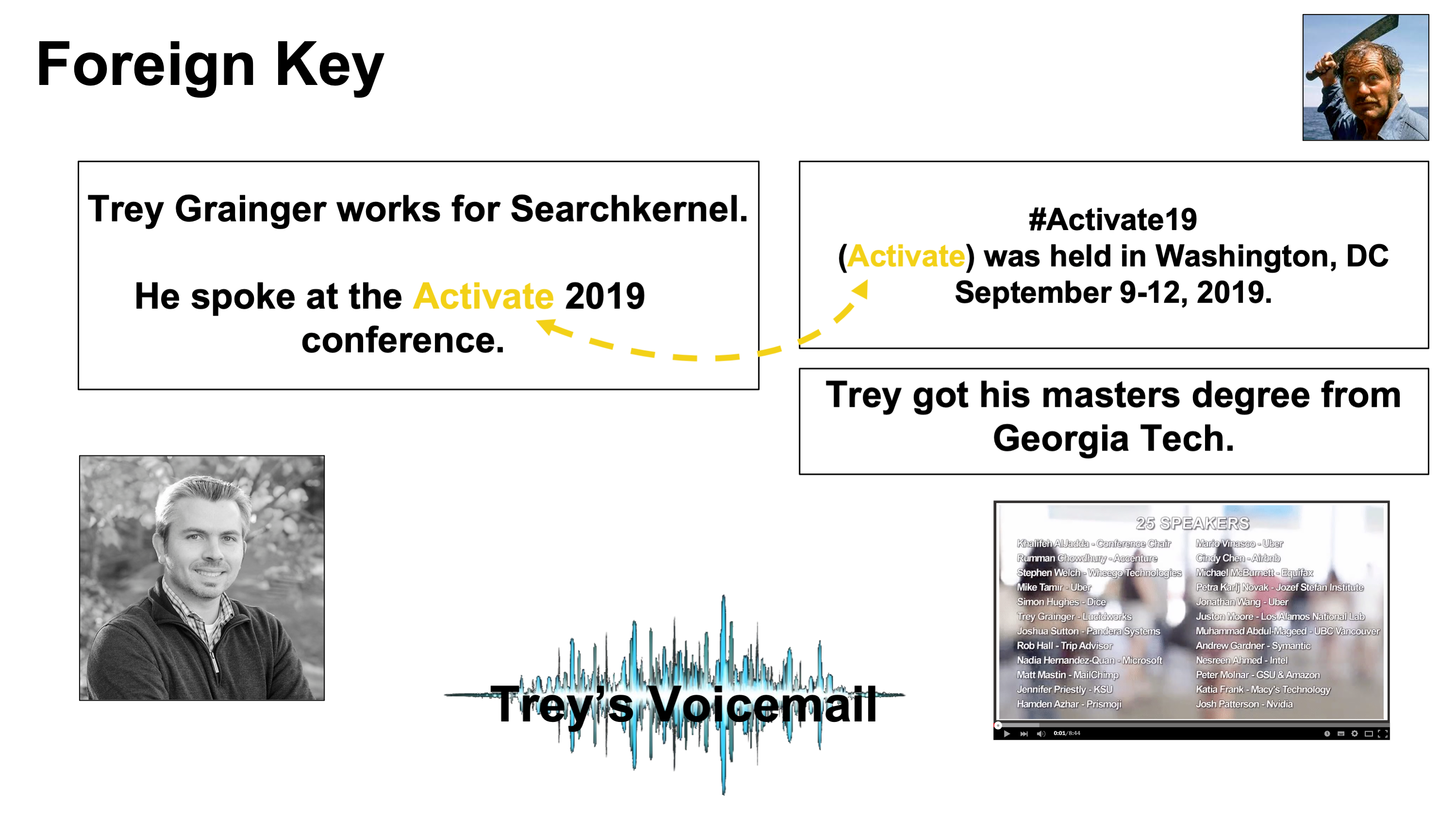

Unstructured Data and Fuzzy Foreign Keys

p40

Unstructured Data in Search Engines

- 개념 설명

- “Activate”라는 용어는 기술 컨퍼런스를 가리킴.

- 동일한 단어가 두 개의 다른 텍스트 섹션에서 사용됨.

- 각 정보 조각(텍스트 블록, 이미지, 비디오, 오디오 클립)은 검색 엔진의 별도 문서로 표현됨.

- 데이터베이스의 두 행이 같은 “Activate” 값을 포함하는 것과 유사하게, 두 문서가 “Activate”라는 외래 키로 연결됨.

- 이미지 설명

- Figure 2.4: 비구조적 데이터에서의 외래 키. 두 관련 텍스트 문서를 연결하는 동일한 용어 사용 예

- 비구조적 데이터의 Pros(+)

- 전통적 구조 데이터 모델링보다 강력

- 예시: 두 문서가 “Trey Grainger”와 “Trey”라는 이름으로 연결

TL;DR

- 동일한 용어가 여러 문서에서 사용되며, 이는 비구조적 데이터의 외래 키로 작용

- 비구조적 데이터는 전통적 데이터베이스보다 더 유연

- 데이터는 강력한 문맥적 관계를 통해 연결될 수 있음.

p41

Fuzzy Foreign Keys

- 개념 설명

- 두 문서가 서로 다른 용어로 동일한 엔티티를 참조하지만 동일한 의미로 해석됨.

- “Fuzzy Foreign Key” 개념 도입: 동일한 엔티티로 해결하기 위해 자연어 처리(NLP) 및 엔티티 해결 기술 필요

- 이미지 설명

- Figure 2.5: 다른 용어 시퀀스를 사용하여 동일한 엔티티를 참조하는 예시.

- 엔티티 해결

- “Trey”와 “Trey Grainger”가 동일 엔티티를 나타냄.

- “he”와 “his”도 동일 엔티티로 해석 가능

TL;DR

- Fuzzy Foreign Key는 유연한 엔티티 결합을 가능하게

- 자연어 처리 기술이 필요

- 동일한 엔티티를 여러 방식으로 해석하여 문서 간 결합 가능.

p42

Fuzzier Foreign Keys

- 개념 설명

- 고유명사, 대명사, 이미지, 비디오 참조가 동일 엔티티로 해결됨.

- 비구조적 정보의 숨겨진 구조를 활용하여 문서 결합 및 엔티티 학습

- 이미지 설명

- Figure 2.6: 다양한 참조를 동일 엔티티로 해결 예

- 문제점 및 해결

- 다의어(polysemy) 문제: 동일 철자 단어가 여러 의미 가질 수 있으며,

- AI 기반 검색 엔진은 문맥을 활용하여 이런 차이를 구별해야 함.

TL;DR

- 이미지와 비디오 참조도 동일 엔티티로 해결 가능

- 다의어 문제는 검색 응용에서 큰 문제로 작용

- 문맥 기반의 차이 구별이 필요

p43

Dealing with Ambiguous Terms

- 개념 설명

- “Trey Grainger” 검색 시 다양한 이미지 결과 반환

- 검색어의 다의성 문제 강조: 동일 철자지만 다른 의미 가질 수 있음

- AI 기반 검색 엔진은 문맥을 활용하여 의미 구별 필요

- 이미지 설명

Figure 2.7: “Trey Grainger” 검색 결과 이미지.

Figure 2.7: “Trey Grainger” 검색 결과 이미지.

- 유의점

- 검색 시 다의어 문제 인식 필요

- AI 엔진은 문맥 이해 및 차이 구별을 통해 정확한 정보 제공해야 함.

TL;DR

- 다의어 문제는 검색 정확도에 큰 영향을 미치며,

- AI는 문맥을 통해 의미 구별을 수행해야 함

- 비구조적 데이터는 많은 관계를 포함한 그래프로 이해 가능

관계 그래프와 자연어의 구조

1. Giant Graph of Relationships

1.1 관계 그래프의 이해

Figure 2.8: 관계의 대규모 그래프

- 관계 그래프는 문서 간의 연결성에서 파생됨

- 이름, 날짜, 사건, 장소, 인물, 기업 등 다양한 엔티티 존재

- 문서 간 엔티티의 조인을 통해 관계 인퍼런스 가능

- 이미지의 올바른 비모호화 수행 → “마체테 남자”가 그래프에서 분리됨

1.2 대규모 문서에서의 학습

- 소수의 문서에서 이런 정보를 학습 가능 → 수천, 수백만, 수십억 문서에서 학습할 수 있는 가능성

- AI 기반 검색 플랫폼의 일부로 데이터에서 통찰력 학습 수행

- 이런 방대한 관계 그래프를 활용하여 지능 구현 필요

- 역방향 인덱스의 구조 활용 → 추가적인 데이터 모델링 없이 그래프 탐색 용이

- 5장에서 데이터에 숨겨진 의미적 지식 그래프 활용 방법 심층 탐구 예정

TL;DR

- 문서 간의 엔티티 연결을 통해 대규모 관계 그래프 형성.

- AI 기반 검색 플랫폼에서 이런 그래프를 활용하여 지능적 통찰력 학습.

- 역방향 인덱스를 통해 추가적 모델링 없이 그래프 탐색 가능.

2. 자연어의 구조

2.1 자연어의 계층적 구조

Figure 2.9: 자연어의 의미적 데이터 인코딩

- 문자 → 문자 시퀀스 → 용어 → 용어 시퀀스 → 필드 → 문서 → 코퍼스의 계층적 구조

- 문자: 개별 문자, 숫자, 기호

- 문자 시퀀스: “e”, “en”, “eng”, “engineer” 등

- 용어: “engineer”, “engineering” 등의 단어

- 용어 시퀀스: “software engineer”, “senior software engineer” 등

2.2 용어 시퀀스와 구의 차이

- 구(Phrase) 모든 용어가 순차적으로 나타나는 용어 시퀀스

- 예: “chief executive officer”는 구이면서 용어 시퀀스

- “chief officer”~2은 비순차적 용어 시퀀스에 해당

2.3 텍스트 분석의 중요성

- 텍스트 필드는 텍스트 분석기를 통해 다양한 방식으로 분석 가능

- 공백 및 구두점 분할, 소문자화, 노이즈 제거, 스테밍 또는 표제화, 악센트 제거 등 포함

- Solr in Action 6장에서 텍스트 분석 과정 상세 참조 가능

TL;DR

- 자연어는 문자부터 코퍼스까지의 계층적 구조로 구성.

- 용어 시퀀스는 순차적 용어의 조합이며, 구는 그 특별한 형태.

- 텍스트 분석을 통해 문서의 의미를 더 명확히 이해 가능.

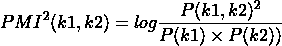

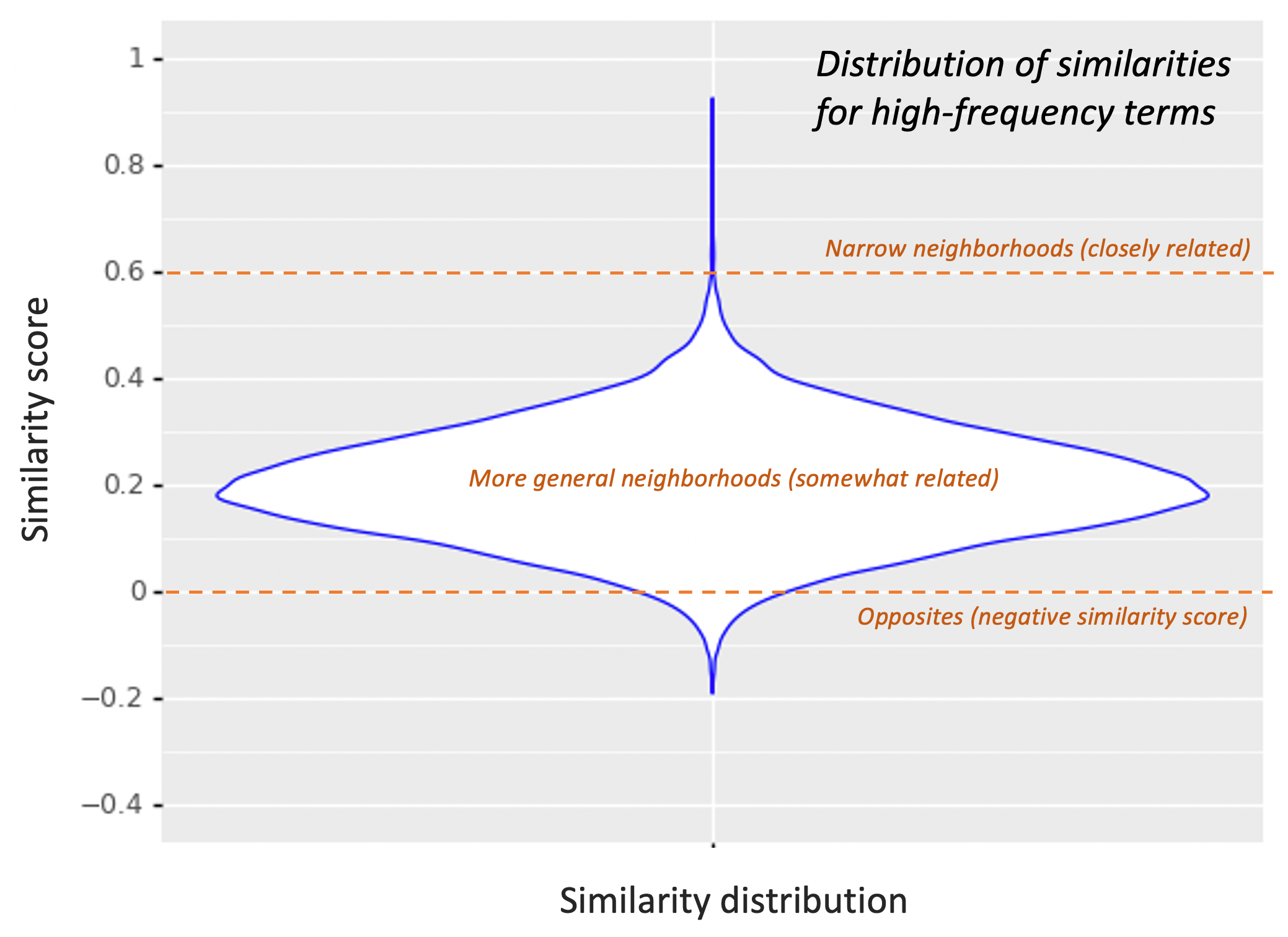

3. 분포 의미론과 단어 임베딩

3.1 분포 의미론의 개념

- 분포 가설: 비슷한 맥락에서 등장하는 단어는 유사한 의미 공유

- 대표적 인용: “You shall know a word by the company it keeps.” - John Rupert Firth

3.2 검색 엔진에서의 활용

- 검색 엔진은 분포 의미론을 활용하여 문서의 맥락 파악 용이

- 예시 쿼리: “C-level executives”를 찾기 위한 문자 시퀀스 쿼리

c?o: “CEO”, “CMO”, “CFO” 등 매칭"VP Engineering"~2: “VP Engineering”, “VP of Engineering” 등 매칭

- 역방향 인덱스는 복잡한 boolean 쿼리 지원

- 예:

(Microsoft OR MS) AND Word

- 예:

TL;DR

- 분포 의미론: 비슷한 맥락의 단어는 유사한 의미를 가짐.

- 검색 엔진에서 분포 의미론 활용하여 문서의 맥락 이해 가능.

- 역방향 인덱스를 통한 복잡한 쿼리 지원으로 다양한 검색 가능.

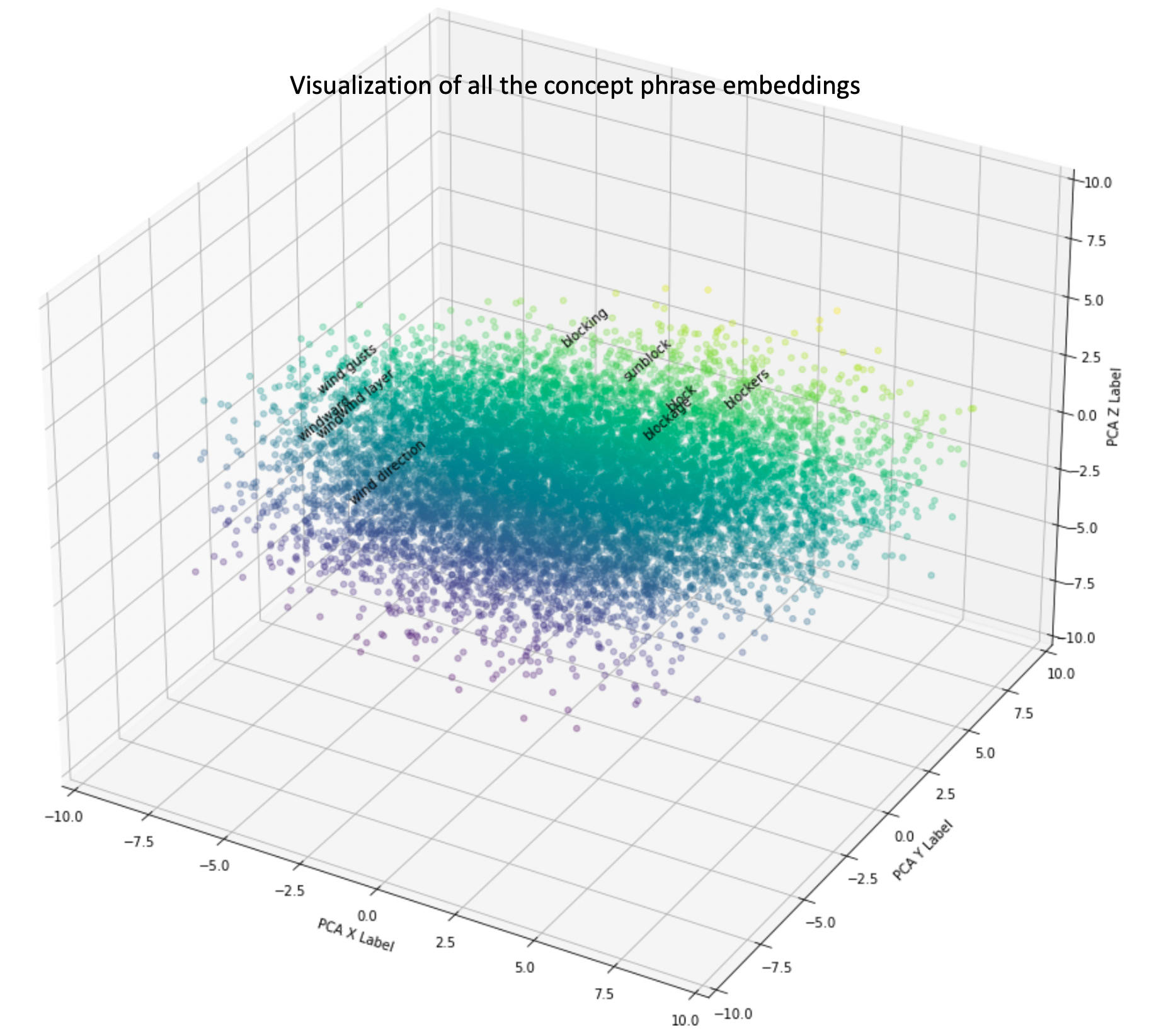

벡터의 소개

p48

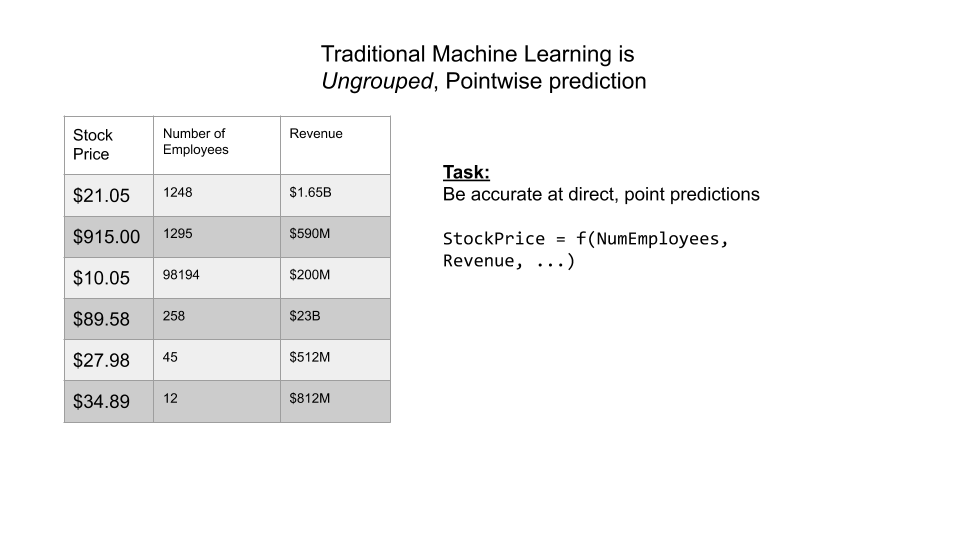

- 벡터의 개념

- 벡터: 항목의 속성을 설명하는 값의 목록

- 예: 집의 속성 → 가격, 크기, 침실 수

- 벡터 표현: 예를 들어, $100,000의 가격, 1000 평방 피트, 2개의 침실로 구성된 집은 \([100000, 1000, 2]\)로 표현됨

- 속성: 벡터의 각 요소는 ‘차원’으로 불림

- 벡터 공간: 특정 차원 집합으로 구성된 공간

- 다른 항목(e.g., 아파트, 주택 등)도 동일한 벡터 공간 내에서 표현 가능

- 예: \([1000000, 9850, 12]\) 및 \([120000, 1400, 3]\)과 같은 벡터는 동일한 벡터 공간 내에서 비교 가능

- 벡터 연산: 수학적 연산을 통해 트렌드 학습 및 벡터 비교 가능

- 예: “침실 수가 증가함에 따라 집의 가격이 증가하는 경향” 확인 가능

- 유사성 계산: 예를 들어, \([120000, 1400, 3]\) 집이 \([100000, 1000, 2]\) 집과 더 유사하다고 판단 가능

- 벡터: 항목의 속성을 설명하는 값의 목록

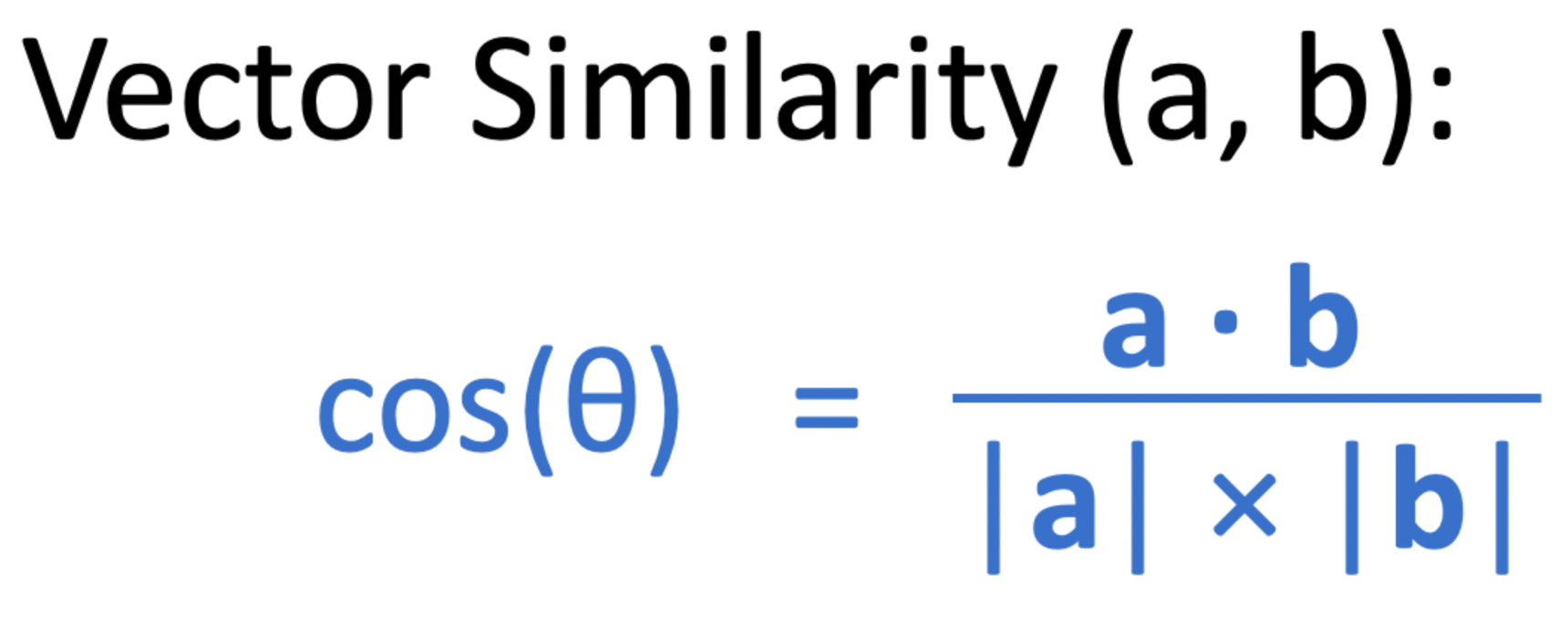

- 단어 임베딩의 활용

- 분포 가설: 용어 및 용어 시퀀스의 의미 이해를 위한 방법

- 단어 임베딩: 주어진 용어 시퀀스의 의미를 나타내는 수치 벡터

- 예: 단어 또는 구문이 축소된 차원 벡터로 인코딩됨

- 해당 벡터를 활용하여 의미적으로 가장 관련 있는 문서 탐색 가능

TL;DR

- 벡터는 항목의 속성을 설명하는 값의 목록으로, 다양한 항목을 동일한 벡터 공간 내에서 표현 가능

- 단어 임베딩은 용어의 의미를 수치 벡터로 표현하여 의미적으로 관련 있는 문서를 찾는 데 사용됨.

- 유사성 계산을 통해 벡터 간의 관계를 평가하고, 관련 항목을 효과적으로 탐색 가능

p49

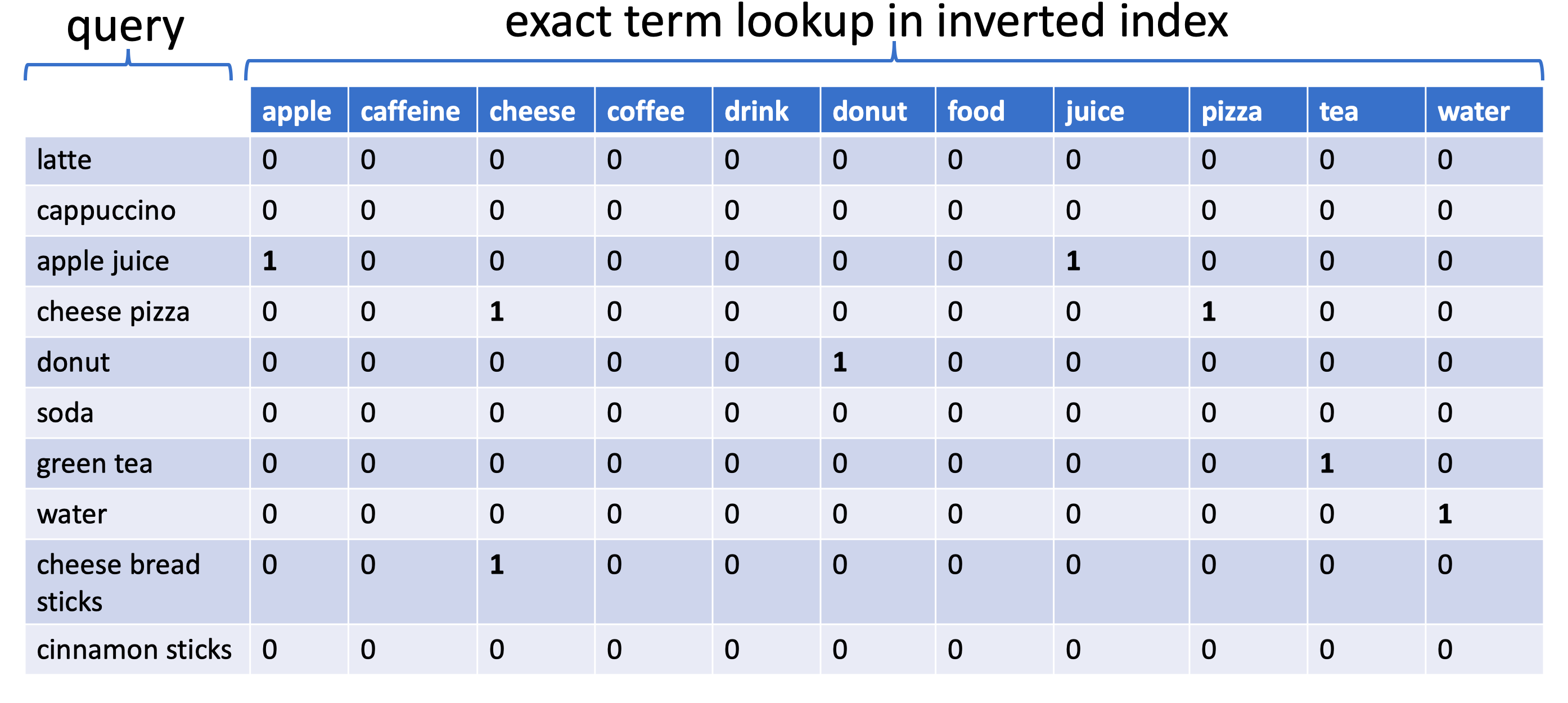

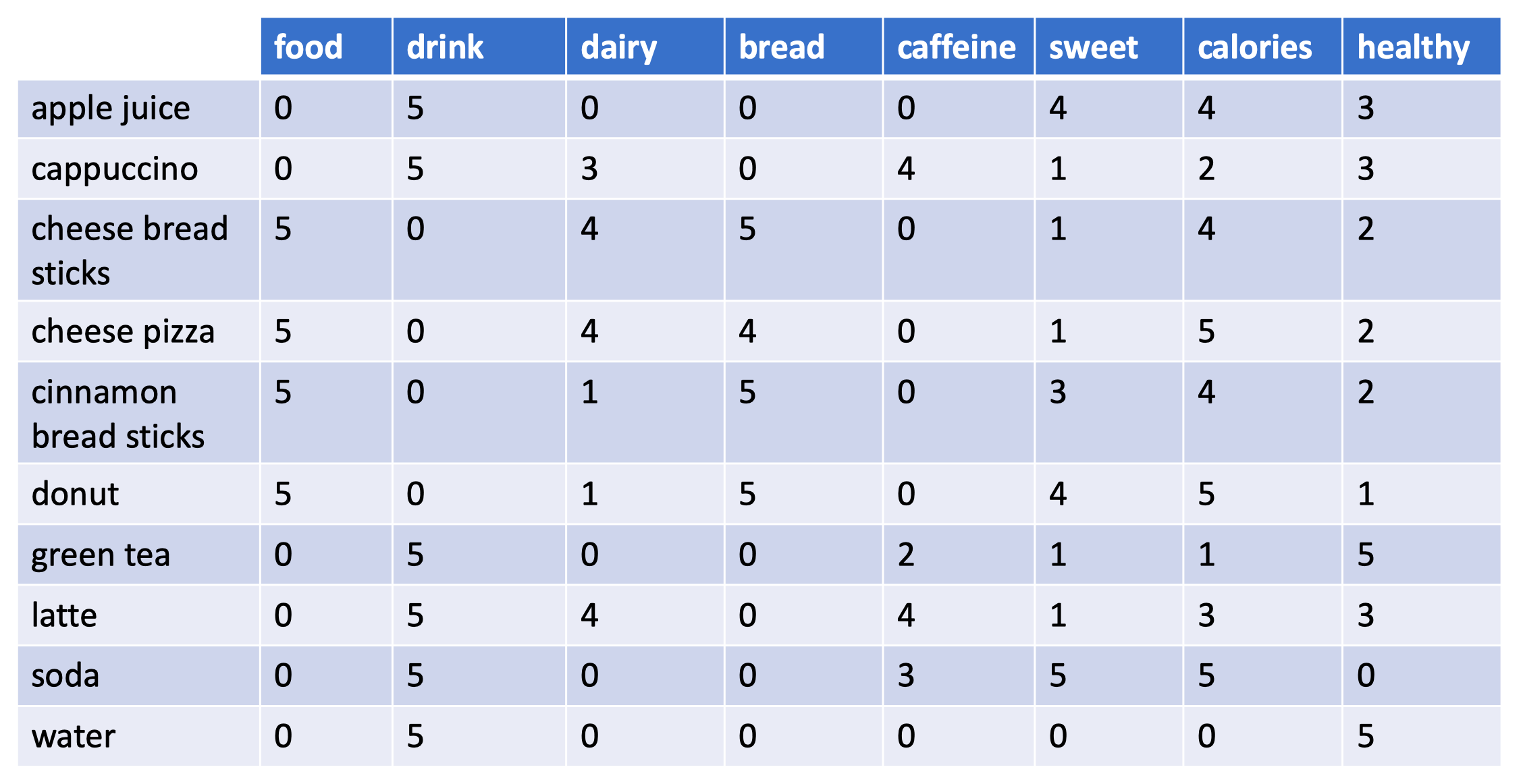

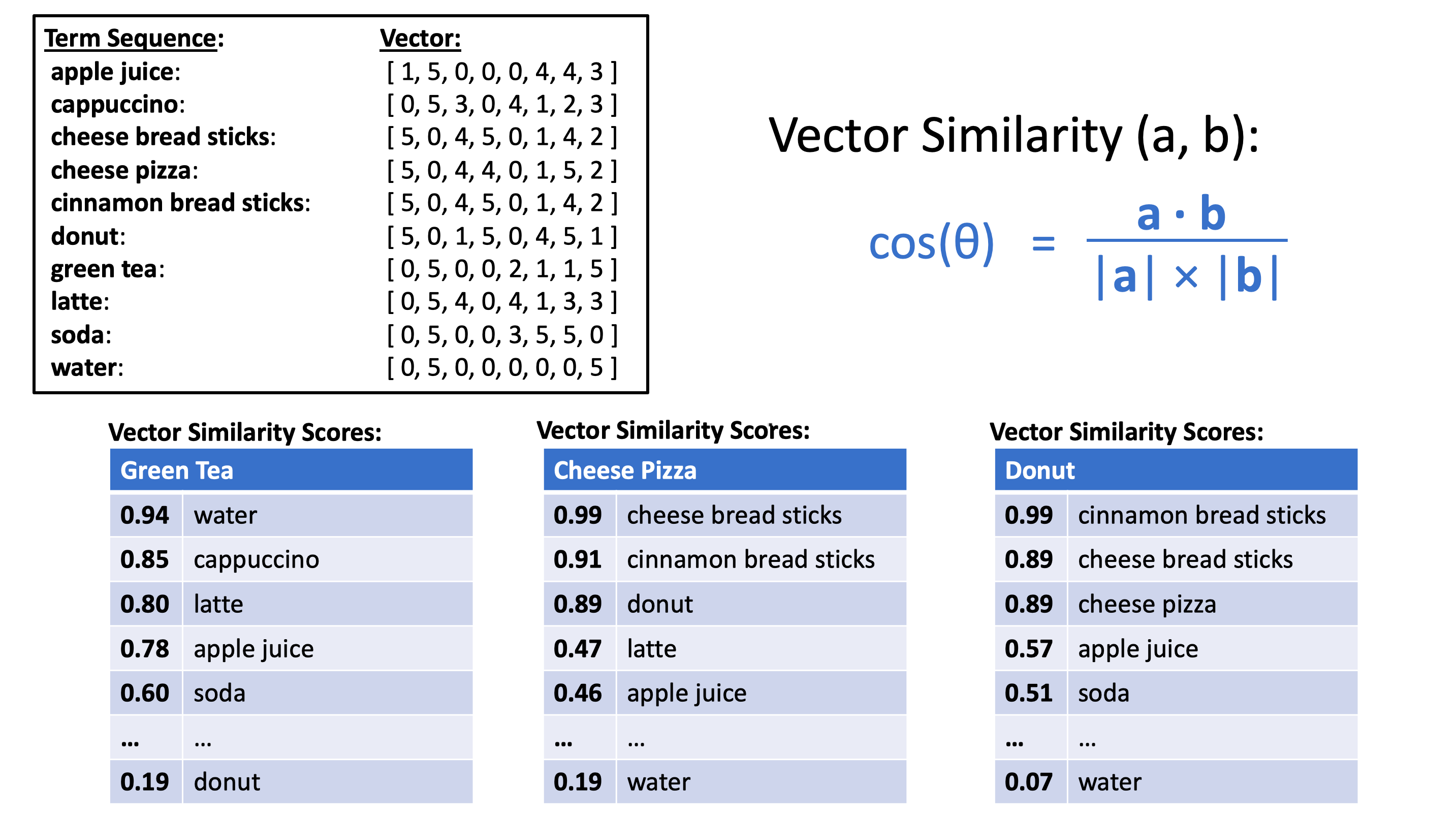

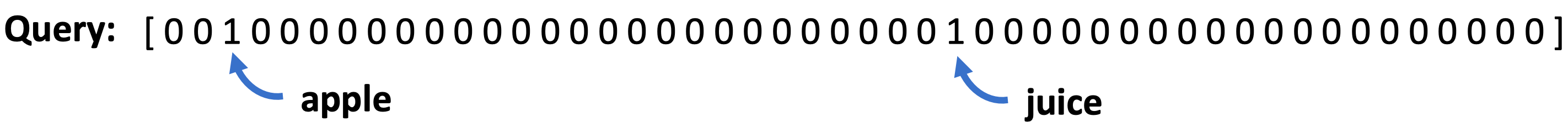

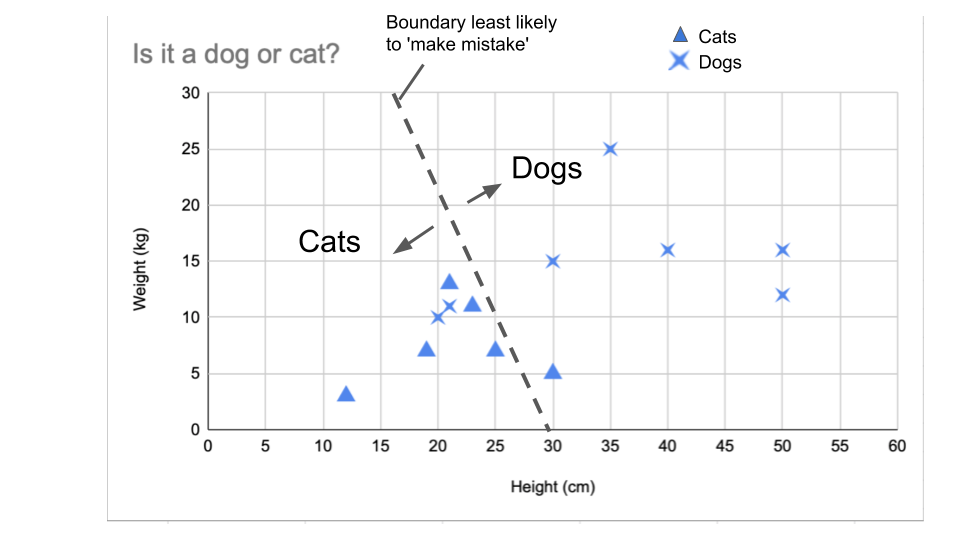

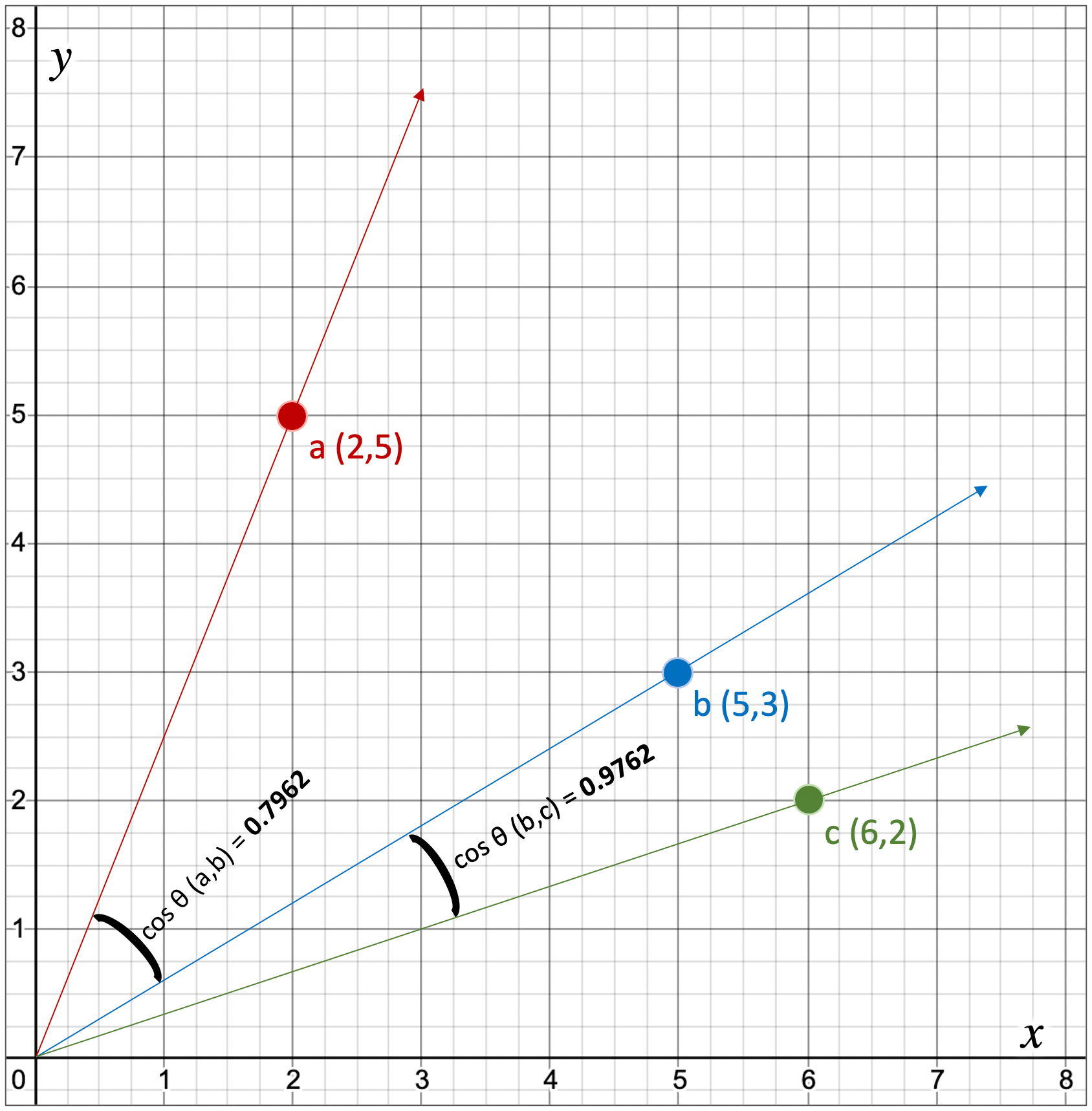

- 벡터 매핑 및 유사성 평가

- 검색 엔진의 기본 동작 방식: 쿼리가 인덱스 내 각 용어에 대한 벡터로 매핑됨

- 쿼리 내 존재하는 용어의 차원 값은 “1”, 존재하지 않는 경우 “0”

- 문서 유사성 계산: 쿼리 벡터와 문서 벡터 간의 유사성 점수를 계산하여 관련 문서 식별

- 한계: 정확한 키워드 일치에는 적합하나, 관련 항목 탐색에는 한계 존재

- 예: “soda”는 쿼리에 있지만 인덱스에 없으면 0 결과 반환

- “caffeine” 존재하더라도 “latte”, “cappuccino”와 연관성 평가 불가

- 검색 엔진의 기본 동작 방식: 쿼리가 인덱스 내 각 용어에 대한 벡터로 매핑됨

p50

- 차원 축소 및 단어 임베딩

- 차원 축소: 용어가 고차원 벡터로 매핑됨

- 예: “healthy”, “caffeine”, “food”와 같은 속성 평가

- 유사성 계산: 코사인 유사도 또는 거리 측정을 통해 벡터 간의 관계 평가

- 점곱 및 벡터 크기로 스케일링하여 유사성 계산

- 차원 축소: 용어가 고차원 벡터로 매핑됨

p51

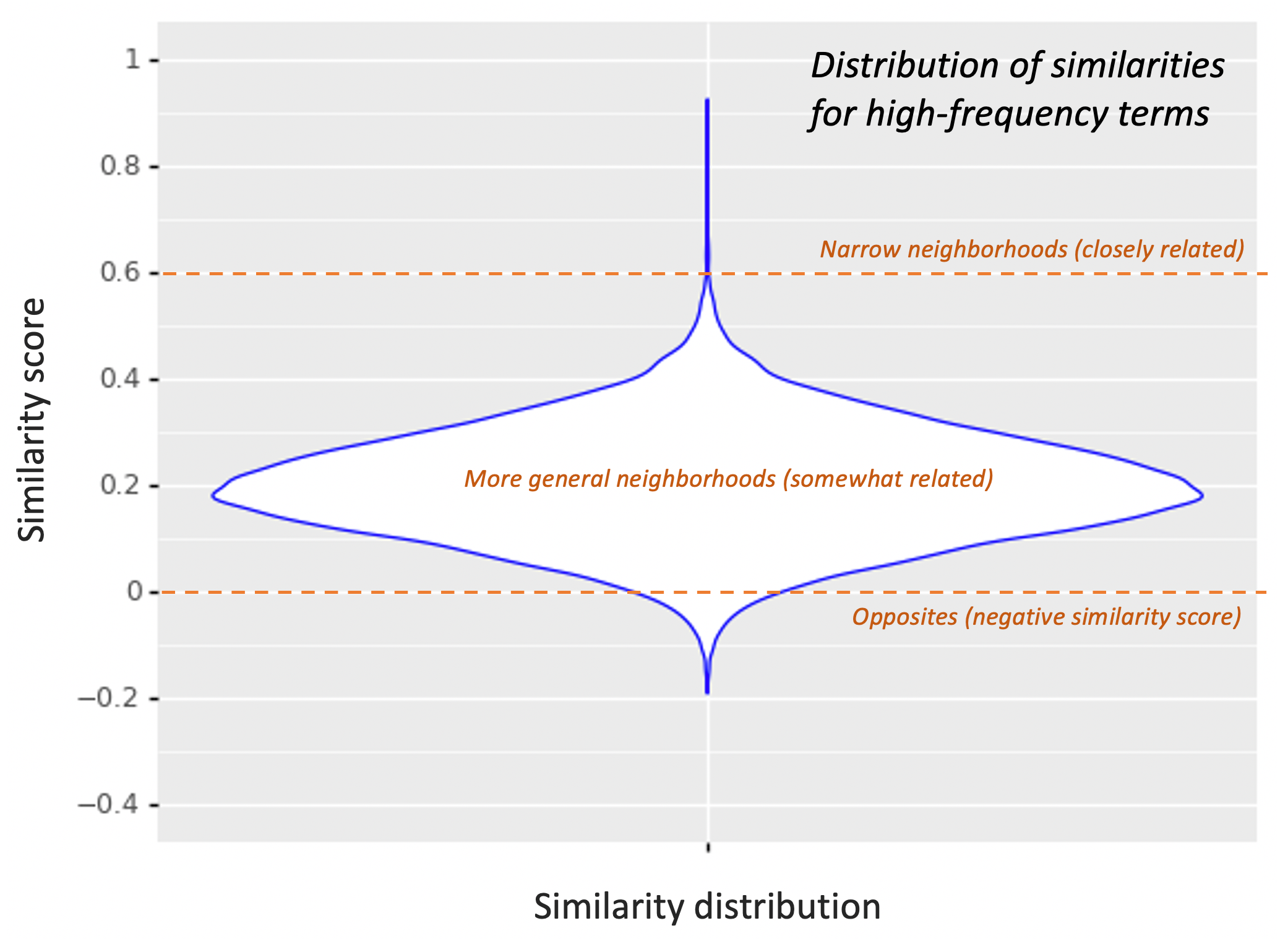

- 유사성 평가 예시

- 예: “green tea”와 다른 용어 시퀀스 간의 유사성 평가

- “water”, “cappuccino”, “latte”, “apple juice”, “soda”가 가장 관련 있음

- “donut”는 가장 관련 없다고 평가됨

- 검색 엔진 내 벡터 스코어링: 두 단계 프로세스

- 첫 번째 단계: 키워드 검색

- 두 번째 단계: 결과 문서 스코어링

- 벡터 기반 검색 구현에 대한 추가 논의는 13장에서 다룰 예정

- 예: “green tea”와 다른 용어 시퀀스 간의 유사성 평가

TL;DR

- 쿼리와 문서 간의 유사성은 벡터 스코어링으로 평가되며, 정확한 키워드 일치에는 한계가 있음.

- 차원 축소된 단어 임베딩을 통해 의미적으로 관련 있는 항목을 효과적으로 탐색 가능.

- 벡터 스코어링은 검색 엔진에서 관련 문서를 식별하는 데 중요한 역할을 수행

관련 문서 및 예시

- 패션 상품 검색 예시:

- 이미지 및 상품 메타 정보를 기반으로 유사성 평가

- 이미지 벡터와 메타 정보 벡터의 유사성을 통해 관련 상품 탐색

위 내용을 바탕으로 벡터 및 단어 임베딩의 중요성과 활용 방법에 대해 이해할 수 있음. 더욱 심도 있는 내용은 이후 장에서 다룰 예정임.

도메인 특화 지식 모델링

속성 벡터와 임베딩

- 속성 벡터의 역할 쿼리 내 다른 용어 시퀀스를 나타내거나, 문서 내 용어 시퀀스를 나타내거나, 전체 문서를 나타내는 데 사용됨.

- 용어 및 용어 시퀀스는 워드 임베딩으로 인코딩됨

- 문장 임베딩 전체 문장 인코딩

- 단락 임베딩 전체 단락 인코딩

- 문서 임베딩 전체 문서 인코딩

- 추상적 차원 딥러닝 모델이 문서 내 문자 시퀀스와 클러스터링에서 불명확한 특성을 추출

- 차원을 쉽게 레이블링할 수 없으나, 모델의 예측력을 향상시킨다면 큰 문제는 아님

- 결론 분산 의미론과 워드 임베딩의 힘을 결합한 여러 모델을 사용하는 것이 최선의 결과를 만듦.

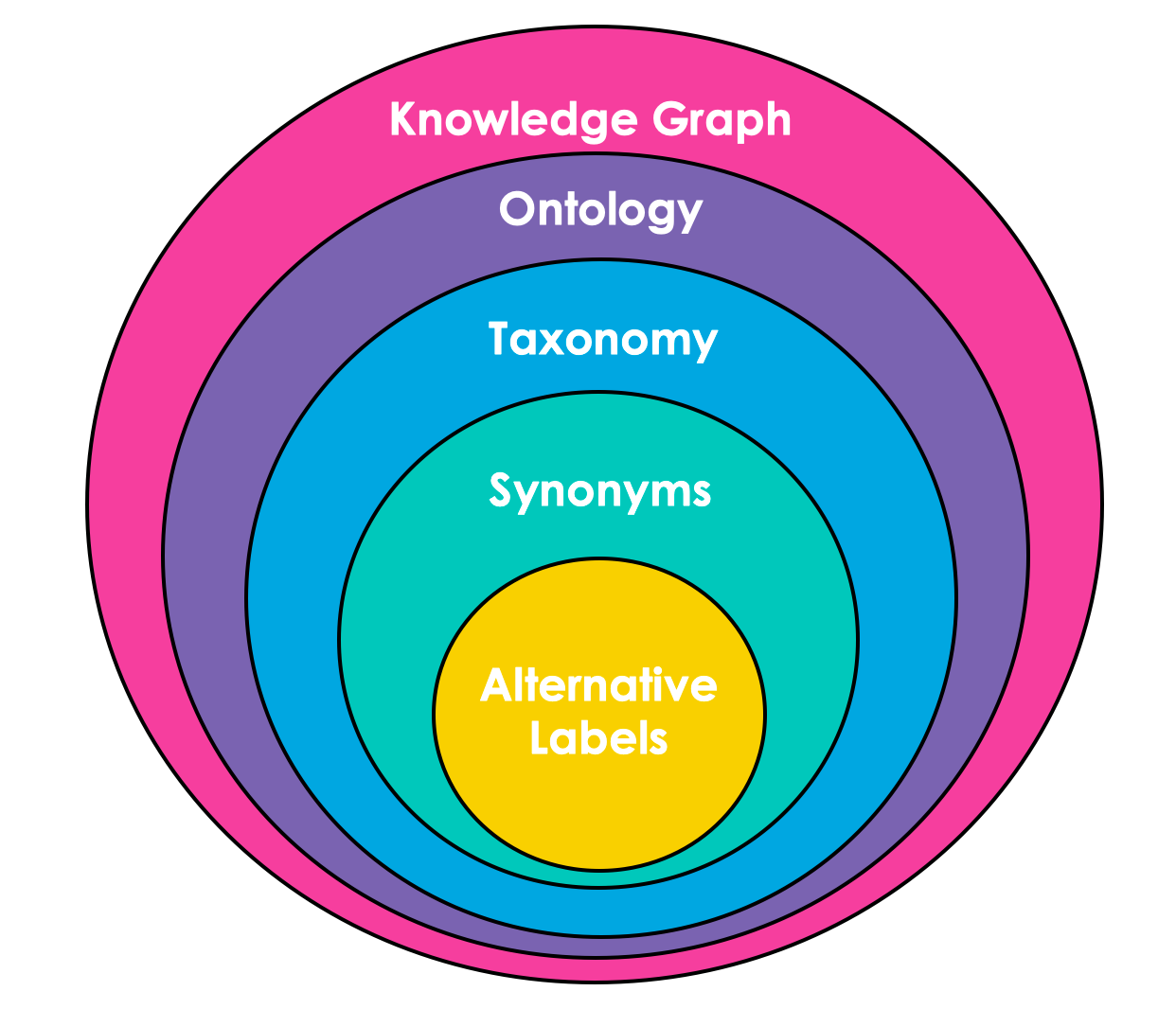

지식 모델링 기법

- 대체 레이블(Alternative Labels) 동일한 의미를 가진 용어 시퀀스.

- 예: CTO => Chief Technology Officer

- 동의어(Synonyms) 같은 의미 또는 유사한 의미를 나타낼 수 있는 용어 시퀀스.

- 예: human => homo sapiens, mankind

- 분류학(Taxonomy) 사물을 카테고리로 분류.

- 예: human is mammal

- 온톨로지(Ontology) 사물 간 관계의 매핑.

- 지식 그래프(Knowledge Graph) 온톨로지의 구현체로, 관련된 사물도 포함

지식 모델링의 정의와 적용

- 대체 레이블 약어나 철자 오류 등을 포함한 용어 교체.

- 동의어 검색 엔진에서 자주 사용, 용어 확장의 역할.

- 분류학 콘텐츠를 계층 구조로 분류, 웹사이트 네비게이션에 사용됨.

- 온톨로지 도메인 내 사물 간 추상적 관계 정의.

- 지식 그래프 온톨로지를 기반으로 구체적인 엔티티와 관계 포

TL;DR

- 속성 벡터는 문서의 단어 시퀀스를 표현하며, 딥러닝으로 추상적 특성을 추출

- 대체 레이블, 동의어, 분류학, 온톨로지, 지식 그래프 등의 지식 모델링 기법이 존재.

- 지식 그래프는 온톨로지의 상세한 구현으로, 관계와 엔티티를 포함

자연어 이해의 챌린지

- 다의어 문제 단어의 다양한 의미로 인해 발생하는 모호성 문제.

- 예: “driver”는 차량 운전자, 골프채, 소프트웨어 드라이버 등 여러 의미로 사용됨.

지식 모델링과 자연어 이해는 검색 시스템의 정확성을 높이는 데 필수적임. 다양한 모델과 기법을 조합하여 더 나은 검색 결과를 제공할 수 있음.

위 내용은 지식 모델링과 자연어 이해의 다양한 기법과 챌린지를 논리적으로 설명하였음. 각 기법의 정의와 활용 방안을 통해 검색 시스템의 성능 향상을 도모

2.5.2 The Challenge of Understanding Context

컨텍스트 기반 의미 해석의 중요성

- 컨텍스트의 다양성

- ‘vehicle driver’라는 카테고리 내에서도 다양한 세부 의미가 존재함

- 예: 택시 기사, Uber 기사, CDL을 보유한 트럭 기사, 버스 기사 등

- 버스 기사 내에서도 학교 버스 기사, 공공 시내 버스 기사, 관광 버스 기사 등으로 세분화 가능함

- 같은 용어라도 사용되는 문맥에 따라 의미가 달라짐

- 고정된 동의어 목록을 생성하는 것만으로는 부족함

- ‘vehicle driver’라는 카테고리 내에서도 다양한 세부 의미가 존재함

- 문맥에 의존한 의미 클러스터

- 모든 단어와 구문은 “문맥에 의존하는 의미의 클러스터”임

- 즉, 특정 문맥에 따라 다양하게 해석될 수 있음

- 고정된 동의어 목록은 비효율적임

- 모든 단어와 구문은 “문맥에 의존하는 의미의 클러스터”임

- 검색어의 문맥 해석 필요성

- 사용자가 입력하는 구문에 대한 정확하고 미세한 해석 필요

- 다양한 문맥에서의 의미를 학습하기 위한 방법 필요

2.5.3 The Challenge of Personalization

- 개인화의 복잡성

- 사용자의 브랜드 선호도가 검색 결과에 영향을 미침

- 예: Apple 제품을 자주 검색하는 사용자가 다른 카테고리에서도 Apple 제품을 선호한다고 가정할 수 없음

- 개인화는 사용자 의도를 잘못 해석할 가능성이 높음

- 사용자 의도와 브랜드 선호도의 균형 잡기

- 사용자의 브랜드 선호도가 검색 결과에 영향을 미침

- 개인화의 어려움

- 개인화는 AI 기반 검색 애플리케이션에서 가장 어려운 부분 중 하나임

- 추천 엔진을 제외하고는 잘 구현되지 않음

2.5.4 Challenges Interpreting Queries vs. Documents

- 문서와 검색어의 차이

- 문서는 긴 텍스트 블록으로 더 많은 문맥 제공

- 검색어는 짧고 다중 아이디어를 포함하는 경우가 많음

- 검색어 해석을 위한 외부 문맥 활용

- 자연어 처리 기법 대신 문서 코퍼스를 활용한 해석 필요

- 사용자 행동 신호를 분석하여 실제 의도 파악

2.5.5 Challenges Interpreting Query Intent

- 검색어 의도의 다양성

- 검색어는 단순한 키워드 매칭을 넘어선 고유의 의도를 가지고 있음

- 예: “who is the CEO?”는 사실 확인, “support”는 웹사이트의 지원 섹션 탐색

- 검색어의 구체성과 일반성

- 구체적인 검색어는 구매 의도 표현 가능성 높음

- 예: “verizon silver iphone 8 plus 64GB”는 특정 제품에 대한 구매 의도

2.6 The Fuel Powering AI-powered Search

- Reflected Intelligence와 피드백 루프

- 콘텐츠와 사용자 상호작용에서 지속적인 학습

- 문서와 사용자 행동 신호 모두에 적용 가능

- 문서 및 사용자 행동 신호에서 의미 파생

- 예: “machine learning”이 “data scientist”, “software engineer”와 자주 나타남

- 사용자 행동 패턴도 유사하여, 검색 로그에서 연관 용어 및 시퀀스 학습 가능

TL;DR

- 검색어는 문맥에 의존하여 다양한 의미를 가질 수 있으며, 고정된 동의어 목록으로는 한계가 있음.

- 개인화된 검색 경험을 제공하는 것은 사용자의 브랜드 선호도와 관련하여 복잡한 문제를 야기할 수 있음.

- 검색어는 짧고 문맥이 부족하므로, 외부 문맥을 활용한 해석이 필요하며, AI 기반의 검색을 통해 사용자 의도를 파악하는 것이 중요

링크 및 이미지 설명

- 이미지: AI-Powered Search의 시각적 설명 자료

- AI 기반 검색 엔진의 작동 방식과 사용자의 검색 의도를 이해하는 데 도움을 줌

패션 상품 검색 예시

- 문제 이미지 및 상품 메타 정보를 기반으로 패션 상품 검색

- 해결 딥러닝 기반 모델을 활용하여 이미지 및 메타 데이터를 분석, 유사한 패션 상품 추천

- 모델 인풋 사용자 제공 이미지, 텍스트 메타 데이터

- 모델 아웃풋 유사한 패션 상품 목록

- 적용 모델 예시 ResNet, VGGNet 등의 이미지 인식 모델

- ResNet 잔차 학습(residual learning)을 통해 깊은 신경망 학습 가능

- VGGNet 깊은 고정 크기 필터를 사용하여 이미지 피쳐 추출

이런 방식으로 AI 기반의 검색은 사용자에게 보다 개인화되고 정확한 검색 결과를 제공할 수 있음.

Content and User Signals in Search Applications

1. Introduction

-

Content and User Signals

→ 콘텐츠와 사용자 신호를 효과적으로 활용하는 것은 AI 기반 검색 애플리케이션의 성능을 크게 향상시킴 → 콘텐츠가 풍부하거나 사용자 신호가 많거나, 최적의 경우 둘 다 풍부하면 더욱 스마트한 검색 애플리케이션 구현 가능 -

Unstructured Data as Hyper-structured Data

→ 비구조적 데이터는 사실상 도메인 특정 지식을 나타내는 거대한 그래프와 같음 → 검색 엔진은 분포 의미론을 활용하여 텍스트의 의미 관계를 해석하고, 이를 통해 의미를 해석할 수 있음

2. Search Engines and Relevance

-

Search Engine Functions

→ 콘텐츠를 수집하고, 쿼리와 일치하는 콘텐츠를 반환하며, 그 콘텐츠를 쿼리와의 일치 정도에 따라 정렬함 → 일치 정도는 일반적으로 쿼리 키워드의 문서 내 일치도를 기반으로 한 점수로 측정됨 -

Controlling Relevance

→ 관련성 계산은 유연하게 구성 가능하며, 쿼리별로 조정 가능함 → 도메인별 및 사용자별 관련성 랭킹 기능을 구현할 수 있음

3. Vector Space Model and Cosine Similarity

-

Mapping Text to Vectors

→ 쿼리와 문서를 벡터로 변환하여 유사성을 측정함 → 각 단어는 벡터의 다양한 차원을 나타내며, 쿼리의 경우 관련 단어에만 1의 값을 부여하고 나머지는 0으로 설정 -

Cosine Similarity Calculation

→ 두 벡터 간의 코사인 각도를 계산하여 유사성을 측정함 → 예를 들어, “apple juice”라는 쿼리는 관련 단어의 위치에 1을 부여하는 벡터로 표현됨

4. Application: Fashion Product Search

-

Example Implementation

→ 이미지 및 메타 데이터를 기반으로 패션 상품 검색을 수행할 수 있음 → 예를 들어, 특정 패션 아이템의 이미지가 주어지면, 유사한 아이템을 찾기 위해 해당 이미지의 피쳐을 벡터로 변환하여 검색함 -

Utilized Models

→ Convolutional Neural Networks (CNNs) 등 최신 이미지 분석 모델을 활용하여 이미지 피쳐 추출 → 추출된 벡터를 통해 유사성을 계산하고, 관련 상품을 추천함

5. Summary

- 콘텐츠와 사용자 신호는 AI 기반 검색 애플리케이션의 핵심 연료로 작용

- 벡터 공간 모델과 코사인 유사성은 텍스트 기반 검색의 핵심 기술임.

- 최신 이미지 분석 모델을 활용하여 패션 상품 검색에 적용 가능

참고 문서 및 링크

본 블로그 포스트는 검색 엔진의 핵심 기술과 이를 패션 상품 검색에 적용할 수 있는 방법을 논리적으로 정리하였음. 이미지와 메타 데이터를 기반으로 한 검색 기술은 다양한 분야에서의 활용 가능성을 보여줌.

p64

문서를 순위화하기 위해, 문서와 쿼리 간의 코사인 유사도를 계산하는 과정을 사용 이 코사인 값이 각 문서의 관련성 점수가 되며, 이 점수를 기준으로 문서들을 정렬할 수 있음.

Listing 3.1 코드는 쿼리와 문서 벡터를 어떻게 표현하고, 각각의 문서와 쿼리 간의 코사인 유사도를 계산하는지를 보여줌.

Listing 3.1: 쿼리와 문서 벡터 사이의 코사인 유사도 계산

결과: 흥미로운 점은 두 문서가 전혀 다른 내용을 가지고 있음에도 불구하고 동일한 관련성 점수를 받았다는 것임. 이는 즉각적으로 이해하기 어려울 수 있으므로, 의미 있는 피쳐들만을 집중하여 계산을 단순화해 보겠음.

3.1.2 dense 벡터 표현 간의 유사도 계산

query_vector = np.array([0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0])

doc1_vector = np.array([0, 1, 1, 0, 1, 0, 0, 1, 1, 1, 1, 1, 0, 1, 1, 0, 0, 0, 0, 1, 1, 1, 0, 1, 0, 0, 0, 1, 1, 1, 0, 1, 0, 0, 1, 1, 1, 0, 0, 0, 0, 1, 1, 0, 0, 1, 1, 0])

doc2_vector = np.array([1, 0, 1, 1, 0, 1, 1, 0, 0, 0, 0, 0, 1, 0, 0, 1, 1, 1, 1, 0, 0, 0, 1, 0, 1, 1, 1, 1, 0, 0, 1, 0, 1, 1, 0, 0, 0, 1, 1, 1, 1, 0, 0, 1, 1, 0, 0, 1])

def cos_sim(vector1, vector2): return dot(vector1, vector2) / (norm(vector1) * norm(vector2))

doc1_score = cos_sim(query_vector, doc1_vector) doc2_score = cos_sim(query_vector, doc2_vector)

print(“Relevance Scores:\n doc1: “ + num2str(doc1_score) + “\n doc2: “ + num2str(doc2_score))

결과

doc1: 0.2828

doc2: 0.2828

TL;DR

- 문서와 쿼리 벡터 간의 코사인 유사도를 통해 문서의 관련성 점수를 계산

- dense 벡터는 모든 가능한 차원에 대한 값을 포함하므로 계산에 비효율적일 수 있음.

- 의미 있는 피쳐만을 포함하는 희소 벡터를 사용하여 계산을 단순화할 수 있음.

p65

이전 섹션의 계산을 이해하기 위해서는 쿼리와 문서 모두에 공통적으로 나타나는 피쳐만이 중요하다는 점을 이해해야 다른 피쳐들(쿼리에 없는 단어들)은 문서의 순위에 영향을 주지 않음. 결과적으로, 의미 없는 항목을 벡터에서 제거하여 희소 벡터 표현으로 변환 가능

희소 벡터 표현은 계산에 필요한 값만 포함하며, 불필요한 0 값을 제거 이는 검색 엔진의 스코어링 작업에서 효율적임.

Listing 3.2는 의미 있는 항목만 포함한 희소 벡터를 사용하여 쿼리와 문서 벡터 간의 코사인 유사도를 계산하는 방법을 보여줌.

Listing 3.2: 희소 쿼리와 문서 벡터 간의 코사인 유사도 계산

3.1.3 희소 벡터 표현 간의 유사도 계산

sparse_query_vector = [1, 1] #[apple, juice]

sparse_doc1_vector = [1, 1]

sparse_doc2_vector = [1, 1]

doc1_score = cos_sim(sparse_query_vector, sparse_doc1_vector)

doc2_score = cos_sim(sparse_query_vector, sparse_doc2_vector)

print("Relevance Scores:\n doc1: " + num2str(doc1_score) + "\n doc2: " +

num2str(doc2_score))

p66

희소 벡터 계산은 두 문서가 동일한 상대적 점수를 얻지만, 실제 점수는 1.0임. 이는 코사인 계산에서 벡터가 완벽하게 일치함을 의미

흥미로운 점

- 희소 벡터 계산은 여전히 두 문서가 동일한 관련성 점수를 반환

- 절대 점수는 다르지만, 두 벡터 타입 내에서 상대적 점수는 동일

- 쿼리와 각 문서 간의 피쳐 가중치가 동일하여 코사인 점수가 1.0임.

Sidebar: 벡터 vs. 벡터 표현

- dense 벡터: 대부분의 값이 0이 아닌 벡터

- 희소 벡터: 대부분의 값이 0인 벡터

- 벡터 표현: 실제 데이터 구조를 다룸. 희소 벡터 표현을 사용하여 0이 아닌 값만 처리

검색 엔진은 벡터의 각 피쳐을 1(존재) 또는 0(비존재)로 고려하지 않고, 각 피쳐이 얼마나 잘 일치하는지를 기반으로 점수를 제공

결과

doc1: 1.0

doc2: 1.0

TL;DR

- 희소 벡터 표현은 계산 효율성을 높이고 관련성 점수를 쉽게 비교할 수 있게

- 코사인 유사도를 사용할 때 쿼리와 문서 간의 피쳐 가중치가 중요

- 검색 엔진은 단순한 존재 여부가 아닌 일치도를 기반으로 점수를 조정

p67

이전 섹션의 문제는 용어 벡터의 피쳐이 단순히 단어의 존재 여부만을 나타낸다는 것임. 이는 두 문서(doc1, doc2)가 항상 동일한 코사인 유사도 점수를 가지게 만듦.

용어 빈도(term frequency)를 사용하여 문서가 단어를 얼마나 잘 대표하는지를 측정 가능 특정 문서에서 용어가 더 자주 나타날수록, 해당 문서가 쿼리와 더 관련이 있을 가능성이 높음.

Listing 3.3은 용어 빈도 기반의 벡터로 코사인 유사도를 계산하는 방법을 보여줌.

Listing 3.3: Raw term counts 기반의 용어 빈도 벡터의 코사인 유사도

3.1.4 용어 빈도(TF): 문서가 용어와 얼마나 잘 일치하는지 측정

doc1_tf_vector = [1, 1] #[apple:1, juice:1]

doc2_tf_vector = [3, 4] #[apple:3, juice:4]

query_vector = [1, 1] #[apple:1, juice:1]

doc1_score = num2str(cos_sim(query_vector, doc1_tf_vector))

doc2_score = num2str(cos_sim(query_vector, doc2_tf_vector))

print("Relevance Scores:\n doc1: " + str(doc1_score) + "\n doc2: " +

str(doc2_score))

결과:

doc1: 1.0

doc2: 0.9899

TL;DR

- 용어 빈도는 문서가 쿼리와 얼마나 잘 일치하는지를 나타내는 중요한 지표로

- 용어 빈도를 사용하여 코사인 유사도 점수를 조정하면 문서의 관련성을 더 정확하게 측정할 수 있음.

- 다른 스코어링 함수로 전환하여 피쳐 가중치의 증가에 따라 점수가 증가하도록 조정할 수 있음.

텍스트 유사도 평가 및 개선 방법

1. 서론

1.1. 문제 인식

- 텍스트 유사도 평가에서 단순히 단어 빈도만을 활용하는 방식의 제한

- 예: ‘apple’과 ‘juice’가 독립적인 용어로 처리됨

- 개선 필요: 문장 혹은 구문을 하나의 단위로 인식하여 더 높은 유사도 점수 부여 필요

1.2. 해결 방법

- 벡터 기반 유사도 평가 및 텍스트 기반 키워드 점수 조정

- 최적의 매칭을 위한 쿼리 벡터 조정

2. 코사인 유사도와 벡터 연산

2.1. 코사인 유사도 정의

- 벡터 간의 유사도를 측정하는 방법

- 수식: \(\text{cosine similarity} = \frac\)

- \(A\)와 \(B\)는 각각의 텍스트 벡터임

2.2. 텍스트 벡터 생성

- 예

- 문서 1: “In light of the big reveal in the interview, …”

- 문서 2: “My favorite book is the cat in the hat, …”

- 문서 3: “My careless neighbors apparently let a stray cat stay in their garage …”

- 단어 ‘the’, ‘cat’, ‘in’, ‘the’, ‘hat’에 대한 빈도 벡터 생성

- 문서별 단어 빈도 벡터 계산 및 출력

3. TF 계산의 문제 및 개선

3.1. 기존 TF의 문제점

- 단순 빈도로 인해 긴 문서가 과대 평가됨

- 예: 문서 내 단어 반복이 많아질수록 점수가 높아짐

3.2. 개선된 TF 계산 방법

- TF를 각 단어 출현 수의 제곱근으로 계산

- 수식: \(\text{TF} = \frac{\sqrt{\text{term count}}}{\text{vector length}}\)

- 문서 길이에 따른 정규화 포함

4. 개선 후 결과

4.1. 결과 비교

- 개선된 TF를 사용하여 코사인 유사도 계산

- 이전보다 직관적인 결과 도출

- 예: ‘The Cat in the Hat’ 관련 문서가 더 높은 점수 획득

4.2. 핵심

- 텍스트 유사도 계산에서 단순 TF 대신 제곱근 및 정규화를 통해 개선된 결과 도출

- 벡터 기반의 코사인 유사도를 통한 문서 간 유사성 평가

- 일관된 TF 계산으로 긴 문서와 짧은 문서 간의 비교 가능

5. 응용 사례: 패션 상품 검색

5.1. 이미지 및 텍스트 기반 검색

- 이미지 및 메타 데이터를 활용한 패션 상품 검색

- 예: 이미지에서 패턴, 색상 등을 벡터화하여 유사한 패션 상품 추천

- 메타 데이터에서 키워드 추출 및 TF 계산을 통해 검색 결과 개선

5.2. 기술 구현

- 이미지 벡터화: CNN(Convolutional Neural Network) 활용

- 텍스트 분석: TF-IDF 및 개선된 TF로 키워드 추출

6. 결론

6.1. 최종 정리

- 개선된 TF 계산 방식과 코사인 유사도의 결합으로 텍스트 유사도 평가의 정확성 향상

- 다양한 응용 분야에서의 활용 가능성 증대

6.2. 향후 연구 방향

- 더 복잡한 구문 인식 및 다양한 언어 지원을 위한 추가 연구 필요

Figure 3.3 Term Frequency Calculation.

- \(t\)는 용어, \(d\)는 문서를 나타냄

- TF는 현재 문서에서 용어가 나타나는 횟수의 제곱근을, 문서 내 전체 용어 수로 나눈 값

- 제곱근을 통한 빈도 감쇠 및 문서 길이에 따른 정규화로 긴 문서와 짧은 문서 간 비교 가능

p72

정규화된 TF(Term Frequency) 도입으로 인해 doc2가 가장 높은 순위를 기록, 이는 예상된 결과임. 이는 doc1이 특정 단어를 너무 많이 포함하여 발생하는 가중치 감소 효과 때문임. 그러나 doc1이 여전히 두 번째로 높은 순위를 차지, 개선된 TF 함수가 doc3를 상위로 끌어올리기에 부족했음.

- 문제점: 특정 단어의 중요성이 반영되지 않음

- 예시: “the”와 “in”보다 “cat”과 “hat”이 더 중요

- 해결책: 각 단어의 중요성을 고려한 새로운 변수 도입 필요.

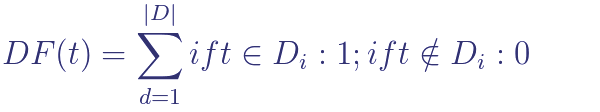

단어 빈도(TF)는 문서와 쿼리의 일치도를 측정하는 데 유용하지만, 각 단어의 중요성을 구별하는 데 한계가 있음. 이 섹션에서는 특정 키워드의 중요성을 문서 빈도(DF)를 통해 평가하는 방법을 설명

- 문서 빈도(DF): 특정 단어가 포함된 문서 수를 나타냄.

- 직관: 일반적인 단어보다 드문 단어가 더 중요

- 수식: DF는 특정 단어를 포함한 문서 수로 계산됨. 숫자가 낮을수록 쿼리에서 중요성이 큼.

문서 빈도 계산을 나타냄. 모든 문서 집합 D와 입력 단어 t가 주어지며, DF는 입력 단어를 포함하는 문서의 수를 나타냄. 숫자가 낮을수록 쿼리에서 중요성이 더 크다는 것을 의미

labels: [the, cat, in, the, hat]

doc1_vector: [0.0942, 0.0, 0.0769, 0.0942, 0.0]

doc2_vector: [0.0456, 0.0456, 0.0456, 0.0456, 0.0456]

doc3_vector: [0.0, 0.0385, 0.0544, 0.0, 0.0385]

query_vector: [0.0942, 0.0456, 0.0769, 0.0942, 0.0456]

Relevance Scores:

doc2: 0.9222

doc1: 0.9559

doc3: 0.5995

3.1.5 역문서 빈도(IDF): 쿼리에서 단어의 중요성 측정

p73

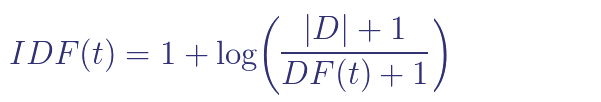

- IDF 도입 이유: 더 중요한 단어가 높은 점수를 받도록 하기 위

- IDF 정의: 문서 빈도의 역수를 취

-

수식: $$ \text{IDF}(t) = 1 + \log\left(\frac{ D }{\text{DF}(t) + 1}\right) $$ - 의미: DF가 낮을수록 단어의 중요성이 커짐.

-

| 역문서 빈도 계산을 나타냄. | D | 는 전체 문서 수, t는 단어, DF(t)는 해당 단어를 포함하는 문서 수임. 숫자가 낮을수록 단어의 중요성이 적음을 의미하며, 숫자가 높을수록 쿼리의 관련성 점수에 더 큰 영향을 미침. |

df_map = {"the": 9500, "cat": 100, "in":9000, "hat":50}

totalDocs = 10000

def idf(term):

return 1 + np.log(totalDocs / (df_map[term] + 1))

idf_vector = np.array([idf("the"), idf("cat"), idf("in"), idf("the"), idf("hat")])

print ("labels: [the, cat, in, the, hat]\nidf_vector: " + vec2str(idf_vector))

labels: [the, cat, in, the, hat]

idf_vector: [1.0512, 5.5952, 1.1052, 1.0512, 6.2785]

- 결과: 단어의 상대적 중요도가 반영되어 “hat”과 “cat”이 가장 높은 중요도를 가짐.

p74

TF와 IDF의 결합으로 균형 잡힌 관련성 점수인 TF-IDF를 생성할 수 있음.

- TF: 문서가 단어를 얼마나 잘 설명하는지를 측정.

- IDF: 각 단어의 중요성을 측정.

TF-IDF는 문서와 쿼리의 텍스트 유사성을 평가하는 데 널리 사용됨. 이는 두 요소를 결합하여 텍스트 기반 관련성 점수를 계산

- 수식: \(\text{TF-IDF} = \text{TF} \times \text{IDF}^2\)

p75

코드 예제: 쿼리 “the cat in the hat”에 대한 TF-IDF 순위 계산

def tf_idf(tf, idf):

return tf * idf**2

query = "the cat in the hat"

print ("labels: [the, cat, in, the, hat]")

doc1_tfidf = [

tf_idf(tf(doc1, "the"), idf("the")),

tf_idf(tf(doc1, "cat"), idf("cat")),

tf_idf(tf(doc1, "in"), idf("in")),

tf_idf(tf(doc1, "the"), idf("the")),

tf_idf(tf(doc1, "hat"), idf("hat"))

]

print("doc1_tfidf: " + vec2str(doc1_tfidf))

doc2_tfidf = [

tf_idf(tf(doc2, "the"), idf("the")),

tf_idf(tf(doc2, "cat"), idf("cat")),

tf_idf(tf(doc2, "in"), idf("in")),

tf_idf(tf(doc2, "the"), idf("the")),

tf_idf(tf(doc2, "hat"), idf("hat"))

]

print("doc2_tfidf: " + vec2str(doc2_tfidf))

doc3_tfidf = [

tf_idf(tf(doc3, "the"), idf("the")),

tf_idf(tf(doc3, "cat"), idf("cat")),

tf_idf(tf(doc3, "in"), idf("in")),

tf_idf(tf(doc3, "the"), idf("the")),

tf_idf(tf(doc3, "hat"), idf("hat"))

]

print("doc3_tfidf: " + vec2str(doc3_tfidf))

query_tfidf = np.maximum.reduce([doc1_tfidf, doc2_tfidf, doc3_tfidf])

doc1_relevance = cos_sim(query_tfidf,doc1_tfidf)

doc2_relevance = cos_sim(query_tfidf,doc2_tfidf)

doc3_relevance = cos_sim(query_tfidf,doc3_tfidf)

print("\nRelevance Scores:\n doc2: " + num2str(doc2_relevance)

+ "\n doc3: " + num2str(doc3_relevance)

+ "\n doc1: " + num2str(doc1_relevance))

- 결과: doc2가 가장 높은 점수를 얻으며, 중요한 단어를 가장 잘 일치시킴. doc3는 적은 횟수로 모든 단어를 포함하며 두 번째로 높은 점수를 얻음. doc1는 중요하지 않은 단어만 풍부하게 포함하여 가장 낮은 점수를 얻음.

labels: [the, cat, in, the, hat]

doc1_tfidf: [0.1041, 0.0, 0.094, 0.1041, 0.0]

doc2_tfidf: [0.0504, 1.4282, 0.0557, 0.0504, 1.7983]

doc3_tfidf: [0.0, 1.2041, 0.0664, 0.0, 1.5161]

Relevance Scores:

doc2: 0.9993

doc3: 0.9979

doc1: 0.0758

TL;DR

- 정규화된 TF는 문서의 단어 일치도를 개선하지만, 단어 중요성을 반영하지 못하게 되며,

- IDF를 통해 드문 단어의 중요성을 반영하여 단어의 상대적 중요성을 평가.

- TF-IDF는 문서와 쿼리의 유사성을 균형 있게 평가하는 데 사용되며, 중요한 단어가 더 많은 가중치를 얻음.

적용 예시: 패션 상품 검색

패션 상품을 검색할 때도 TF-IDF를 활용할 수 있음. 예를 들어, 사용자가 “red dress with floral pattern”이라는 쿼리를 입력했을 때, 각 패션 아이템의 텍스트 설명을 분석하여 쿼리와의 관련성을 평가

- 인풋: 각 상품의 텍스트 설명

- 아웃풋: 쿼리와의 유사성 점수

TF-IDF는 “red”, “dress”, “floral”, “pattern”과 같은 단어의 출현 빈도와 중요성을 고려하여 검색 결과를 순위화 이 방법은 이미지 검색에서도 메타 데이터를 활용하여 유사성을 평가할 수 있음.

- 인풋 예시: 상품 설명 텍스트

- 아웃풋 예시: 관련성 점수 기반 순위화된 상품 리스트

이런 접근 방식은 검색 결과의 정확성을 높이고, 사용자에게 더 만족스러운 검색 경험을 제공할 수 있음.

기술 블로그: 검색 엔진에서의 유사도 계산 및 BM25

개요

검색 엔진에서 문서의 관련성을 평가하기 위한 다양한 방법이 존재 대표적으로 사용되는 기법은 Cosine Similarity와 TF-IDF이며, 최근에는 BM25가 이런 방법을 보다 개선한 형태로 주목받고 있음. 본 포스트에서는 각 기법의 수학적 배경과 실제 활용 사례를 중심으로 설명

1. Cosine Similarity vs. TF-IDF 매칭 점수

- Cosine Similarity 두 벡터 사이의 각도를 기반으로 유사도를 계산 벡터의 크기를 무시하고, 두 벡터가 이루는 각도에 집중 따라서, 쿼리 벡터 내의 각 단어의 최대 점수를 사용하여 유사도를 계산

- 예: 쿼리 벡터가

[1, 1]일 때, 문서 벡터[2, 2],[3, 3],[N, N]은 모두 코사인 값1.0을 가짐. 이는 모든 문서가 쿼리와 동일한 비율로 키워드를 포함하고 있음을 의미

- 예: 쿼리 벡터가

- TF-IDF (Term Frequency-Inverse Document Frequency) 단어의 발생 빈도(TF)와 문서 내에서의 중요도(IDF)를 반영하여 각 단어의 가중치를 설정

- TF는 특정 단어가 문서 내에서 얼마나 자주 등장하는지를 측정하고, IDF는 전체 문서 집합에서 해당 단어의 중요성을 나타냄.

- 검색 엔진에서 TF-IDF는 문서의 관련성을 평가하는 데 있어 중요한 역할을

TL;DR

- Cosine Similarity는 벡터의 각도를 기반으로 유사도를 계산하며, 벡터 크기를 무시

- TF-IDF는 단어의 빈도와 중요도를 고려하여 문서의 관련성을 평가

- BM25는 TF-IDF와 유사하지만, 문서 길이 정규화 및 빈도 포화점 조절 기능을 추가하여 보다 정교한 유사도 계산을 가능하게

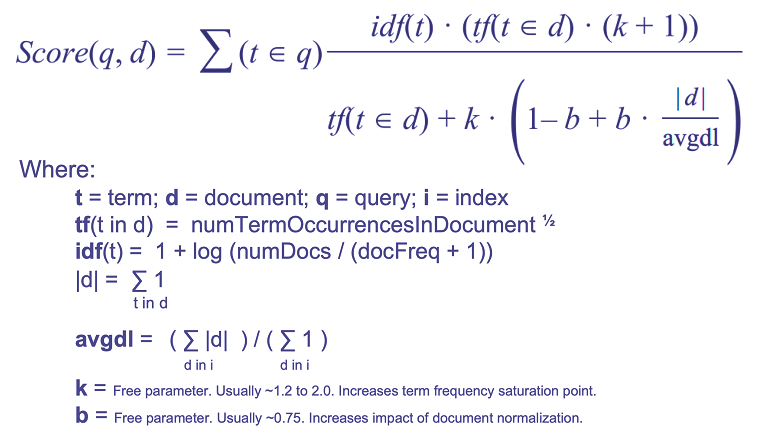

2. BM25: Lucene의 기본 텍스트-유사도 알고리즘

- BM25 (Okapi “Best Matching” version 25) Apache Lucene, Solr, Elasticsearch 등에서 기본적으로 사용되는 유사도 알고리즘. 1994년에 처음 발표되었으며, 기존 TF-IDF 코사인 유사도 순위를 개선

- TF 및 IDF 활용 기본적으로 TF-IDF를 기반으로 하며, 추가적인 파라미터를 통해 단어 빈도 포화점 및 문서 길이 정규화를 용이하게 제어

- 수식 설명

\(\text{Score}(D, Q) = \sum_{t \in Q} \text{IDF}(t) \cdot \frac{\text{TF}(t, D) \cdot (k_1 + 1)}{\text{TF}(t, D) + k_1 \cdot (1 - b + b \cdot \frac{|D|}{\text{avgdl}})}\)

- \(\text{IDF}(t)\): 단어 \(t\)의 중요도

- \(\text{TF}(t, D)\): 문서 \(D\) 내 단어 \(t\)의 빈도

- \(k_1\), \(b\): 조정 가능한 파라미터

-

$$ D $$: 문서의 길이 - \(\text{avgdl}\): 전체 문서 집합의 평균 문서 길이

3. BM25 적용 예제

- Solr에서의 BM25 활용 Solr를 통해 BM25 계산을 시뮬레이션하고, 문서 컬렉션을 생성하여 검색 쿼리를 실행

- 컬렉션 생성 및 문서 추가

collection = "cat_in_the_hat" create_collection(collection) upsert_text_field(collection, "title") upsert_text_field(collection, "description") docs = [ {"id": "doc1", "title": "Worst", "description": "The interesting thing..."}, {"id": "doc2", "title": "Best", "description": "My favorite book..."}, {"id": "doc3", "title": "Okay", "description": "My neighbors let..."} ] response = requests.POST(solr_url + collection + "/update?commit=true", json=docs).json()

- 컬렉션 생성 및 문서 추가

-

검색 및 결과 확인 생성된 컬렉션에 대해 쿼리를 실행하여 BM25 점수를 확인

- Apache Solr Documentation

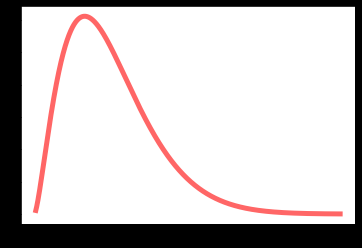

Figure 3.6 BM25 Scoring Function BM25의 수식 구조를 시각적으로 설명하며, 각 단어의 추가 발생이 점수에 얼마나 기여하는지를 조절하는 \(k\) 파라미터와, 문서 길이에 따른 정규화를 수행하는 \(b\) 파라미터를 설명

이와 같은 방식으로 BM25를 활용하여 패션 상품을 검색할 때, 이미지 및 텍스트 메타 정보를 활용하여 보다 정확한 검색 결과를 제공할 수 있음. 예를 들어, 특정 색상이나 스타일의 이미지를 입력하여 유사한 패션 아이템을 추천받을 수 있으며, 텍스트 설명과 결합하여 보다 풍부한 검색 경험을 제공

p80

Listing 3.12: BM25 유사도 점수를 통한 순위 매기기 및 점검

-

목표 주어진 쿼리와 문서에 대해 BM25 알고리즘을 사용하여 문서의 유사도 점수를 계산하고, 순위 매김 과정을 점검

- 쿼리 설정

query = "the cat in the hat"설정- 요청 형식:

request = { "query": query, "fields": ["id", "title", "description", "score", "[explain style=html]"], "params": { "qf": "description", "defType": "edismax", "indent": "true" } } - IPython을 사용하여 쿼리 및 순위가 매겨진 문서 결과를 HTML 형식으로 표시

- 응답 처리

- Solr 서버에 요청을 보내 응답을 JSON 형식으로 변환 후, HTML 형식으로 변환하여 시각적으로 표시

response = str(requests.POST(solr_url + collection + "/select",

json=request).json()["response"]["docs"]).replace('\\n', '').replace(", '", ",<br/>'")

display(HTML(response))

- 쿼리:

the cat in the hat - 순위 매겨진 문서

- doc2

- 제목:

Best - 설명:

My favorite book is the cat in the hat, which is about a crazy cat who breaks into a house and creates a crazy afternoon for two kids. - 점수:

0.6823196 - 설명:

- BM25 점수 계산 과정 설명

0.6823196 = sum of: [...]

- BM25 점수 계산 과정 설명

- 제목:

p81

-

계산 과정

- TF (Term Frequency) 계산:

\(\text{tf} = \frac{\text{freq}}{\text{freq} + k1 \times (1 - b + b \times \frac{\text{dl}}{\text{avgdl}})}\)

freq: 문서 내에서의 용어 출현 횟수k1: 용어 포화 파라미터 (대부분 1.2 사용)b: 길이 정규화 파라미터 (주로 0.75 사용)dl: 필드의 길이avgdl: 필드의 평균 길이

- IDF (Inverse Document Frequency) 계산:

\(\text{idf} = \log\left(1 + \frac{N - n + 0.5}{n + 0.5}\right)\)

n: 용어를 포함한 문서 수N: 필드에 존재하는 전체 문서 수

- TF (Term Frequency) 계산:

\(\text{tf} = \frac{\text{freq}}{\text{freq} + k1 \times (1 - b + b \times \frac{\text{dl}}{\text{avgdl}})}\)

p82

- 구체적 예시

- doc3

- 제목:

Okay - 설명:

My neighbors let the stray cat stay in their garage, which resulted in my favorite hat that I let them borrow being ruined. - 점수:

0.62850046 - 설명:

- BM25 점수 계산 과정 설명

- 각 용어별 TF, IDF 계산 및 결과 합산

- 제목:

- doc3

p83

- BM25 vs TF-IDF

- BM25는 TF-IDF를 기반으로 복잡한 계산을 수행하나, 기본적으로 TF-IDF를 중심으로 동작

- 쿼리를 벡터로 생각하는 대신, 수학적 함수로 구성된 것으로 간주 가능

- Solr의 쿼리 문법을 사용하여 BM25 점수 계산

TL;DR

- BM25 알고리즘은 TF와 IDF를 결합하여 문서의 유사도를 계산

- 각 용어별로 개별 계산된 점수들이 합산되어 최종 BM25 점수가 도출됨.

- Solr 쿼리를 통해 BM25 점수를 함수로 표현하여 동일한 결과를 얻을 수 있음.

- 적용 예시

- 패션 상품 검색: 이미지 및 상품 메타정보를 사용하여 BM25를 통해 유사한 스타일의 상품을 검색 가능

- 이미지의 색상, 패턴, 텍스트 설명을 BM25의 필드로 활용하여 유사도 기반 검색 구현 가능

텍스트 유사성 및 관련성 강화 기법

1. 텍스트 유사성 계산 및 쿼리 함수 활용

1.1. 텍스트 유사성 및 쿼리 함수 설명

- Query Function 검색 엔진의 쿼리 내 각 용어는 실제로는 구성 가능한 스코어링 함수로 작동함

- 예) BM25 유사도 알고리즘: 기본적으로 텍스트 기반 유사도를 계산하는 함수로 많이 사용됨

query = ‘{!func}query(“the”) {!func}query(“cat”) {!func}query(“in”) {!func}query(“the”) {!func}query(“hat”)’

- Request 구성 쿼리를 구성하여 검색 요청을 생성함

fields: 검색 결과에 포함될 필드 지정params: 쿼리의 다양한 파라미터 설정 예시

request = {

"query": query,

"fields": ["id", "title", "score"],

"params": {

"qf": "description",

"defType": "edismax",

"indent": "true"

}

}

- output 쿼리 결과를 HTML 형식으로 출력하여 가독성 향상

response = str(requests.POST(solr_url + collection + "/select",

json=request).json()["response"]["docs"]).replace('\\n', '').replace(", ", ",<br/>'")

TL;DR

- 쿼리 내 각 용어는 스코어링 함수로 구성 가능하며, BM25 유사도 알고리즘이 기본으로 사용됨.

- 쿼리 요청은

fields와params를 통해 구성되고, 결과는 HTML로 출력됨. - 다양한 함수와 파라미터를 사용하여 복합적인 검색 결과를 조정 가능

2. 관련성 강화 기법

2.1. 관련성 강화 기법 목록

- 지리적 부스트(Geospatial Boosting) 사용자 위치 근처의 문서에 가중치 부여

- 날짜 부스트(Date Boosting) 최신 문서에 가중치 부여

- 인기 부스트(Popularity Boosting) 유명한 문서에 가중치 부여

- 필드 부스트(Field Boosting) 특정 필드에 일치하는 용어에 가중치 부여

- 카테고리 부스트(Category Boosting) 쿼리 용어와 관련된 카테고리에 속한 문서에 가중치 부여

- 구문 부스트(Phrase Boosting) 여러 용어로 이루어진 구문에 일치하는 문서에 가중치 부여

- 의미 확장(Semantic Expansion) 쿼리 키워드와 관련된 다른 단어 또는 개념을 포함하는 문서에 가중치 부여

2.2. 필드 부스트 예시

- edismax 쿼리 파서 활용 필드 부스트를 통해 특정 필드에 가중치 조정 가능

q={!type=edismax}the cat in the hat

qf="title^10 description^2.5"

- 구문 부스트 특정 구문에 대해 필드 내에서 가중치를 부여하는 방식

Boost docs containing the exact phrase “the cat in the hat” in the title field

TL;DR

- 관련성 강화 기법은 지리적, 날짜, 인기, 필드, 카테고리, 구문, 의미 확장 등 다양한 기법으로 구성됨.

edismax쿼리 파서를 통해 특정 필드에 대한 가중치를 조정 가능- 구문 부스트는 특정 구문에 대해 필드 내에서 가중치를 부여하여 검색 결과에 반영

3. 복합적인 정렬 및 가중치 조정

3.1. 복합 정렬 및 가중치 조정

-

기능 쿼리 활용 다양한 기능을 통해 복합적인 정렬 및 가중치 조정 가능

q={!func}scale(query($keywords),0,25) {!func}recip(geodist($lat_long_field,$user_latitude,$user_longitude), 1,25,1) {!func}recip(ms(NOW/HOUR,modify_date),3.16e-11,25,1) {!func}scale(popularity,0,25) -

가중치 조정 각 기능의 상대적 기여도를 설정하여 최종 관련성 계산에 반영

3.2. 학습 기반 랭킹 모델

- 학습 기반 랭킹 챕터 10에서 학습 기반 랭킹 모델을 통해 자동으로 의사 결정을 내리는 방법 제시

TL;DR

- 복합적인 기능 쿼리를 활용하여 다양한 요소를 반영한 정렬 및 가중치 조정 가능

- 각 기능의 상대적 가중치를 조정하여 최종 관련성 계산에 반영

- 학습 기반 랭킹 모델을 통해 의사 결정을 자동화할 수 있으며, 이는 챕터 10에서 다룸.

4. 추가 참고 자료

- Solr in Action Trey Grainger와 Timothy Potter의 “Solr in Action”의 챕터 15에서 복잡한 쿼리 연산에 대한 상세 설명 제공

- Solr Reference Guide Solr의 기능 쿼리에 대한 문서는 Solr Reference Guide의 function query 섹션에서 확인 가능

TL;DR

- Trey Grainger와 Timothy Potter의 “Solr in Action” 챕터 15에서 복잡한 쿼리 연산에 대한 심도 있는 설명 제공.

- Solr Reference Guide의 function query 섹션에서 기능 쿼리에 대한 추가적인 정보 확인 가능.

- 추가 자료를 통해 기능 쿼리에 대한 이해를 심화할 수 있음.

검색 엔진에서의 부스팅과 필터링

3.2.4 부스팅과 필터링의 차이

검색 엔진에서 문서의 관련성을 평가하고 순위를 매기는 방법은 중요 이 과정에서 주로 사용되는 두 가지 부스팅 기법은 덧셈 부스팅 (Additive Boosting)과 곱셈 부스팅 (Multiplicative Boosting)임.

- 덧셈 부스팅 (Additive Boosting)

- 각 피처가 전체 관련성 함수에 기여하는 정도를 명확히 제한함으로써 부스팅 효과를 얻음.

- 예: 각 피처의 최소 및 최대 값을 명시적으로 제한하여, 각 피처가 전체 검색 점수에 기여하는 바가 명확해짐.

- Pros(+): 여러 피처의 기여도를 명확히 조정할 수 있음.

- Cons(-): 피처의 수가 증가할수록 복잡도가 높아짐.

- 곱셈 부스팅 (Multiplicative Boosting)

- 각 부스팅이 문서의 전체 관련성 점수에 곱해지므로 부스팅 효과가 누적됨.

- 예: 문서의 관련성 점수를 인기도 필드의 값에 10을 곱하여 부스팅.

- Pros(+): 다양한 관련성 피처를 쉽게 조합할 수 있음.

- Cons(-): 특정 피처의 부스팅 값이 너무 높아지면 다른 피처를 압도할 수 있음.

코드 예제

곱셈 부스팅의 예를 들자면, Solr에서 다음과 같이 사용할 수 있음

q=the cat in the hat&

defType=edismax&

boost=mul(popularity,10)

또는

q=the cat in the hat

{!boost b=mul(popularity,10)}

TL;DR

- 덧셈 부스팅은 각 피처의 기여도를 명확히 조정할 수 있지만 복잡도가 높아질 수 있음.

- 곱셈 부스팅은 다양한 피처를 조합할 수 있는 유연성을 제공하지만, 특정 피처가 다른 피처를 압도할 위험이 있음.

- 두 가지 부스팅 방식은 상황에 따라 유용하게 사용될 수 있으며, 실험을 통해 최적의 결과를 찾아야

3.2.5 논리적 매칭: 쿼리 내 용어 간의 관계 가중치

검색 엔진에서의 매칭은 크게 두 가지 단계로 나눌 수 있음

- 매칭 (Filtering): 쿼리에 적합한 문서 집합을 필터링.

- 랭킹 (Ranking): 필터링된 문서들을 관련성에 따라 정렬.

특히, 필터링은 성능 최적화에 기여하며, 논리적으로 일치하는 문서 집합을 줄임으로써 검색 엔진의 응답 시간을 단축할 수 있음. 필터링을 통해 검색 결과의 총 문서 수를 줄이고, 사용자가 결과 집합을 탐색하고 세분화할 수 있도록 도움.

논리적 매칭의 예

- “statue of liberty”라는 쿼리에 대해, 논리적 매칭은 다음과 같이 다르게 적용될 수 있음:

- “statue of liberty”: 문서가 정확한 구문을 포함할 때만 매칭.

- “statue AND of AND liberty”: 모든 용어를 포함하는 문서와 매칭.

- “statue OR of OR liberty”: 하나 이상의 용어를 포함하는 문서와 매칭.

최소 매칭 (Minimum Match) 파라미터

Solr의 mm 파라미터는 최소 매칭 임계값을 설정하여 각 쿼리의 논리적 구조를 쉽게 제어할 수 있음. 예를 들어, 다음과 같이 사용할 수 있음:

mm=100% ## 모든 쿼리 용어가 일치해야 함

mm=0% ## 적어도 한 개의 쿼리 용어가 일치해야 함

mm=2 ## 적어도 두 개의 쿼리 용어가 일치해야 함

3.2.6 필터링과 스코어링의 분리

Solr에서는 필터링과 스코어링을 제어하는 두 가지 주요 방법이 있음:

- 쿼리 (Query) 파라미터 (

q): 검색 쿼리 자체를 정의. - 필터 (Filter) 파라미터 (

fq): 필터링을 통해 결과 집합을 좁힘.

예를 들어, 다음과 같은 쿼리를 통해 특정 카테고리 및 관객을 대상으로 필터링할 수 있음:

q=the cat in the hat&

fq=category:books&

fq=audience:kid&

defType=edismax&

mm=100%&

qf=description

관련 문서 및 기술

- Solr Reference Guide를 통해 Solr의 필터링 및 부스팅 기능에 대한 자세한 정보를 확인할 수 있음.

- 검색 엔진 최적화 및 부스팅 기법의 이해는 사용자 경험을 크게 향상시킬 수 있으며, 패션 상품 검색과 같은 실생활 응용에 유용하게 사용될 수 있음.

p92

필터링과 관련 파라미터의 역할

q(query) 파라미터- 필터와 관련성 랭킹을 위한 피처 벡터 역할 수행

- 필터링과 스코어링을 동시에 수행 → 쿼리에서는 비효율적일 수 있음

fq(filter query) 파라미터- 오직 필터링 목적

- 관련성 랭킹에는 관여하지 않음

bq(boost query) 파라미터- 오직 관련성에 기반한 부스트 기능

- 필터링은 수행하지 않음

논리적 차이점

q는 필터링과 관련성 랭킹을 동시에 수행fq는 필터링 전용bq는 관련성 부스트 전용

#> 예시 쿼리

q={!func}query("{!type=edismax qf=description mm=100% v=$query}")&

fq={!cache=false v=$query}&

query=the cat in the hat

q=*:*

&bq={!type=edismax qf=description mm=100% v=$query}&

fq={!cache=false v=$query}&

query=the cat in the hat

cache=false: 필터 캐시 비활성화- 사용자 입력 쿼리의 다양성 때문에 캐시 비활성화가 필요

TL;DR

q,fq,bq파라미터는 각각 다른 역할을 수행하며,q는 두 가지 역할을 하며,- 필터 캐시는 사용자 입력 쿼리의 다양성 때문에 비활성화가 필요할 수 있음.

- 필터링과 관련성 랭킹의 분리는 복잡한 랭킹 함수를 구축할 때 유리

p93

도메인 특화 관련성 랭킹

- 도메인 특화 요소 예시

- 레스토랑 검색에서는 지리적 근접성, 사용자 맞춤식 요구 사항 등이 중요

- 뉴스 검색에서는 최신성, 인기, 지리적 영역이 중요

- 전자상거래에서는 전환 가능성 등이 중요

관련성 엔지니어링

- 관련성 엔지니어링

- 검색 엔진의 관련성을 조정하는 전문 분야

- “Relevant Search” 서적 추천

TL;DR

- 도메인 특화 관련성 랭킹은 사용자 경험을 향상시킴.

- 관련성 엔지니어링은 검색 엔진의 성능 향상에 필수적임.

- 관련성 랭킹은 자동화된 학습 기법을 통해 최적화될 수 있음.

p94

AI 기반 검색 엔진 구축

- AI를 활용한 검색 엔진

- 머신 러닝을 통해 최적의 관련성 알고리즘 자동 생성 및 가중치 설정

- 사용자의 행동을 기반으로 학습하여 관련성을 향상

관련성 최적화 방법

- TF-IDF 및 BM25: 텍스트 유사성 평가에 사용

- 텍스트 유사성 스코어링 외에도 사용자 특화 피처 활용 필요

TL;DR

- AI 기반 검색 엔진은 사용자 행동을 기반으로 관련성을 자동으로 학습

- 텍스트 유사성 스코어링 외에도 다양한 피처를 활용하여 관련성을 최적화할 수 있음.

- 머신 러닝을 통해 도메인 특화 및 사용자 특화 관련성을 구현할 수 있음.

p95

크라우드소싱을 통한 관련성 향상

- 사용자 행동 신호 수집 및 활용

- Reflected Intelligence를 통한 모델 자동 조정

- 크라우드소싱을 통해 콘텐츠 기반 신호 학습

크라우드소싱의 중요성

- 사용자 행동 기반의 암묵적 학습

- 사용자의 집단적 통찰을 활용하여 검색 플랫폼의 관련성을 개선

TL;DR

- 크라우드소싱은 사용자 행동을 통해 검색 관련성을 향상시키는 데 유용하며,

- 사용자의 집단적 통찰을 통해 자동화된 모델 조정 가능.

- 검색 플랫폼의 관련성 향상을 위한 다양한 신호 수집 및 활용 필요.

이 문서는 다양한 검색 관련성 최적화 기법을 설명하며, 각 파라미터의 역할과 이들의 조합을 통해 검색 결과를 어떻게 최적화할 수 있는지를 다루고 있음. 특히, AI 및 머신 러닝을 활용한 자동화된 관련성 최적화 방법에 초점을 맞추고 있음.

사용자 신호와 콘텐츠의 조화로운 활용

4.1 사용자 신호 작업

4.1.1 신호와 콘텐츠

-

사용자 신호의 정의 사용자가 검색 쿼리를 발행하고, 결과를 클릭하거나, 제품을 구매하는 등의 행동을 통해 사용자의 의도를 인퍼런스할 수 있는 신호 생성 → 이런 신호는 사용자의 의도를 이해하는 데 중요한 역할을

- 콘텐츠의 정의 검색 엔진에서 다루는 콘텐츠는 주로 문서 형태로 존재하며, 웹 페이지, 제품 목록, 이미지, 데이터 등이 포함됨 → 콘텐츠는 사용자가 검색하는 정보 자체를 포함하고 있음.

- 신호와 콘텐츠의 관계 콘텐츠는 검색의 대상, 신호는 사용자의 상호작용을 반영 → 두 가지 정보 소스를 통해 검색 정확성을 향상시킬 수 있음.

- 예시 “driver”라는 단어의 동의어를 찾는 과정에서 콘텐츠 기반 접근은 “taxi”, “car” 등의 단어를 우선적으로 찾음. 반면, 신호 기반 접근은 “screwdriver”, “printer” 등의 단어를 강조함 → 콘텐츠는 문서 내 의미를, 신호는 사용자가 찾고자 하는 의미를 반영

핵심 사용자 신호는 사용자의 의도를 인퍼런스하는 데 중요하며, 콘텐츠는 검색의 대상이 됨. 두 가지 접근을 통합하여 더 정확한 검색 시스템 구축 가능. 콘텐츠와 신호의 조화로운 활용이 중요

4.1.2 제품 및 신호 데이터셋 설정 (RetroTech)

-

RetroTech 사례 소개 전자상거래 검색은 다양한 AI 기반 검색 기법을 탐구할 수 있는 좋은 기회 제공. RetroTech는 빈티지 하드웨어, 소프트웨어, 멀티미디어 제품을 제공하는 이커머스 플랫폼임.

-

데이터셋 설정 RetroTech 웹사이트의 약 50,000개 제품을 검색 엔진에 로드하여 검색 가능하도록 설정 → 제품 카탈로그와 사용자 신호 데이터를 포함한 CSV 파일을 통해 데이터셋 구성.

-

코드 실행 및 결과

- 제품 컬렉션 생성:

create_collection(products_collection) - 스키마 수정: 특정 필드를 키워드로 검색 가능하도록 설정.

- CSV 파일 로드 및 제품 문서 인덱싱: Spark를 활용하여 CSV 파일을 읽고 Solr로 저장.

- 제품 컬렉션 생성:

## Create Products Collection

products_collection = "products"

create_collection(products_collection)

## Modify Schema to make some fields explicitly searchable by keyword

upsert_text_field(products_collection, "upc")

upsert_text_field(products_collection, "name")

upsert_text_field(products_collection, "longDescription")

upsert_text_field(products_collection, "manufacturer")

print("Loading Products...")

csvFile = "../data/retrotech/products.csv"

product_update_opts = {"zkhost": "aips-zk", "collection": products_collection,

"gen_uniq_key": "true", "commit_within": "5000"}

csvDF = spark.read.format("com.databricks.spark.csv").option(

"header", "true").option("inferSchema", "true").load(csvFile)

csvDF.write.format("solr").options(**product_update_opts).mode(

"overwrite").save()

print("Products Schema: ")

csvDF.printSchema()

print("Status: Success")

핵심 RetroTech의 사례를 통해 전자상거래의 AI 기반 검색 기법을 탐구하고, 제품 및 사용자 신호 데이터셋 설정을 통해 검색 엔진에 데이터를 로드하여 검색 가능하도록 Spark를 활용하여 CSV 파일을 Solr로 저장하여 데이터 인덱싱.

이미지 및 상품 메타 정보를 활용한 패션 상품 검색

-

이미지 및 메타 정보 활용 패션 상품 검색에서 이미지는 중요한 역할을 하며, 메타 정보(e.g., 색상, 크기, 브랜드 등)와 결합하여 검색 정확도를 높임.

- 모델 활용 예시

- 인풋 패션 이미지 및 메타 정보

- 모델 CNN(Convolutional Neural Networks) 기반의 이미지 인식 모델

- 아웃풋 유사한 패션 아이템 추천

- 적용 방법 이미지 기반 검색에서는 CNN을 활용하여 이미지의 피쳐을 추출하고, 메타 정보와 결합하여 사용자의 검색 의도에 부합하는 결과를 제공.

핵심 패션 상품 검색에서 이미지는 중요한 요소로, 메타 정보와 결합하여 검색 정확도를 향상시킴. CNN 모델을 활용하여 이미지 피쳐을 추출하고, 사용자에게 적합한 패션 아이템을 추천 가능.

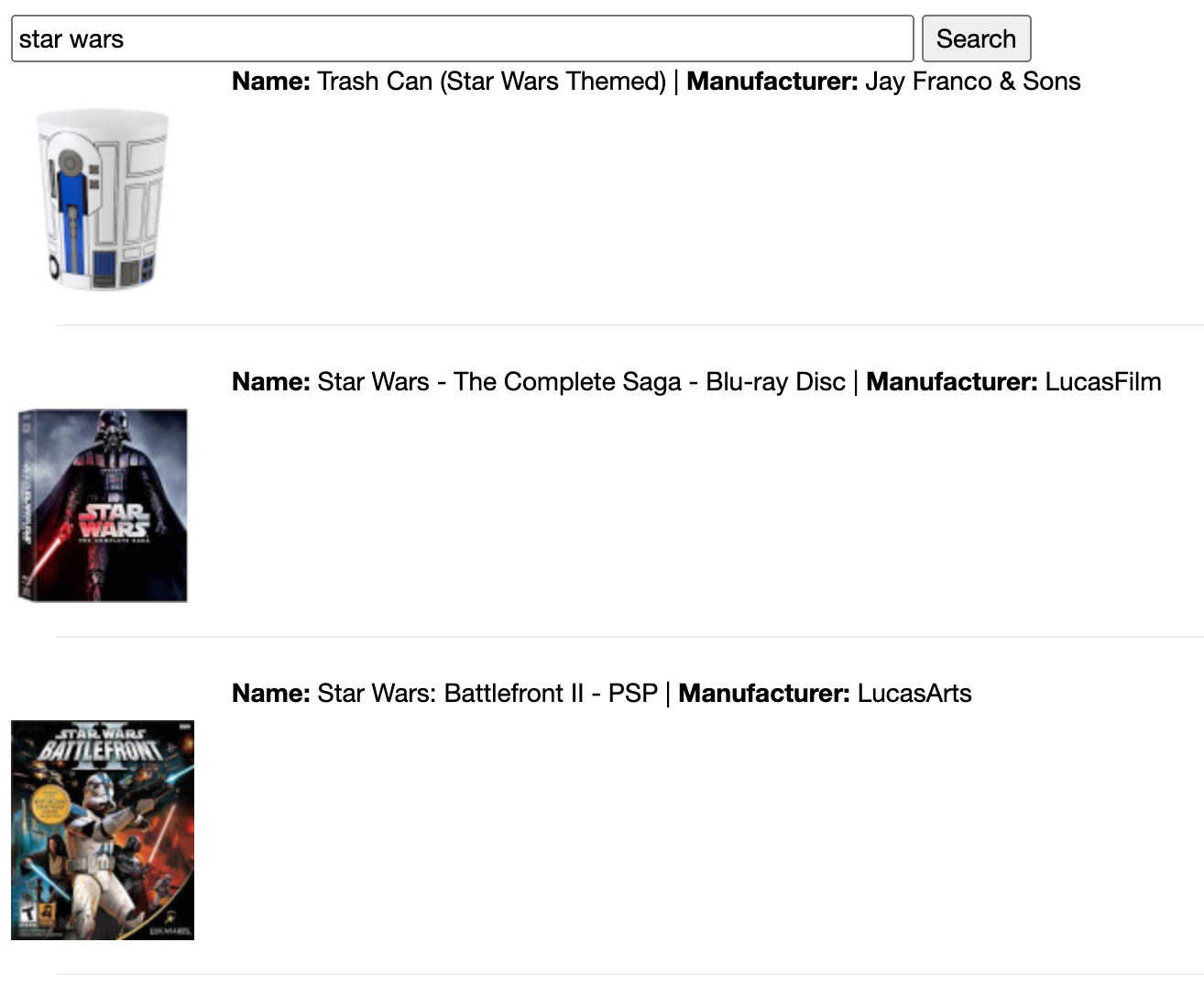

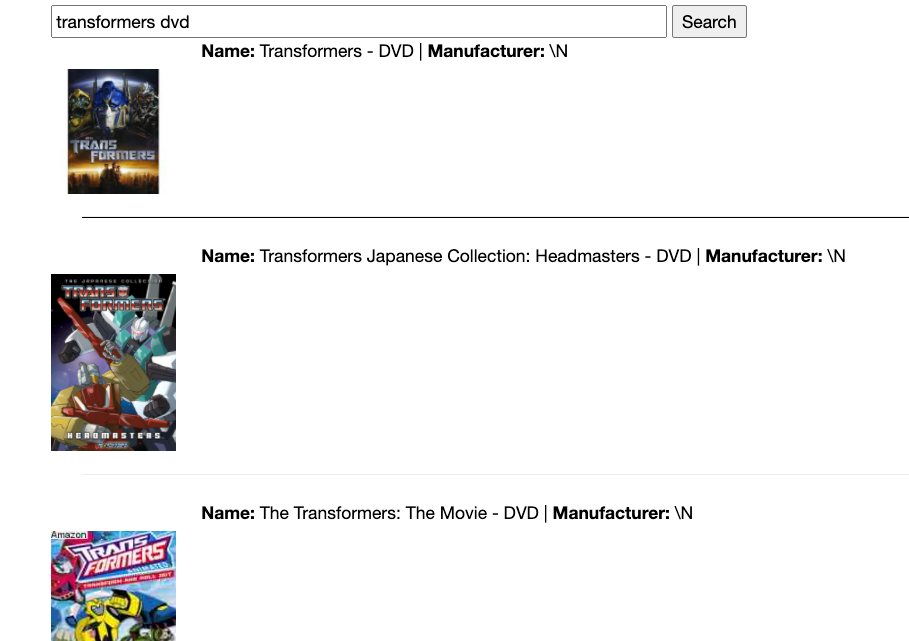

p.100: Indexing and Searching Product Catalog

- Indexing Process

- ‘products’ 컬렉션 초기화 → 성공

- ‘upc’, ‘name’, ‘longDescription’, ‘manufacturer’ 필드 추가 → 성공

- 제품 데이터 로딩 → 성공

- 제품 스키마

root |-- upc: long (nullable = true) |-- name: string (nullable = true) |-- manufacturer: string (nullable = true) |-- shortDescription: string (nullable = true) |-- longDescription: string (nullable = true)

- 검색 예시: ipod

- request

{ "query": "ipod", "fields": ["upc", "name", "manufacturer", "score"], "limit": 5, "params": { "qf": "name manufacturer longDescription", "defType": "edismax", "sort": "score desc, upc asc" } } - 결과: 검색은 성공적으로 수행되었으나, 결과의 연관성은 낮음

- request

- 핵심

제품 컬렉션이 성공적으로 색인되어 기본적인 키워드 검색이 가능해짐. 그러나 검색 결과의 품질은 아직 개선이 필요 이를 기반으로 AI 기반 검색 기능을 추가할 예정임.

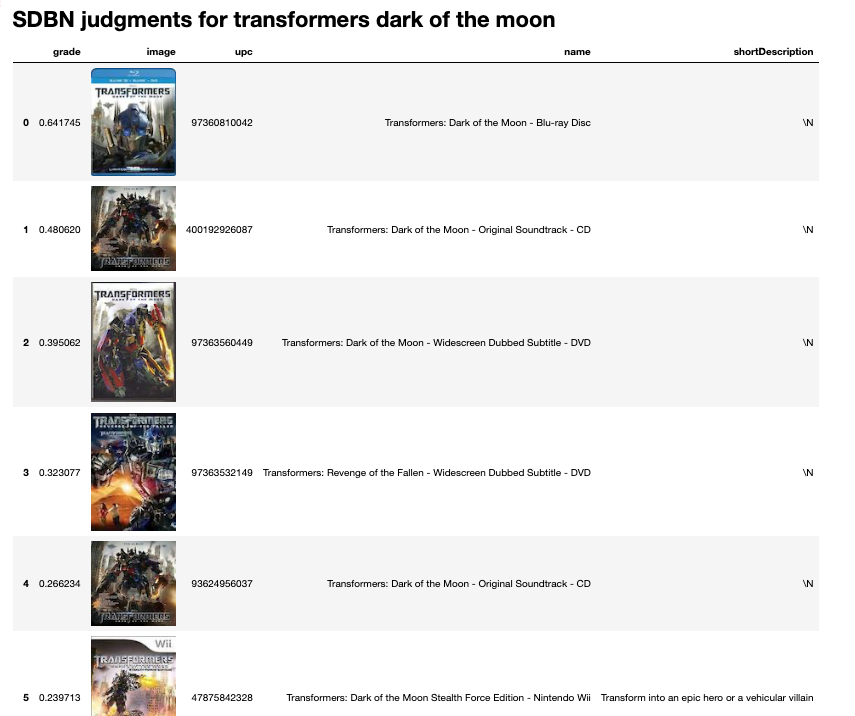

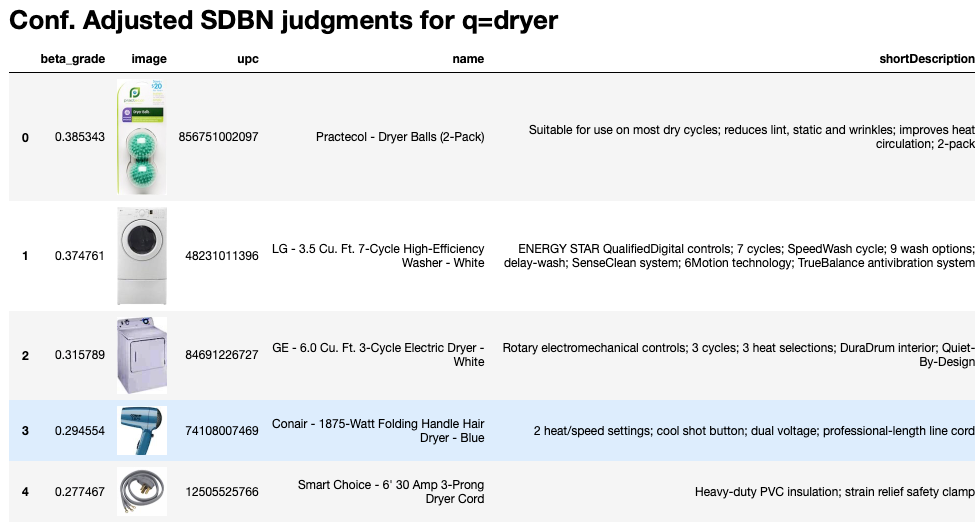

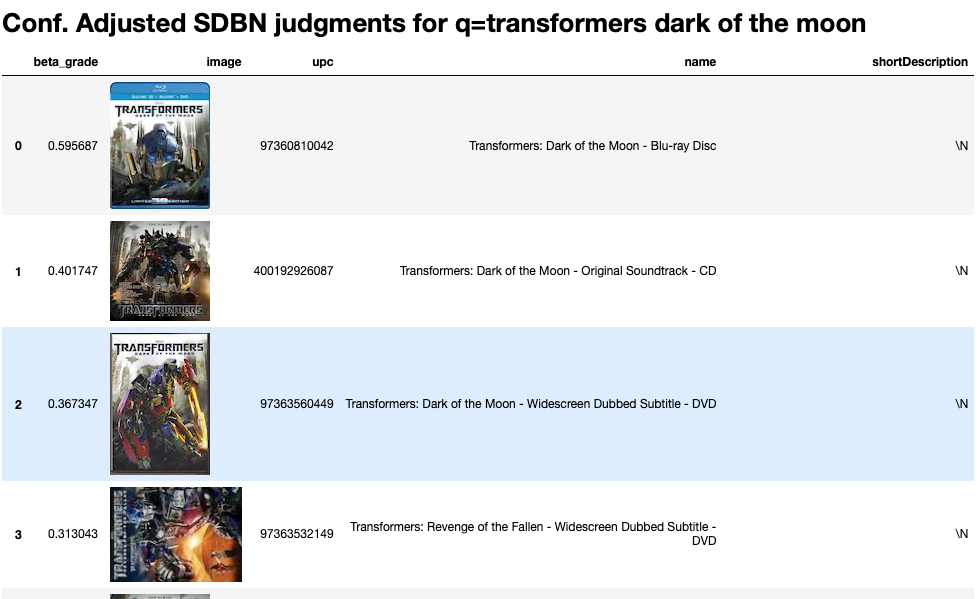

p.101: 제품 검색 결과

-

Figure 4.1 설명

‘ipod’를 검색한 결과가 화면에 나타남. 제품 카탈로그가 색인되어 있으며, 검색 쿼리에 대한 결과를 반환 -

향후 계획

- AI 기반 검색 기능 도입 예정

- 신호 데이터 활용 시작

p.102: 신호 데이터 로딩 및 구조

- 신호 데이터 로딩 절차

- 신호 컬렉션 생성 및 초기화 → 성공

- CSV 파일에서 데이터 로드 및 Solr 저장 → 성공

- 신호 스키마

root |-- query_id: string (nullable = true) |-- user: string (nullable = true) |-- type: string (nullable = true) |-- target: string (nullable = true) |-- signal_time: timestamp (nullable = true)

- 핵심

실사용자 데이터가 없는 환경에서 생성한 신호 데이터셋 활용 가능. 신호 데이터를 실시간 검색 시나리오와 외부 처리에 활용할 수 있도록 구조화. 다양한 신호의 속성을 기록하여 분석에 활용할 예정.

p.103: 신호 데이터의 예시와 구조

- 신호 데이터의 구조

- ‘query_id’: 쿼리 신호의 고유 ID

- ‘user’: 특정 사용자를 나타내는 식별자

- ‘type’: 신호의 유형 (query, click, purchase 등)

- ‘target’: 신호가 적용된 콘텐츠

- ‘signal_time’: 신호 발생 일시

- 사용자 행동 시퀀스와 신호 예시

- ‘ipad’ 검색 → ‘doc1’, ‘doc2’, ‘doc3’ 반환

- ‘doc1’ 클릭 후 ‘doc3’ 클릭

- ‘doc3’ 장바구니에 추가

- ‘ipad cover’ 검색 → ‘doc4’, ‘doc5’ 반환

- ‘doc4’ 클릭 및 장바구니 추가

- ‘doc3’, ‘doc4’ 구매

- 핵심

다양한 사용자 행동이 신호 데이터로 기록되며, 이는 검색 결과의 개선에 활용되며, 신호 데이터는 유연하게 구조화되어 있어 다양한 분석에 적용 가능.

응용 예시: 패션 상품 검색

- 이미지 및 상품 메타 정보를 기반으로 한 검색에는 신호 데이터를 활용하여 사용자 선호도를 반영한 추천 시스템 구축 가능.

- 예를 들어, 사용자가 특정 브랜드의 제품을 자주 클릭하는 경우 해당 브랜드의 신상품을 우선적으로 노출하는 방식으로 활용 가능.

사용자 신호와 Reflected Intelligence: AI 기반 검색 엔진의 고도화

사용자 신호의 구조와 수집

- 신호 유형 분류:

query,results신호는 각각 별도의 신호로 분리 구성- → 쿼리와 결과가 동시에 발생하지만, 테이블 구조 일관성을 유지하기 위함

- → “next page” 링크 클릭 시 추가 신호를 시간별로 추가 가능

- 신호 구조:

query_id는 사용자 쿼리의 특정 시간 인스턴스를 식별- → 동일 쿼리 키워드라도 결과가 시간에 따라 다르므로 사용자의 반응 분석 가능

- 결과 신호의 정렬:

results신호는 문서의 순서를 유지하는 정렬된 리스트- → 검색 결과의 순서가 일부 알고리즘에서 관련성을 측정하는 데 중요

- 구매 신호 분리: 각 항목별로 별도의

purchase신호 생성- → 서로 다른 쿼리에서 유래한 구매 항목을 추적하기 위한 목적

TL;DR

- 사용자 신호는 쿼리의 결과와 사용자의 상호작용을 상세히 추적할 수 있도록 구조화됨.

query_id와 신호의 순서를 통해 사용자의 쿼리 반응 분석 및 결과 정렬 가능.- 신호를 기반으로 사용자 상호작용 패턴을 학습하고, 검색 결과의 관련성을 개선 가능한 구조 제공.

사용자, 세션, 요청 모델링

- 사용자 식별 계층: 사용자 식별 정보의 중요도에 따른 계층적 구조

- →

User ID,Device ID,Browser ID,Session ID,Request ID - → 가능한 가장 높은 수준의 식별자에 사용자를 연결하는 것이 목표

- →

- 식별자 간의 관계:

Browser ID→ 여러Session ID포함 가능Session ID→ 여러Request ID포함 가능

- 쿠키의 역할: 브라우저 쿠키를 통해 신호를 식별하고 세션 및 요청 간의 연결 유지

TL;DR

- 사용자 식별 계층을 통해 다양한 수준의 사용자 데이터 추적 가능

- 식별자의 지속성을 유지하여 사용자 상호작용 패턴을 학습하고 분석

- 브라우저 쿠키는 식별자 간의 지속적 연결을 위한 핵심 매개체 역할

Reflected Intelligence의 도입

- Reflected Intelligence 개념: 사용자 상호작용 신호를 통한 피드백 루프 생성

- → 지속적 학습과 개선을 통해 검색 엔진의 관련성 향상

- 신호 처리 및 학습: 사용자 쿼리 및 상호작용 신호를 학습하여 관련성 모델 생성

- → 유명한 결과 부스트, 사용자 맞춤형 결과 제공

- → 일반 문서 속성 학습 및 순위 알고리즘 조정

- 자동화된 학습 시스템: 새로운 사용자 상호작용으로 개선된 검색 결과를 생성

- → 사용자의 관심사 및 컨텐츠 변화에 따른 자동 조정

TL;DR

- Reflected Intelligence는 사용자 상호작용을 통한 지속적 학습과 검색 결과 개선을 목표로

- 학습된 관련성 모델은 사용자 쿼리에 대한 더 나은 검색 결과 제공 가능.

- 지속적 피드백 루프를 통해 검색 시스템은 시간이 지남에 따라 자동으로 스마트해짐.

예시: 패션 상품 검색에의 응용

- 이미지 및 상품 메타 정보를 통한 검색: 이미지에서 색상, 스타일, 패턴 등의 속성을 추출하여 검색

- → 인풋: 사용자 업로드 이미지 또는 선택한 스타일 속성

- → 아웃풋: 유사한 스타일의 패션 상품 리스트

- 모델 활용: CNN(Convolutional Neural Network) 등을 통해 이미지 피쳐 추출

- → 사용자 선호도를 기반으로 결과를 개인화하고 관련성 높은 상품 추천

이미지 설명

- Figure 4.2 Reflected Intelligence Process:

- 사용자 쿼리 입력 → 결과 확인 및 상호작용 → 신호 처리 및 학습 모델 생성 → 향후 검색 결과 개선

이와 같은 방법의 적용은 AI 기반 검색 엔진의 효율성을 극대화하고, 사용자 경험의 향상에 기여 Reflected Intelligence는 검색 시스템의 지속적인 최적화를 가능케

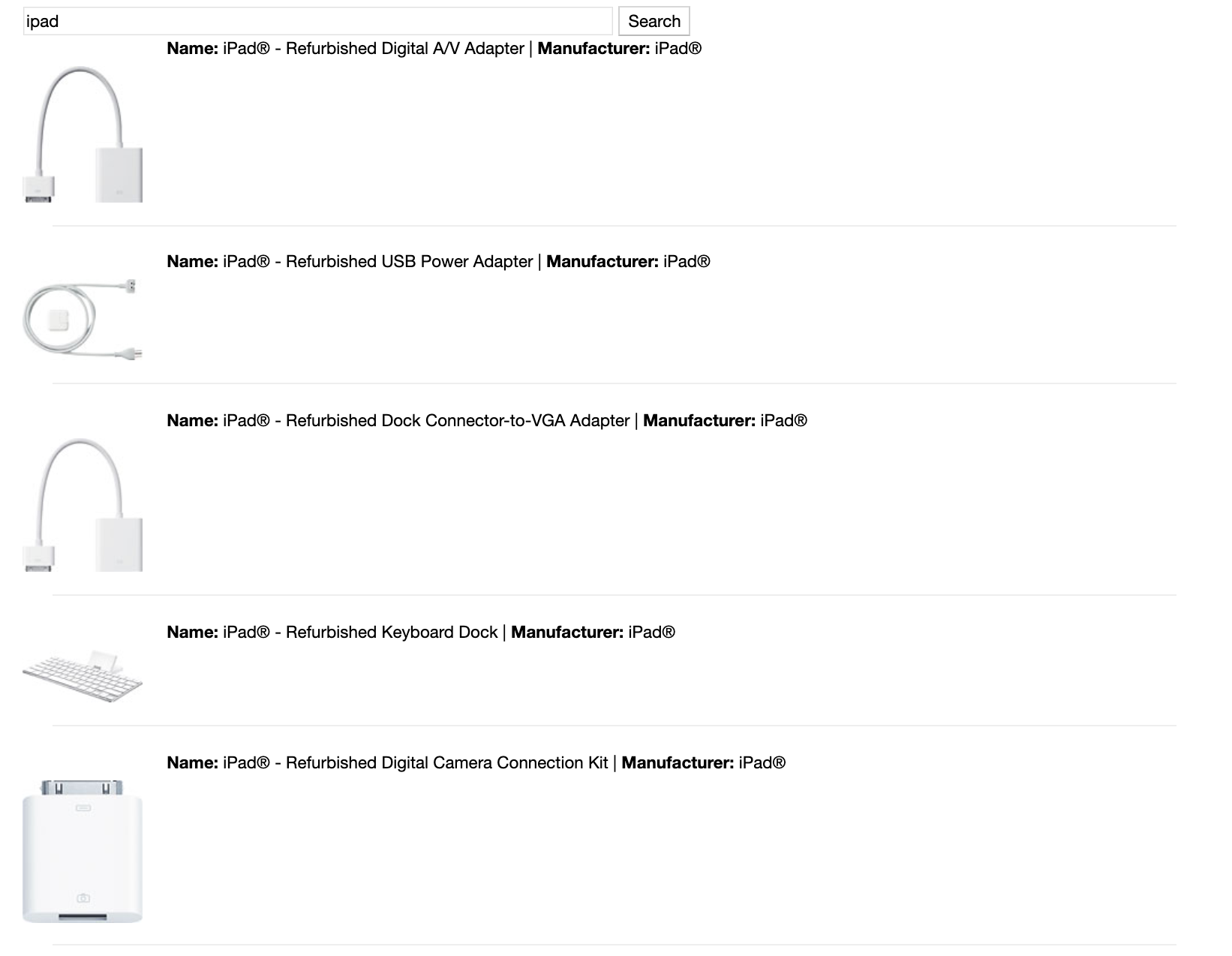

4.2.2 Signals Boosting을 통한 인기 관련성 향상

Signals Boosting 모델 개요

- Signals Boosting 가장 간단하면서도 검색 쿼리의 관련성을 향상시키는 데 효과적인 방법.

- 유명한 쿼리는 더 많은 신호를 생성함

- 이런 신호를 활용해 관련성을 개선하는 모델 학습 가능

Signals Boosting 작동 방식

- 쿼리 입력 사용자가 검색 엔진에 쿼리를 입력.

- 예시: “ipad”라는 쿼리를 검색 엔진에 입력

- 관련 이미지:

- 설명: 여러 번 언급된 키워드가 높은 순위로 반환됨. 그러나 사용자가 의도한 주요 제품보다는 키워드가 자주 언급된 액세서리가 더 높은 순위로 나타날 수 있음.

- Aggregate User Behavior 유명한 쿼리에서 사용자 행동을 집계하여 최적의 제품을 자동으로 학습하고 반환.

- 피드백 루프: 사용자 상호작용 정보를 수집하여 신호 부스팅 모델 업데이트

- 관련 이미지:

- 설명: 사용자의 검색이 기록되고, 신호 부스팅 모델이 적용되어 부스팅된 결과 반환. 사용자 상호작용 후 신호를 집계하여 신호 부스팅 모델 업데이트.

Signals Boosting 모델 구현

- 신호 집계

- 신호를 집계하여 쿼리 또는 문서에 부스트 추가

- Sidecar Collection 활용: 기본 컬렉션과 함께 유용한 데이터 저장

select q.target as query, c.target as doc, count(c.target) as boost

from signals c left join signals q on c.query_id = q.query_id

where c.type = 'click' AND q.type = 'query'

group by query, doc

order by boost desc

- 신호 부스팅 모델 생성

TL;DR

- Signals Boosting은 인기 쿼리에서 생성된 사용자 신호를 활용하여 검색 관련성을 향상시킴.

- 피드백 루프를 통해 사용자 상호작용을 지속적으로 반영하여 모델을 업데이트

- Sidecar Collection을 사용하여 신호를 집계하고 부스트를 추가하여 검색 결과를 최적화

패션 상품 검색에의 적용 예시

- 이미지 및 상품 메타 정보 기반 검색 이미지와 메타 데이터를 활용해 신호를 수집하고 부스팅 모델에 적용

- 인풋: 이미지 데이터, 상품 설명, 사용자 검색 쿼리

- 아웃풋: 관련성 높은 패션 아이템 추천

- 모델 활용 Fashion-MNIST 데이터셋을 이용한 CNN 모델 적용

- 인풋: 패션 아이템 이미지

- 아웃풋: 유사한 패션 아이템 추천

p112

Listing 4.7: Signals Boosting Query 생성하기

- Boost Documents

- 주요 작업: 문서의 검색 순위를 개선하기 위해 Signals Boosting Query를 생성

- 예시: 특정 쿼리 “ipad”에 대해 Signals Boosting을 적용하여 더 관련성 높은 검색 결과를 얻음.

- Boost Query

query = "ipad" signals_boosts_query = { "query": query, "fields": ["doc", "boost"], "limit": 10, "params": { "defType": "edismax", "qf": "query", "sort": "boost desc" } } signals_boosts = requests.POST(solr_url + signals_boosting_collection + "/select", json=signals_boosts_query).json()["response"]["docs"] print("Boost Documents: \n") print(signals_boosts)- 과정 설명

query변수에 “ipad”를 설정- Solr 쿼리 파라미터를 설정하여 Signals Boosting을 사용할 문서 리스트를 가져옴.

- 부스트 값에 따라 정렬된 결과를 반환

- 과정 설명

- Boost Query 생성

product_boosts = "" for entry in signals_boosts: if len(product_boosts) > 0product_boosts += " " product_boosts += '"' + entry['doc'] + '"^' + str(entry['boost']) print("\nBoost Query: \n" + product_boosts)- 과정 설명

signals_boosts리스트에서 각 문서에 대해 부스트 쿼리를 생성.- 문서 ID와 부스트 값을 결합하여 새로운 쿼리를 생성

- 과정 설명

- 최종 검색 요청

collection = "products" request = { "query": query, "fields": ["upc", "name", "manufacturer", "score"], "limit": 5, "params": { "qf": "name manufacturer longDescription", "defType": "edismax", "indent": "true", "sort": "score desc, upc asc", "boost": "sum(1,query({! df=upc v=$signals_boosting}))", "signals_boosting": product_boosts } } search_results = requests.POST(solr_url + collection + "/select", json=request) .json()["response"]["docs"] display(HTML(render_search_results(query, search_results)))- 과정 설명

- 최종적으로 생성된 부스트 쿼리를 검색 요청에 포함하여 Solr에 전달

- 검색 결과를 렌더링하여 사용자에게 표시

- 과정 설명

- 예시 결과

- 부스트 값이 높은 순서대로 문서 리스트가 반환됨.

[{'doc': '885909457588', 'boost': 966}, {'doc': '885909457595', 'boost': 205}, {'doc': '885909471812', 'boost': 202}, {'doc': '886111287055', 'boost': 109}, {'doc': '843404073153', 'boost': 73}, {'doc': '635753493559', 'boost': 62}, {'doc': '885909457601', 'boost': 62}, {'doc': '885909472376', 'boost': 61}, {'doc': '610839379408', 'boost': 29}, {'doc': '884962753071', 'boost': 28}]

- 부스트 값이 높은 순서대로 문서 리스트가 반환됨.

p113

- Signals Boosting Query의 주요 기능

- 문서 정렬 부스트 값에 따라 정렬된 문서를 조회하여 검색 엔진에 전달

- 검색 엔진 전달 부스트 쿼리를 검색 엔진에 전달하여 관련성을 개선

- Boosting 파라미터

"boost": "sum(1,query({! df=upc v=$signals_boosting}))"- 설명: UPC 필드를 기준으로 부스트 쿼리를 적용하여 검색 결과의 관련성을 높임.

"signals_boosting": product_boosts- 설명:

product_boosts는 부스트 쿼리를 생성한 리스트로, 검색 엔진에 전달됨.

- 설명:

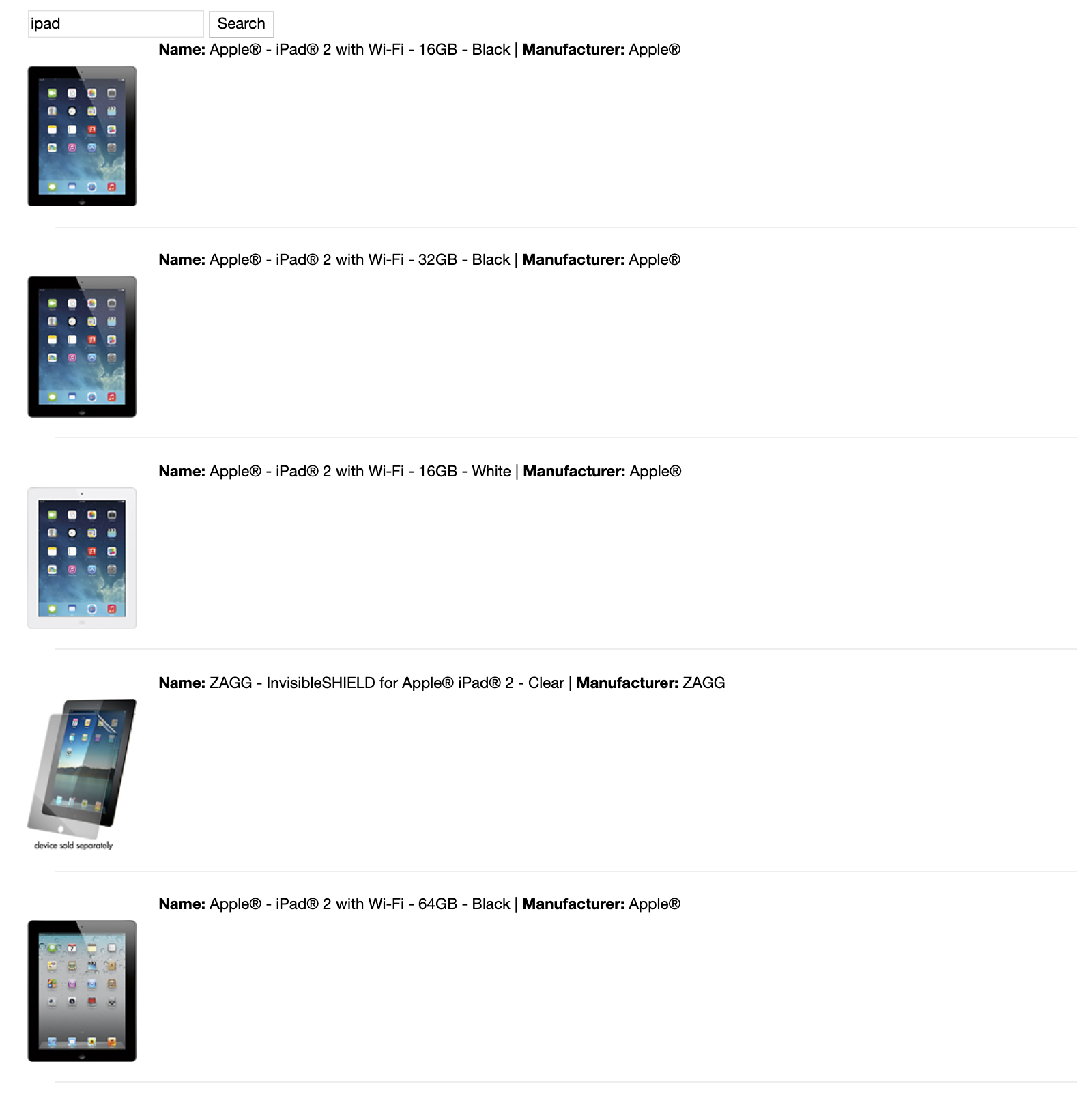

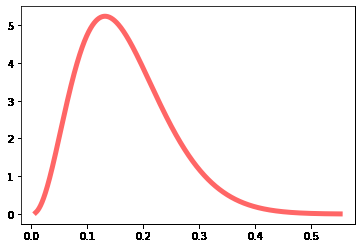

- 결과 분석

- 초기의 키워드 검색이 iPad 액세서리에 집중되었으나, Signals Boosting 적용 후 실제 iPad 기기가 검색됨.

- Figure 4.5는 Signals Boosting이 적용된 새로운 결과를 보여줌.

p114

- Figure 4.5 설명

- Signals Boosting이 활성화된 검색 결과를 시각화

- 사용자들이 실제로 상호작용한 문서를 기반으로 크라우드소싱된 결과를 보여줌.

- 결과 개선 효과

- Signals Boosting 적용 후, 사용자 의도에 맞춘 검색 결과 제공.

- 대중적인 쿼리에 대해 높은 신뢰성을 바탕으로 한 크라우드소싱 접근 방식을 적용

- 그러나 유명한 제품에서 멀어질수록 Signals Boosting의 효과는 감소할 수 있음.

p115

- 목표 Signals Boosting을 통한 초기 구현 사례를 기반으로 한 end-to-end Reflected Intelligence 모델 설명.

- 고려사항

- 쿼리 시간 또는 문서 기반 부스트 선택하고,

- 새로운 신호의 가중치를 높이는 방법임

- 악의적인 사용자의 잘못된 신호 방지하고

- 다양한 출처의 신호 결합할 수 있는 방법임

- 다른 모델 소개

- Collaborative Filtering

- “개인화된 관련성”을 목표로

- 기존 사용자의 선호도를 기반으로 다른 사용자의 선호도를 예측

- 추천 엔진에서 널리 사용되는 알고리즘으로, “이 아이템을 좋아한 사용자는 다른 아이템도 좋아했습니다”와 같은 추천 리스트 생성.

- Figure 4.6은 Signals Boosting 모델에서 보았던 Reflected Intelligence 피드백 루프와 유사

- Collaborative Filtering

- 핵심

- Signals Boosting은 문서와 쿼리의 관련성을 높이기 위한 기법으로,

- 부스트 쿼리는 검색 엔진의 결과 정렬을 개선

- Collaborative Filtering은 사용자 개인화에 초점을 맞춤

이 가이드를 통해 Signals Boosting 및 Collaborative Filtering을 활용하여 검색 관련성을 어떻게 개선할 수 있는지 이해할 수 있음. 이런 기법들은 검색 엔진의 성능을 높이는 데 중요한 역할을 하며, 사용자 경험을 크게 개선 다음 장에서는 이런 기법들의 심화된 내용을 다룰 예정임.

1. Collaborative Filtering 개요

Figure 4.6 사용자-아이템 추천을 위한 Collaborative Filtering. 사용자는 과거 행동을 기반으로 다른 사용자가 좋아했던 아이템을 추천받음. 이때, 다른 사용자들도 동일한 아이템과 상호작용

- Collaborative Filtering 신호 수집 → 모델 구축 → 관련 매치 생성 → 결과 로그 기록의 반복적 피드백 루프 사용

- 사용자와 아이템 간의 상호작용을 신호로 기록

- 사용자-아이템 상호작용 행렬 생성

- 각 사용자와 아이템 간의 관계 강도는 긍정적 상호작용(클릭, 구매, 평점 등)에 기초함

1.1 행렬 요인의 활용

- 행렬 팩토라이제이션(Matrix Factorization) 사용자-아이템 상호작용 행렬을 두 개의 행렬로 분해

- 사용자와 잠재 “요인” 간의 매핑

- 잠재 요인과 아이템 간의 매핑

- 차원 축소를 통한 의미 매칭 가능

- 잠재 요인(Latent Factors) 문서의 공유 관심사를 나타내는 속성

- 유사 문서 매칭: 사용자 관심사를 군중 소싱으로 탐색

1.2 Collaborative Filtering의 한계

- Cold Start Problem 새로운 문서가 신호를 생성하지 못해 표시되지 않는 문제

- 유명한 문서만 더욱 부각되어 다양성 감소

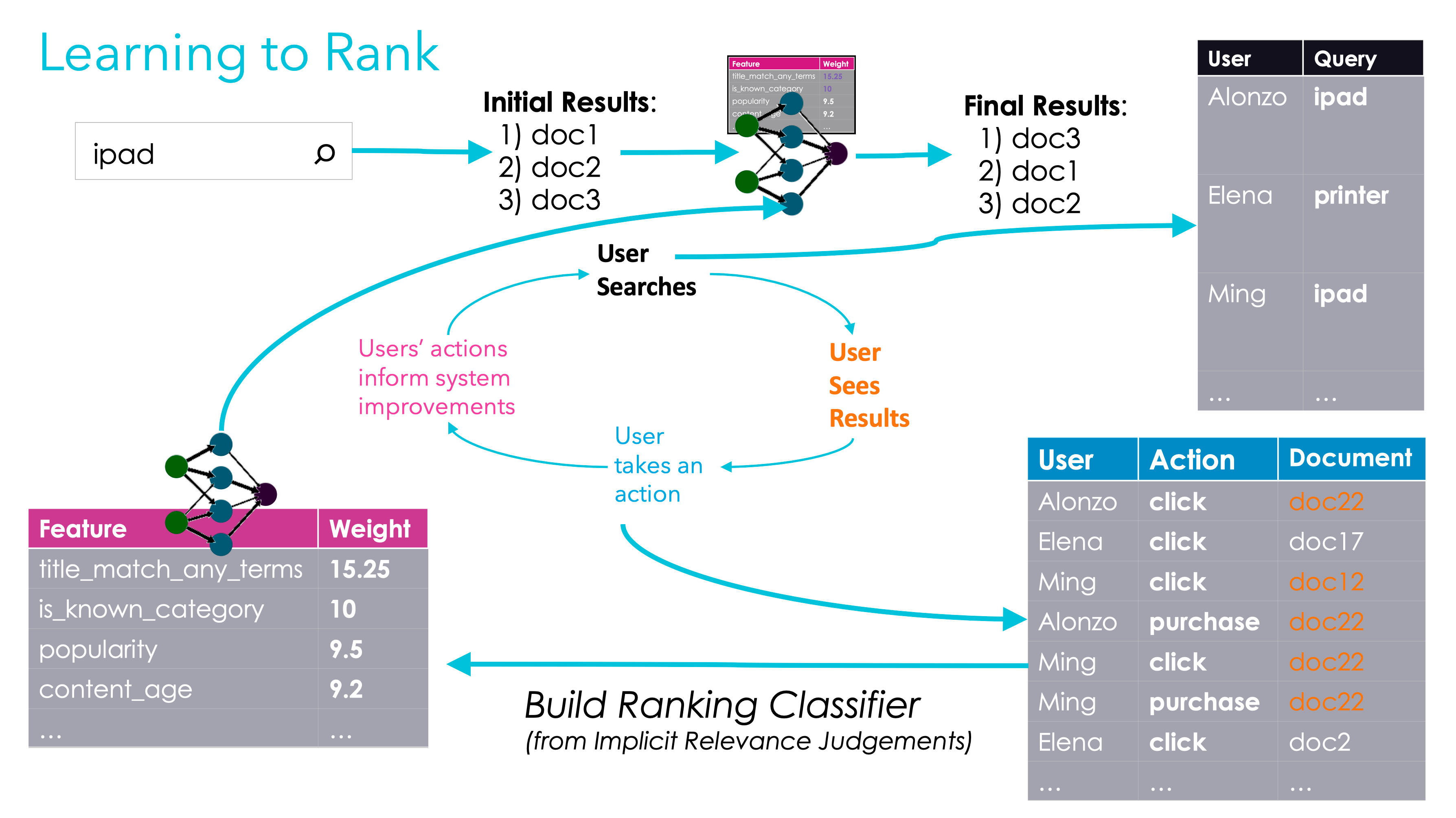

2. Learning to Rank 개요

Figure 4.7 Learning to Rank의 일반화된 흐름. 사용자 판단을 기반으로 랭킹 분류기를 구축하여 검색 결과 재정렬.

- Learning to Rank 문서와 쿼리의 매칭 점수를 부여하는 랭킹 분류기 생성

- 수동 조정 없이 중요 피처 학습

- 다양한 쿼리에 일반적으로 적용 가능한 모델 구축

2.1 Learning to Rank의 프로세스

- 랭킹 분류기의 구축 사용자 판단 목록을 기반으로 모델 학습

- 모델의 피처 예시: 제목 일치, 카테고리 인식, 인기도, 문서 나이 등

- 검색 엔진에 배포하여 결과 향상

- 실시간 유저 플로우 초기 검색 결과 → 랭킹 분류기 적용 → 최종 결과 재정렬

- 초기 빠른 랭킹 함수(BM25 등)로 상위 문서 선택 후, 랭킹 분류기로 재정렬

2.2 Learning to Rank의 Pros(+)

- 명시적/암시적 판단 활용 가능 전문가의 명시적 판단 또는 사용자 신호에서 추출된 암시적 판단

- 다양한 방식으로 training dataset 생성 가능

3. 핵심

- Collaborative Filtering은 사용자 행동 데이터를 기반으로 추천 시스템을 구축하며, cold start 문제를 가짐.

- Learning to Rank는 문서와 쿼리의 중요 피처를 학습하여 검색 결과를 최적화하는 모델을 구축

- 두 방법 모두 사용자의 상호작용 데이터를 활용하여 문서의 관련성을 평가하고, 검색 경험을 향상시킴.

4. 패션 상품 검색 예시

- 이미지와 상품 메타 정보를 활용한 추천 시스템 Collaborative Filtering과 Learning to Rank를 결합하여 구현 가능

- 인풋: 사용자 행동 데이터(클릭, 구매), 이미지 데이터

- 아웃풋: 사용자 취향에 맞는 패션 상품 추천

- 모델 적용 이미지 피쳐 추출 후, Collaborative Filtering으로 유사 사용자 기반 추천 및 Learning to Rank로 최적화된 검색 순위 제공

Collaborative Filtering과 Learning to Rank의 이론적 배경과 활용 방법을 상세히 설명하며, 패션 상품 검색에의 적용 가능성을 제시

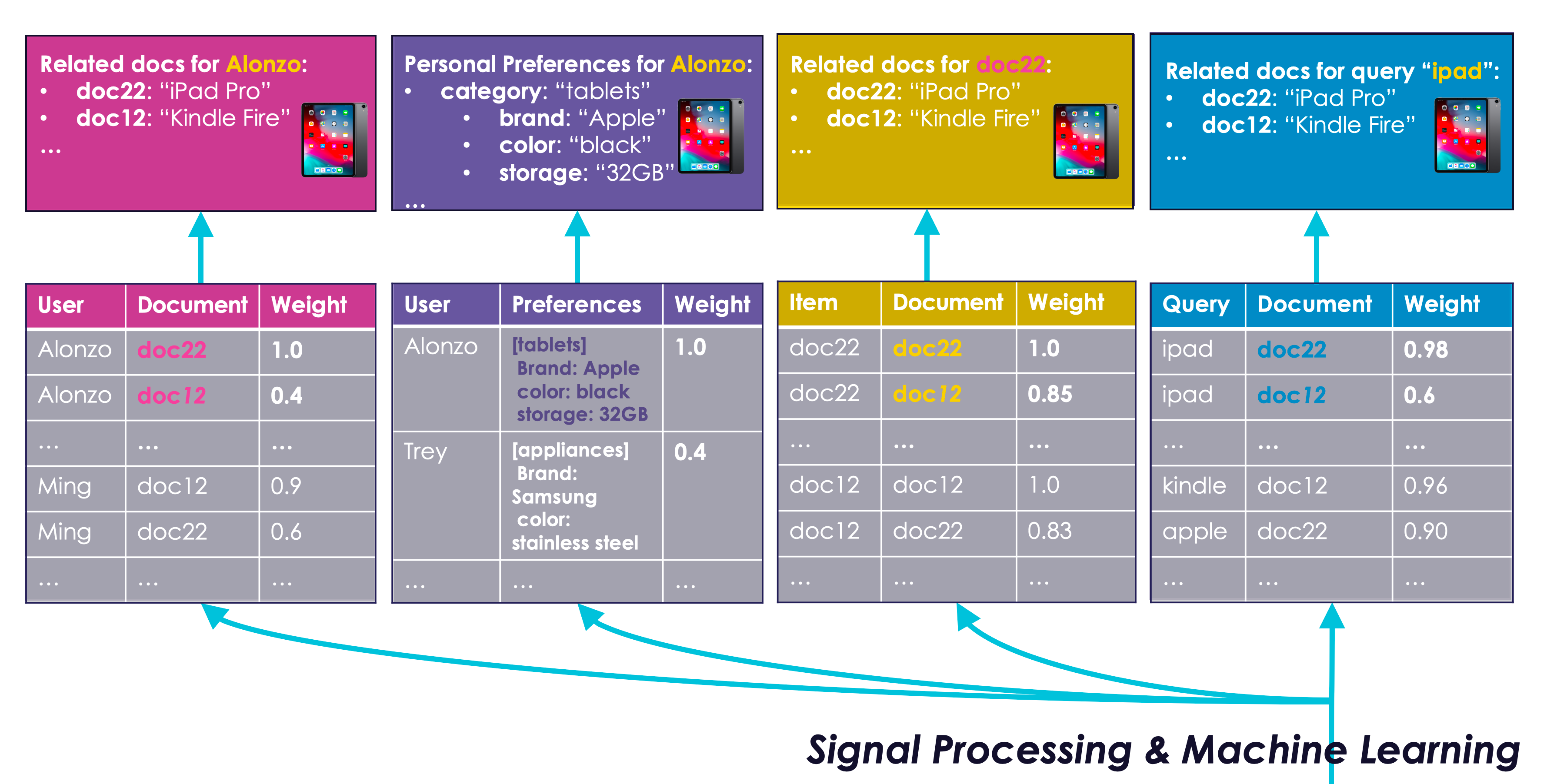

Reflected Intelligence and Knowledge Graphs

p.120

Figure 4.8: 다양한 Reflected Intelligence 모델

- 첫 번째 박스 사용자와 아이템 간 유사성을 추천을 위해 학습

- 두 번째 박스 사용자 프로필을 위한 특정 속성 기반 선호도 학습

- 세 번째 박스 아이템 간 유사성을 추천을 위해 학습

- 네 번째 박스 쿼리-아이템 추천을 위한 학습

Reflected Intelligence의 개념

- Reflected Intelligence 사용자로부터 학습하고 그 학습된 내용을 반영하는 과정

- 신호 부스팅, 협업 필터링, Learning to Rank 기술에 국한되지 않음

- 콘텐츠 기반의 Reflected Intelligence 도출 가능

Crowdsourcing의 역할

- 내재적 피드백 사용자 신호를 통해 군중 지성 도출 가능

- 컨텐츠 기반 Crowdsourcing AI 기반 검색 플랫폼에서 활용

예시

- 문서 품질 평가 고객 리뷰 활용

- 감정 분석 알고리즘 긍정, 중립, 부정적 감정을 파악

- 문서 부스팅/패널티 감정 분석 결과에 따라 문서의 중요도 조정

p.121

알고리즘과 신호의 중요성

- Page Rank 알고리즘 구글의 성공 요인 중 하나

- 텍스트 외의 웹 페이지 크리에이터 행동 분석

- 링크 측정 고품질 웹사이트로의 링크를 통해 ‘품질’ 측정

정보 활용의 중요성

- 외부 콘텐츠와의 관계 직접 사용자 상호작용, 포럼의 댓글과 피드백, 웹사이트 간 링크 활용

- 지식 그래프 링크 간의 관계 학습을 통해 도메인 이해 자동화

p.122

AI-기반 검색 엔진의 연료

- 신호와 콘텐츠 AI 검색 엔진을 구동하는 주요 요소

- 신호 부스팅 대중성 있는 관련성 제공

- 협업 필터링 개인화된 관련성 제공

- Learning to Rank 일반화된 관련성 제공

- 기타 Reflected Intelligence 콘텐츠 활용 기법 포함

TL;DR

- Reflected Intelligence는 사용자 상호작용을 학습하여 검색 결과의 관련성을 자동으로 증가시킴.

- 신호 부스팅, 협업 필터링, Learning to Rank가 주요 기법이며, 콘텐츠 기반 기법도 존재

- 지식 그래프를 활용하여 문서 간의 관계를 이해하고, 검색 쿼리 확장을 통해 검색 정확도를 향상시킬 수 있음.

p.123

지식 그래프의 활용

- 도메인 특정 용어 해석 콘텐츠 내의 관계를 활용하여 도메인 이해

- 전통적 지식 그래프: 도메인 내 명시적 관계 모델링

- 의미적 지식 그래프: 도메인 내 의미적 관계 실시간 인퍼런스

다양한 데이터셋 활용

- 지식 그래프 구축 및 적용을 통한 쿼리 이해 개선

- 오픈 정보 추출 텍스트로부터 지식 그래프 생성

- 의미적 지식 그래프 활용 쿼리 확장, 문서 추천

결론

- 콘텐츠와 사용자 신호를 활용하여 AI 기반의 높은 관련성 검색 엔진 구축 가능

- 지식 그래프와 의미적 연결을 통해 자동화된 도메인 이해 가능

예시: 패션 상품 검색

- 이미지와 상품 메타 정보 활용 패션 아이템 검색

- 모델 CNN 기반 이미지 인식, NLP 기반 메타 정보 분석

- 인풋 사용자 이미지, 메타 데이터

- 아웃풋 유사 아이템 추천, 사용자 선호도 기반 맞춤 추천

이와 같은 방식으로 Reflected Intelligence와 지식 그래프를 활용하여 다양한 도메인에서의 검색 관련성을 높일 수 있음.

지식 그래프 구축 및 활용에 대한 기술적 접근

1.4 지식 그래프의 기초

-

지식 그래프 개념 도입

→ 지식 그래프는 노드와 엣지를 통해 표현됨

→ 노드는 엔티티(e.g., 용어, 사람, 장소, 개념 등)

→ 엣지는 두 노드 간의 관계를 나타냄

→ Figure 5.1 참고 -

지식 그래프 예시 설명

→ 저자, 연구 논문, 학술 대회, 도시, 국가, 날짜 등의 노드

→ 엣지를 따라 탐색하여 정보 인퍼런스 가능

→ 예: 저자가 2016년 10월 캐나다 몬트리올에 있었음을 인퍼런스

TL;DR

- 지식 그래프는 노드와 엣지로 구성되어 다양한 엔티티와 관계를 표현

- 노드와 엣지를 따라 탐색하여 새로운 정보를 인퍼런스 가능

- 지식 그래프는 사실적 지식을 표현하며, 이를 통해 다양한 분석과 인퍼런스이 가능

5.1 지식 그래프 활용 방법

- 지식 그래프 구축 방법

- 그래프 데이터베이스로 직접 구축 (Neo4j, ArangoDB 등)

- 기존 지식 그래프 활용 (ConceptNet, DBPedia 등)

- 데이터로부터 자동 생성하여 지식 추출

- 방법의 장Cons(-)

→ 일반 지식 검색 엔진: 기존 지식 그래프 활용

→ 도메인 특화 검색 엔진: 도메인 특화 엔티티 포함 필요

→ 자동 생성 접근 방식에 중점, 수동 생성 및 기존 그래프 활용은 외부 자료 참고

5.2 명시적 지식 그래프 구축

-

Apache Solr의 활용

→ 명시적 그래프 탐색 기능 내장

→ 외부 시스템 필요 없이 지식 그래프 구현 가능 -

외부 그래프 데이터베이스 사용의 복잡성

→ 요청 조율, 데이터 동기화, 인프라 관리 복잡

→ 검색 엔진에서 일부 그래프 작업의 효율적 수행 가능 -

통합 플랫폼으로서의 검색 엔진

→ 검색 기능과 지식 그래프 기능의 결합으로 시너지 효과 제공

TL;DR

- 명시적 그래프 탐색 기능이 포함된 Apache Solr을 통해 지식 그래프를 효과적으로 구현 가능.

- 외부 그래프 데이터베이스 사용 시 복잡성 증가, 검색 엔진 내 구현이 효율적.

- 검색 엔진을 통합 플랫폼으로 활용하여 검색 및 지식 그래프 기능 결합.

5.3 콘텐츠로부터의 자동 지식 그래프 추출

-

Open Information Extraction의 역할

→ 자연어 처리(NLP)를 통한 텍스트에서의 사실 추출

→ 의존성 그래프 사용: 문장의 구문적 구조 분석 -

임의 관계와 하위 관계 추출

→ 명사와 동사 분석을 통한 RDF 트리플 형성

→ 예: “Colin attends Riverside High School” → (“Colin”, “attends”, “Riverside High School”) -

SpaCy 라이브러리를 통한 예시

→ 자연어 처리 라이브러리로 텍스트 구문 분석 및 관계 추출

→ Listing 5.1에서 Python 코드를 통해 관계 생성

TL;DR

- 자연어 처리를 통해 텍스트에서 관계를 추출하고, RDF 트리플로 표현.

- SpaCy와 같은 NLP 라이브러리로 자동 팩트 추출 가능.

- 명사, 동사 분석을 통해 지식 그래프의 노드와 엣지를 형성하여 관계 파악.

예시: 패션 상품 검색의 적용

-

이미지와 메타정보 기반 검색

→ 이미지 처리 모델을 통해 상품의 특성 추출

→ 메타정보와 결합하여 지식 그래프의 노드 및 엣지 생성

→ 예: 이미지에서 색상, 스타일, 브랜드 정보 추출 → RDF 트리플 형성 -

모델 활용

→ CNN(Convolutional Neural Network)를 통한 이미지 피쳐 추출

→ NLP 모델로 제품 설명 텍스트 처리 및 관계 분석 -

검색 엔진 통합

→ Apache Solr와 같은 플랫폼에 지식 그래프 통합

→ 사용자가 입력한 키워드와 이미지 정보를 기반으로 검색 결과 제공

이와 같이, 지식 그래프를 다양한 방법으로 구축하고 활용함으로써, 정확한 정보 추출 및 검색 서비스를 제공할 수 있음. SpaCy와 같은 NLP 도구를 사용하여 텍스트로부터 직접 정보를 추출하고, 이를 지식 그래프로 통합하여 복합적인 정보 검색이 가능하도록

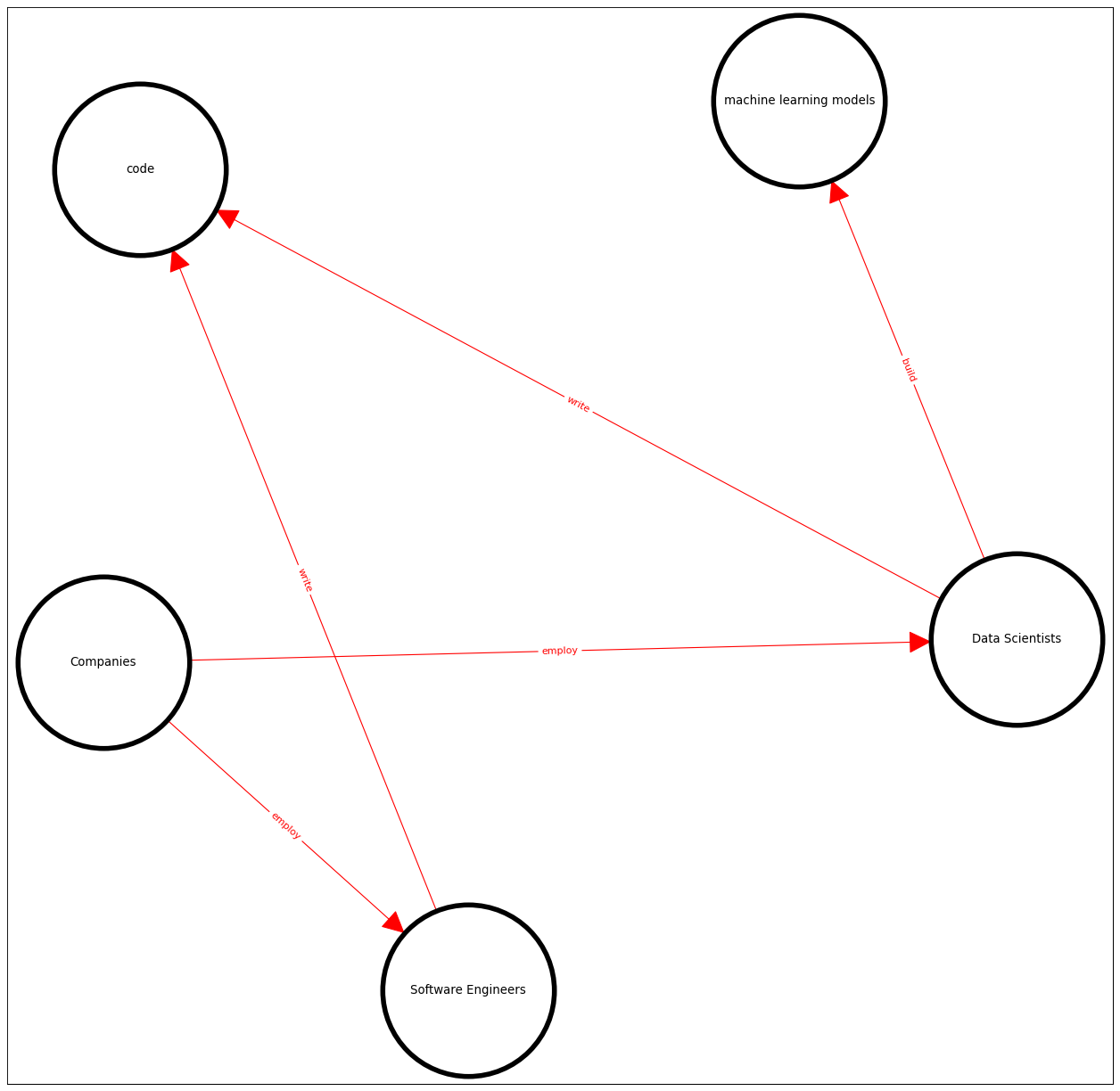

지식 그래프 구축 및 하이퍼님 관계 추출

1. 지식 그래프 구축

- 관계 추출 및 지식 그래프 저장

- 주어/관계/목적어 튜플 저장 → 지식 그래프로 변환 및 탐색 가능

- Figure 5.2 추출된 지식 그래프 시각화

- 설명: 이 그래프의 노드와 엣지는 텍스트 내용에서 품사 패턴에 기반하여 자동 추출됨.

- 추출 메커니즘

- SpaCy 라이브러리 활용: 딥러닝 기반 신경망 언어 모델 사용 → 품사, 구문, 의존성 및 상호참조 탐지

- 파싱 메커니즘: 영어의 알려진 의미 패턴을 따르는 규칙 기반 방법 사용

- 문제점 및 해결책

- 임의의 동사를 관계로 파싱 시 노이즈 발생 가능성

- 동사의 변형, 동의어 및 의미 중첩 → 관계 리스트 정리 필요

2. 하이퍼님 및 하이포님 추출

- 관계 정의

- 하이포님 “is a” 또는 “is instance of” 관계를 유지하는 엔티티

- 하이퍼님 하이포님의 일반화된 형태

- 예시: 필립스 헤드 스크류드라이버(하이포님) → 스크류드라이버(하이퍼님) → 도구(하이퍼님)

- Hearst 패턴 활용

- 하이퍼님/하이포님 관계 추출에 효과적임

- Listing 5.2 Hearst 패턴 예시

simple_hearst_patterns = [ ('(NP_\\w+ (, )?such as (NP_\\w+ ?(, )?(and |or )?)+)', 'first'), ('(such NP_\\w+ (, )?as (NP_\\w+ ?(, )?(and |or )?)+)', 'first'), ('((NP_\\w+ ?(, )?)+(and |or )?other NP_\\w+)', 'last'), ('(NP_\\w+ (, )?include (NP_\\w+ ?(, )?(and |or )?)+)', 'first'), ('(NP_\\w+ (, )?especially (NP_\\w+ ?(, )?(and |or )?)+)', 'first'), ]

3. 하이퍼님 관계 추출 예시

- 패턴 매칭 및 결과

- 문자열 내 패턴 매칭 → 명사구(NP_) 발견 → 하이퍼님/하이포님 관계 추출

- Listing 5.3 Hearst 패턴을 이용한 관계 추출 예시

text_content = """ Many data scientists have skills such as machine learning, python, deep learning, apache spark, or collaborative filtering, among others ... """ h = HearstPatterns() extracted_relationships = h.find_hyponyms(text_content) facts = list() for pair in extracted_relationships: facts.append([pair[0], "is_a", pair[1]]) print(*facts, sep="\n")

- [‘machine learning’, ‘is_a’, ‘skill’]

- [‘python’, ‘is_a’, ‘skill’]

- [‘Google’, ‘is_a’, ‘tech company’]

- [‘San Francisco’, ‘is_a’, ‘big city’]

4. 결과 분석

- 지식 그래프 시각화

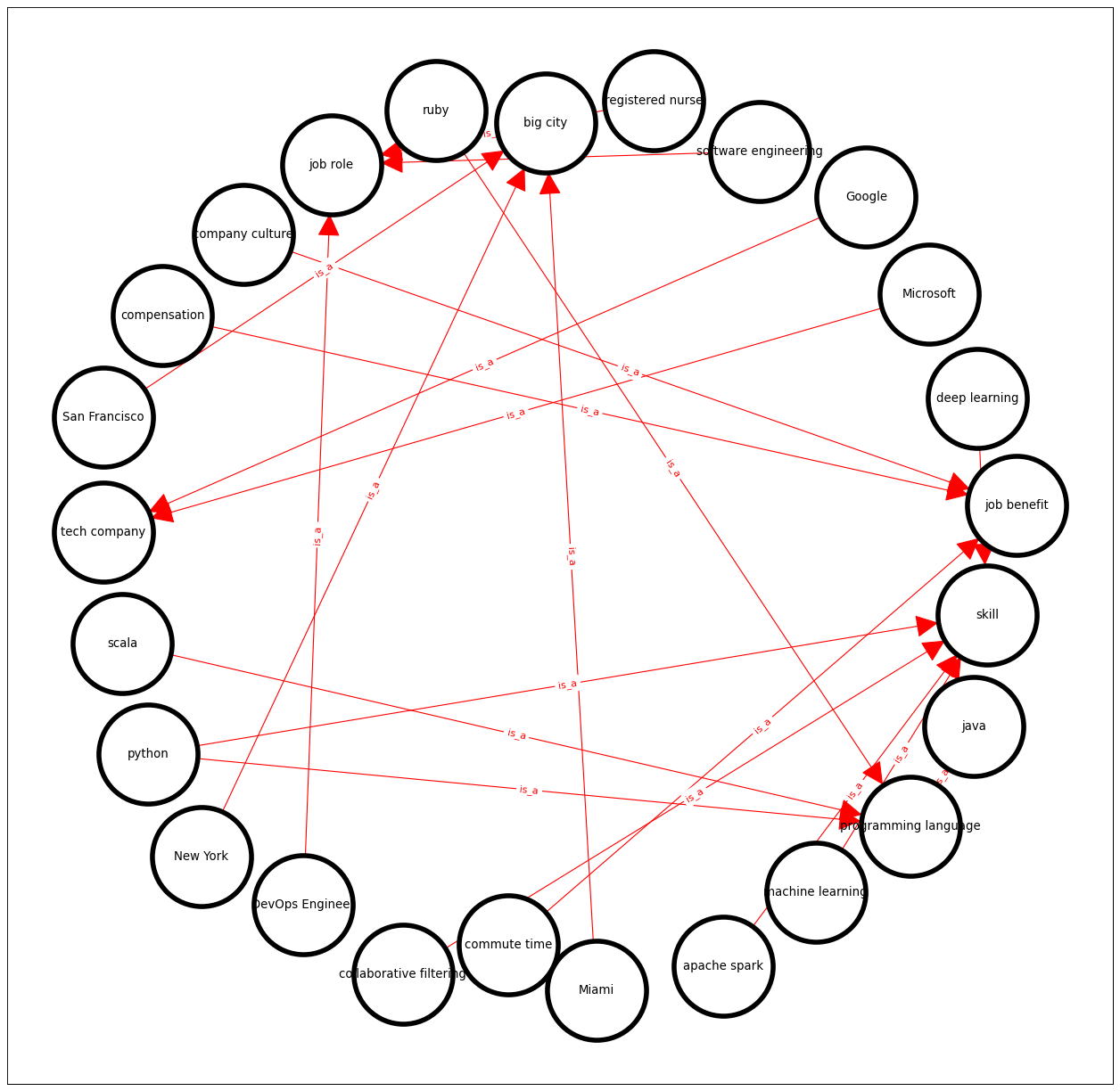

- Figure 5.3 Hearst 패턴을 통해 생성된 지식 그래프

- 설명: 모든 노드가 “is_a” 엣지를 통해 연결됨.

- Figure 5.3 Hearst 패턴을 통해 생성된 지식 그래프

- 노이즈 감소

- 임의의 관계 추출에서 발생한 불일치 및 노이즈 제거

- 유의어, 철자 오류 등의 모호성 해결 가능

핵심

- 주어/관계/목적어 튜플을 이용한 지식 그래프 구축 및 SpaCy 라이브러리를 통한 품사 패턴 탐지.

- Hearst 패턴을 활용한 하이퍼님/하이포님 관계 추출로 노이즈 감소.

- 추출된 관계와 지식 그래프의 시각화를 통해 명확한 관계 구조 제시.

참고 문서 및 링크

- SpaCy 라이브러리 공식 문서

- Hearst 패턴 관련 논문 및 자료

이와 같은 방법은 이미지와 상품 메타 정보를 기반으로 패션 상품을 검색하는 데에도 적용 가능 예를 들어, “셔츠”라는 하이퍼님에 대해 “드레스 셔츠”, “티셔츠” 등의 하이포님을 추출하여 보다 정확한 검색 결과 제공 가능.

Section 5.4: Learning Intent by Traversing Semantic Knowledge Graphs

5.4.1 What is a Semantic Knowledge Graph?

- Semantic Knowledge Graph 정의

- “Semantic Knowledge Graph” = 실시간으로 도메인 내의 관계를 탐색하고 순위를 매길 수 있는 자동 생성 모델

- 기존 검색 엔진 = 쿼리에 대한 문서 검색 및 순위 매김

- Semantic Knowledge Graph = 쿼리에 가장 적합한 용어를 검색하고 순위 매김

- 예시

- 건강 관련 문서를 색인하고 ‘advil’을 검색

- 전통적인 검색 엔진 = ‘advil’이 포함된 문서 반환

- Semantic Knowledge Graph = 관련 용어 반환 (e.g., advil, motrin, aleve, ibuprofen, alleve)

- “Dynamic Synonyms” 개념

- 용어가 동일한 의미를 지닌 것이 아니라 개념적으로 관련된 용어로 확장 가능

TL;DR

- Semantic Knowledge Graph는 실시간 관계 탐색 및 순위를 지원하는 자동 생성된 모델임.

- 전통적인 검색 엔진과 달리 쿼리에 적합한 용어를 검색하고 순위를 매김.

- 동적 동의어를 통해 쿼리 확장 및 관련 문서 검색을 개선

5.4.2 Indexing the Datasets

- 데이터셋 선택

- 직업 게시판 (job board POSTings) 데이터셋

- StackExchange 데이터 덤프 (health, scifi, devops, outdoors, travel, cooking)

- 색인화 과정

- Semantic Knowledge Graph 사용 전, 데이터셋을 색인화해야 함

- Inverted Index와 Forward Index 활용

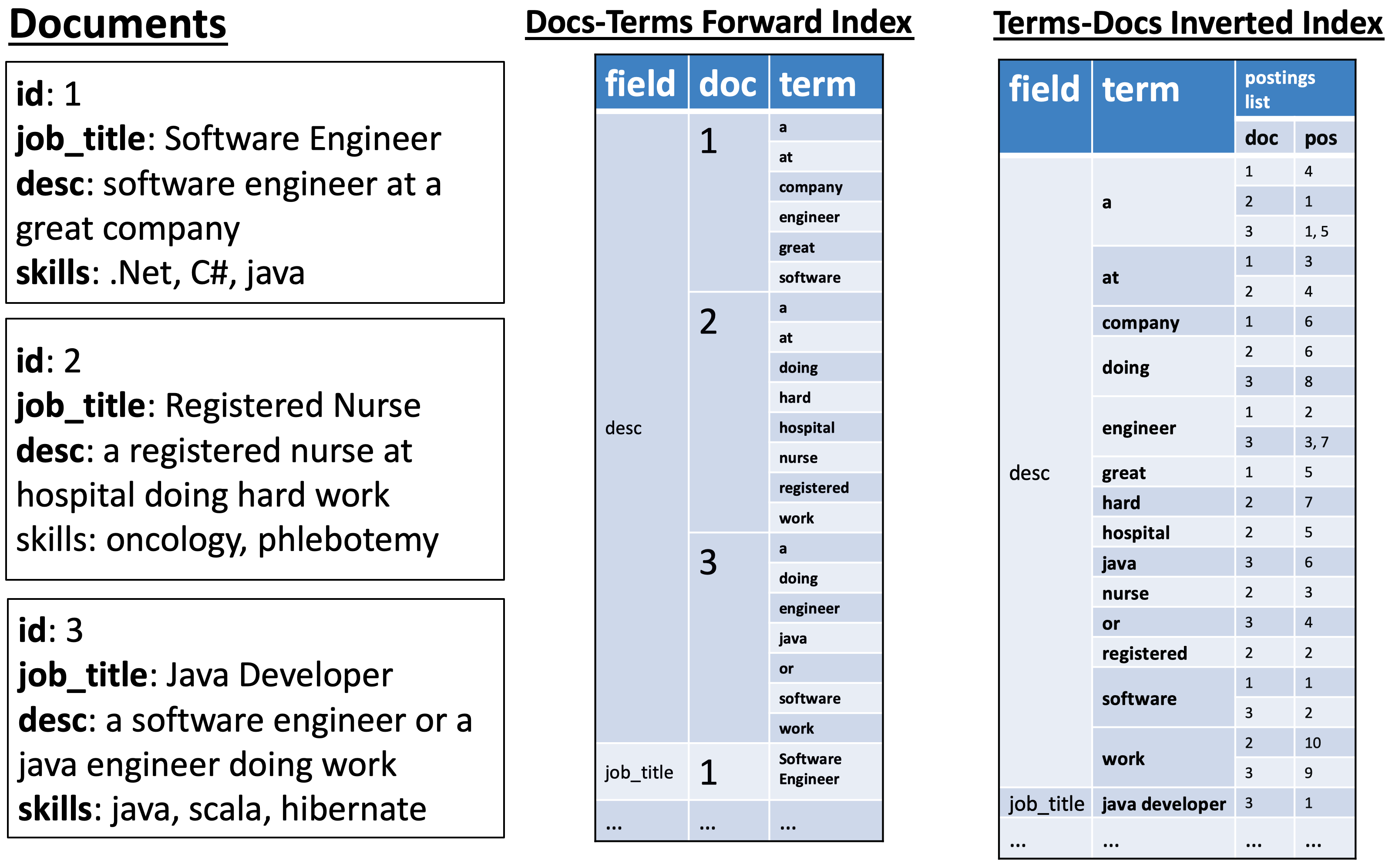

- Figure 5.4 설명

- Inverted Index = 문서의 각 필드를 용어 목록으로 매핑

- Forward Index = 용어를 문서 목록으로 매핑

- 이중 방향 매핑 = 그래프 탐색 및 관계 발견에 중요

- 이미지 설명

- Inverted Index와 Forward Index의 관계를 보여주는 Figure

- 문서가 어떻게 Inverted Index와 Forward Index로 매핑되는지 시각화

- 각 문서의 ‘job_title’, ‘desc’, ‘skills’ 필드가 용어와 문서로 매핑됨

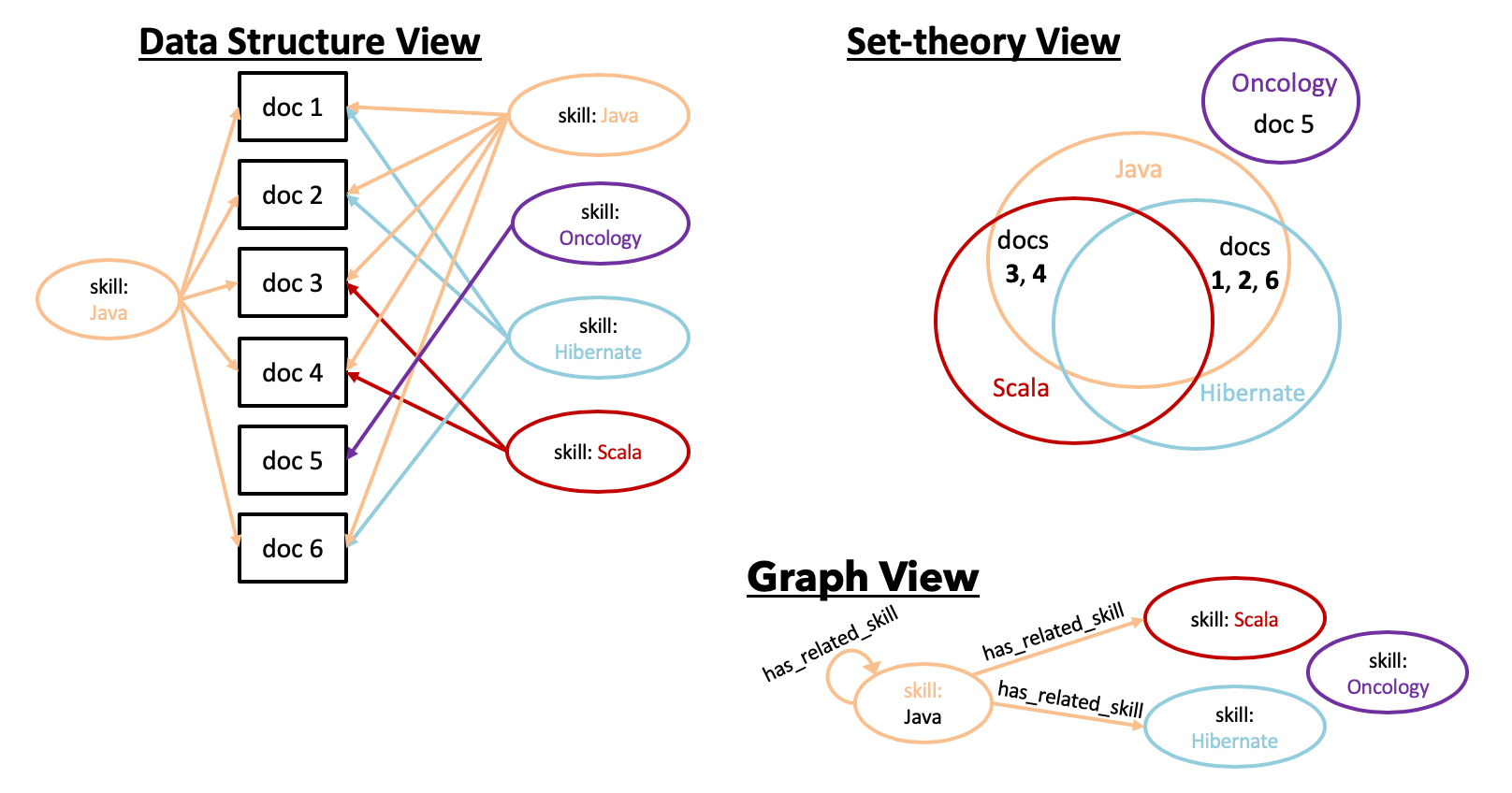

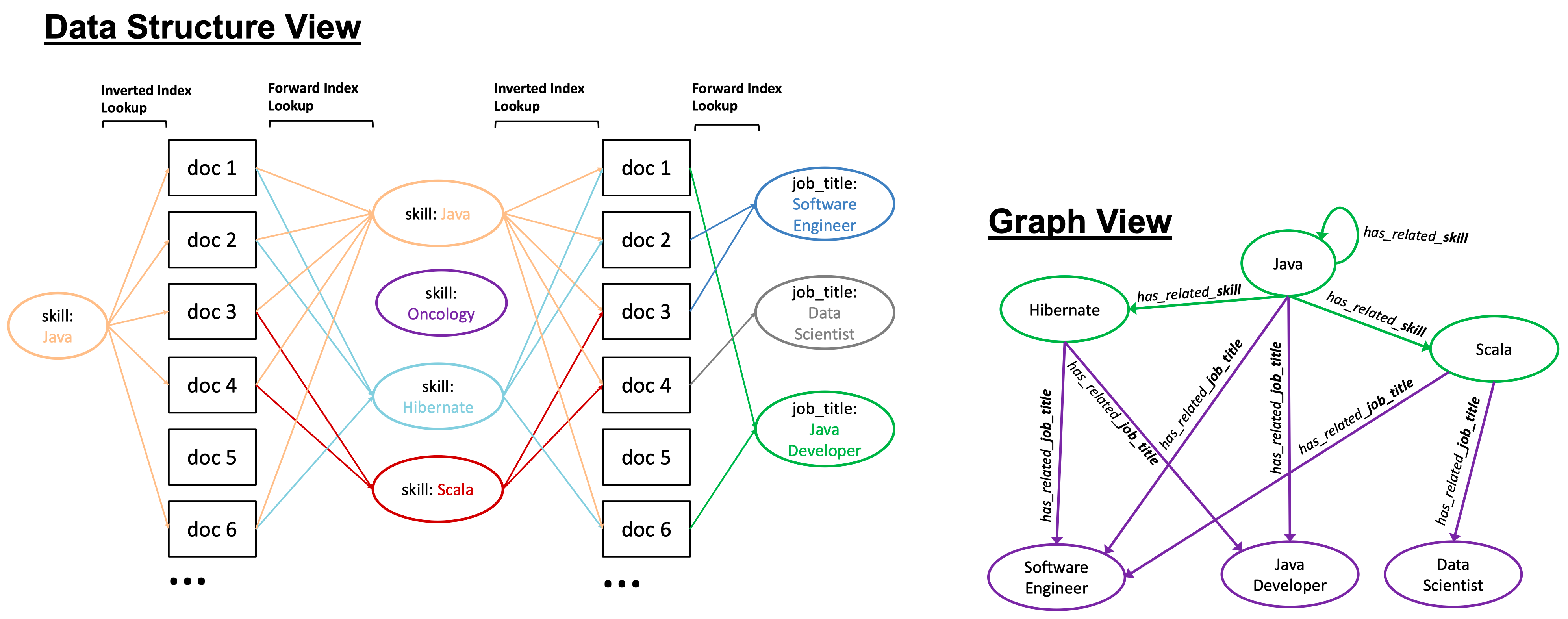

5.4.3 Structure of a Semantic Knowledge Graph

- 구조 이해

- Inverted Index = 용어를 문서 집합에 매핑

- Forward Index = 문서를 용어 목록에 매핑

- 두 인덱스를 통해 문서-용어-문서 간의 관계 탐색 가능

- 이미지 설명

- Semantic Knowledge Graph의 세 가지 표현: 데이터 구조, 집합 이론, 그래프

- 데이터 구조: 용어와 문서 관계

- 집합 이론: 문서 집합의 교차점이 관계 형성

- 그래프: 노드와 엣지로 구성된 시각적 표현

패션 상품 검색 적용 예시

- 이미지 및 메타 정보 활용

- 이미지 속성 및 텍스트 메타 정보를 Semantic Knowledge Graph로 모델링

- 예: ‘청바지’ 검색 시 관련 이미지 및 텍스트 정보 자동 반환

- 모델 활용

- 인풋: 이미지 속성, 텍스트 메타 정보

- 아웃풋: 관련 패션 아이템 추천 및 검색 결과 확장

- 기술 적용

- 패션 웹사이트에서 사용자 경험 개선을 위해 Semantic Knowledge Graph 적용

- 관련 아이템 및 스타일 제안 기능 강화

위와 같은 방식으로 Semantic Knowledge Graph는 다양한 도메인에서의 쿼리 확장 및 관련 데이터 탐색에 강력한 도구로 활용될 수 있음.

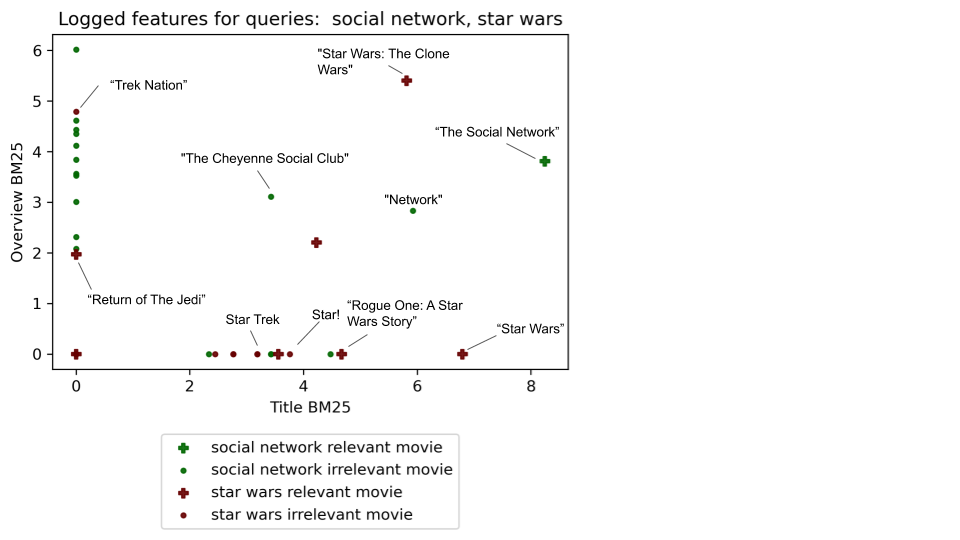

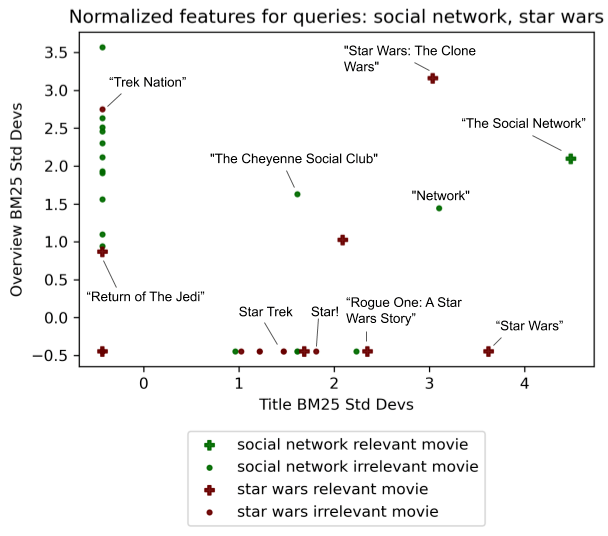

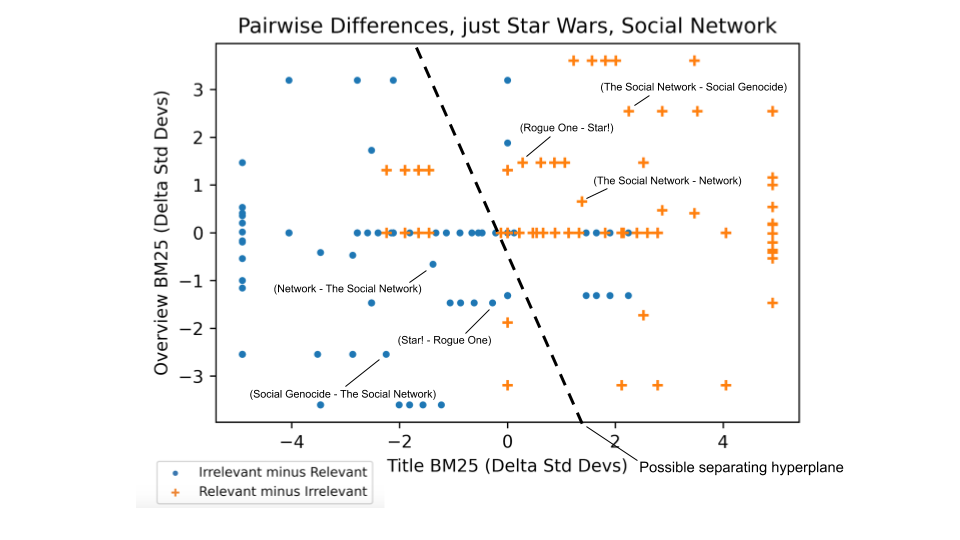

Semantic Knowledge Graphs and Their Application in Search Engines

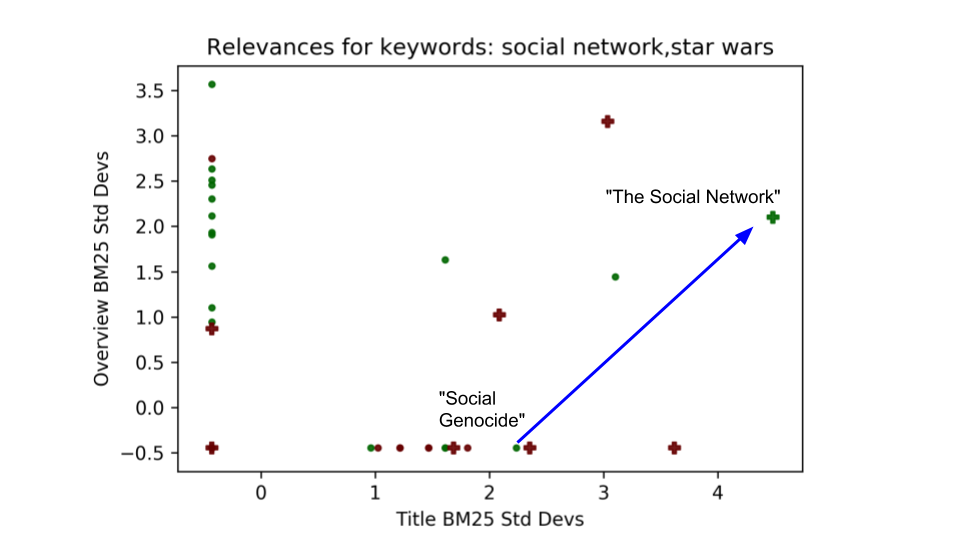

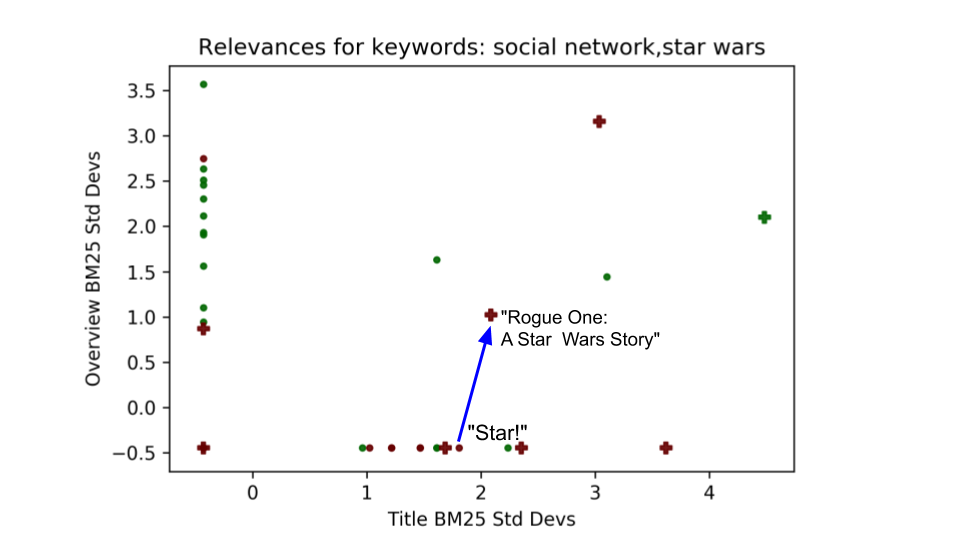

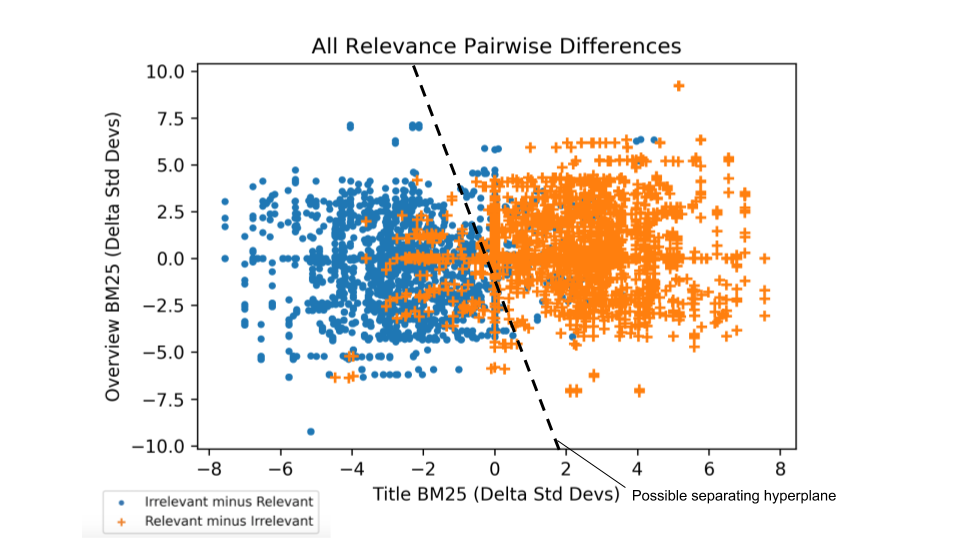

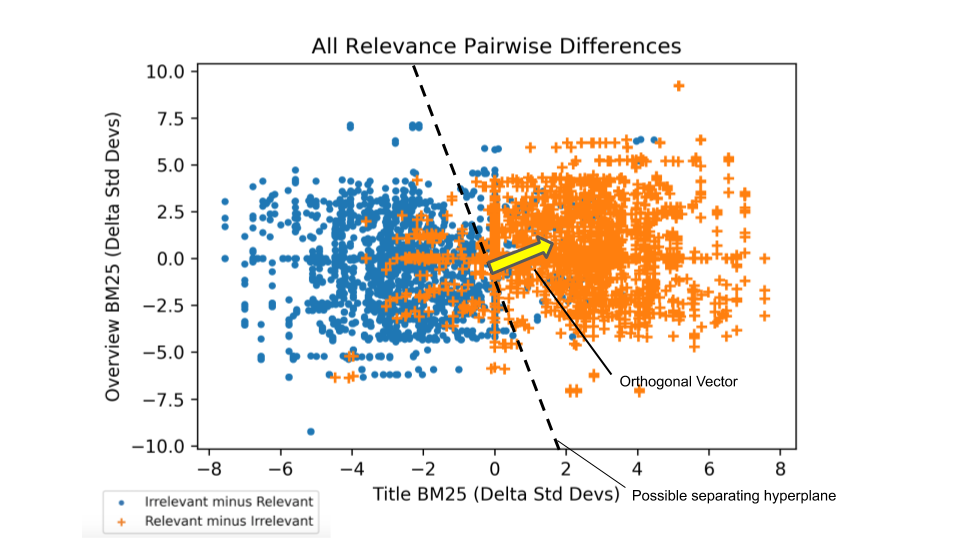

1. Introduction to Semantic Knowledge Graphs

Semantic knowledge graphs represent an advanced abstraction layer built on top of existing inverted indexes. These graphs enhance traditional search engines by not only matching and ranking documents but also focusing on the semantic relationships between terms. This allows for more nuanced and context-aware search results.